Claudeの安全性|ChatGPTとの比較で分かる企業向けセキュリティ

「Claude安全性は本当に企業利用で信頼できるのか?」「ChatGPTやGeminiと比較してセキュリティレベルはどうなのか?」ビジネスでのAI導入を検討する際、多くの企業がこれらの疑問を抱いています。特に金融機関や医療機関など、厳格なセキュリティ基準が求められる業界では、AIツール選択が事業継続に直結する重要な判断となります。

本記事では、Anthropic社が開発するClaudeの安全性について、公式認証とデータに基づいて詳しく解説します。SOC2 Type 2認証やASL-3安全性基準の取得状況、Constitutional AI(憲法AI)による独自の安全対策、そして他社AIとの客観的な比較結果まで、企業のAI導入担当者が知るべき情報を網羅的にお伝えします。

Claudeが米国政府機関(国防総省、ローレンス・リバモア国立研究所など)で実際に採用され、FedRAMP High認定を取得している背景には、どのような安全性の根拠があるのでしょうか。また、Claude Enterprise プランの具体的なセキュリティ機能や、機密情報を扱う際のベストプラクティスについても、実践的な観点から詳しく解説していきます。

- Claude安全性の客観的評価

- ChatGPTやGeminiとの詳細比較

- Constitutional AI(憲法AI)の仕組み

- 企業導入時の実践的セキュリティ対策

- 米国政府機関等の導入事例と成果

Claudeは本当に安全?企業導入での信頼性と運営会社の実力

企業がAIツールを導入する際、運営会社の信頼性とセキュリティ体制の評価が欠かせません。Anthropic社はOpenAIの元研究者らが設立した企業として、AI安全性研究に特化した独自路線を歩んでいます。

2024年には米国政府機関との協力関係を構築し、企業利用における信頼性向上に取り組んでいます。

Anthropicの企業背景と信頼性

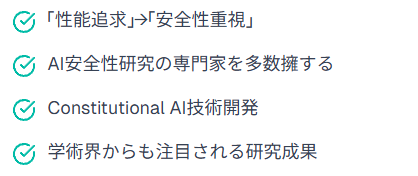

2021年にOpenAIの元VP研究担当だったDario Amodei氏とDaniela Amodei氏が立ち上げたAnthropic社は、従来の「性能追求」から「安全性重視」へとパラダイムシフトした企業です。

創設者らがGPT-3開発に携わった経験から、AI技術の潜在的リスクを深く理解し、安全性を最優先とした開発体制を築き上げました。AI安全性研究分野の専門研究者を多数擁し、Constitutional AI(憲法AI)など独自の安全性技術を開発しています。

同社の研究成果は学術界からも注目されており、AI安全性研究における先進的な取り組みが特徴です。

Google・Amazon大規模投資の意味と影響

GoogleとAmazonから大規模な投資を受けた事実は、Anthropic社の技術力と将来性を示す明確な証拠といえるでしょう。

Amazonが最大40億ドルの投資を発表し、Googleも数十億ドル規模の投資を行うなど、両社がClaudeの企業向けサービスに並外れた期待を寄せていることの表れです。この投資により、Google CloudやAWSの企業向けセキュリティ機能を直接活用できる体制が整い、エンタープライズグレードのセキュリティ基盤が提供されるようになりました。

これらの投資発表により、企業向けAI市場でのAnthropic社の存在感が大きく向上しています。

SOC2 Type 2認証取得による客観的信頼度の証明

SOC2 Type 2認証を取得したことで、Anthropic社は企業向けセキュリティ基準を満たしていることが第三者機関により客観的に証明されました。

SOC2 Type 2認証は、セキュリティ、可用性、処理完全性、機密性、プライバシーの5つの信頼サービス基準について、最低12ヶ月間の運用実績を厳格に評価する監査です。この認証により、Claudeは金融機関や医療機関でも利用可能なセキュリティレベルを満たしていることが客観的に立証され、規制業界での導入検討を支える基盤となっています。

この認証取得により、従来は慎重姿勢だった規制業界でも導入検討が活発化しています。

米国AI安全性研究所との協定による安全性評価プロセス

2024年にAnthropic社が米国AI安全性研究所(AI Safety Institute)との協力関係を構築したことは、政府レベルでの安全性評価体制確立に向けた重要な取り組みです。この協力により、Claudeの安全性評価において政府機関との連携体制が構築され、企業利用時の安全性向上に寄与しています。

特筆すべきは、企業の機密情報保護や生成AIの適切な利用に向けた評価プロセスで、ビジネス利用における安全性が継続的に検討される点です。この政府機関との協力関係が、Claudeの企業向け安全性における重要な差別化要因となっています。

ReAlice株式会社 AIコンサルタント

ReAlice株式会社 AIコンサルタントAnthropicは、安全性を第一義とした設計思想が貫かれており企業導入における信頼要素が多い点が評価されます。

大手クラウドベンダーとの提携によりClaudeのセキュリティは商用環境でも実用に足る水準に達しています。

Constitutional AI(憲法AI)による他社AIとは一線を画す安全対策

Claudeの最大の特徴は、Constitutional AI(憲法AI)と呼ばれる独自の安全性技術にあります。人間の監視なしにAI自身が有害なコンテンツや不適切な回答を自動修正する仕組みを実現している点が革新的です。

Constitutional AIは、明文化された原則に基づく客観的な安全性評価を可能にし、従来の手法と比較して一貫性の高い安全な応答を実現しています。

憲法AIの仕組みと自己修正機能の詳細解説

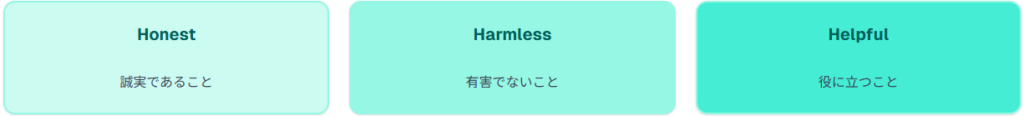

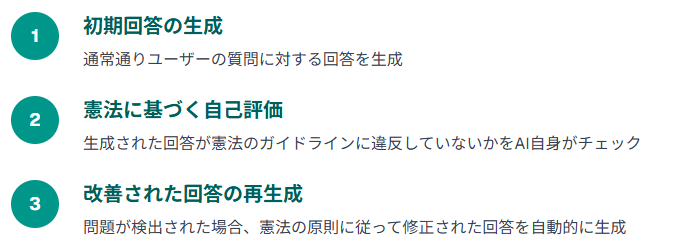

Constitutional AIは、事前に設定された「憲法」と呼ばれる原則に基づいて、AIが自動的に回答を修正する技術です。

この憲法は「誠実であること(Honest)」「有害でないこと(Harmless)」「役に立つこと(Helpful)」という3つの基本原則と、詳細なガイドラインで構成されています。

この自己修正プロセスにより、有害コンテンツの生成を大幅に削減し、従来のAIが外部からの修正に依存していたのに対し、Claudeは内部の価値判断システムで自律的に品質向上を図る点が画期的といえます。

他社AIとのアプローチの決定的な違い

ChatGPTやGeminiが採用するRLHF(人間フィードバックからの強化学習)に対し、ClaudeはCAI(Constitutional AI from AI Feedback)を採用している点が根本的な相違です。RLHFでは人間の価値観のばらつきや主観が安全性に影響を与える可能性がありますが、CAIでは明文化された憲法に基づく客観的判断が可能になります。

この技術的差異により、企業利用における予測可能性と信頼性が大幅に向上し、ビジネス現場での安心感につながっています。

多層防御システムによる包括的なセキュリティ対策

Claudeは入力された質問と生成する回答の両方を、リアルタイムで監視する多層防御システムを搭載しています。

複数のAIモデルが連携して動作し、有害コンテンツを迅速に検出・ブロックする仕組みです。企業利用で重要な機密情報漏洩リスクの検出では、個人情報や企業の機密データなど、様々な機密情報パターンを自動識別する機能も提供しています。

規約違反への体系的な対応体制

規約違反に対してAnthropic社は段階的制裁措置を実施しており、明確な基準に基づく利用制限を設けています。企業アカウントに対しては専用の監視体制を設けており、違反行為の検出時には企業の管理者へ詳細な報告を提供する体制を構築している点が特徴的です。

この透明性の高い対応により、企業は自社内でのClaude利用状況を適切に管理でき、コンプライアンス要件を満たしやすくなっています。

Claudeの最大の強みは、明文化された原則に基づく自己判断型セーフティ設計にあります。

従来のRLHFが人間依存だったのに対しCAIにより一貫性と再現性のある安全性制御が実現されています。

企業データ保護とプライバシー対策の実態

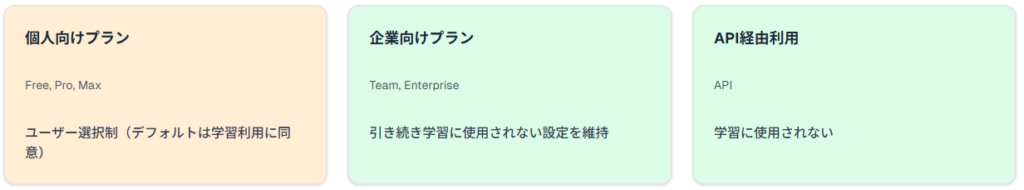

企業のAIツール導入における最大の懸念は、機密情報の取り扱いとプライバシー保護でしょう。Claudeでは企業向けに特化したデータ保護機能が提供されており、Team、Enterpriseプランでは入力された情報がAIの学習に使用されない設定が維持されています。

多くの企業がAI導入時にデータプライバシーを重要視しており、Claudeの企業向けプライバシー機能がこれらのニーズに対応する重要な要素となっています。

入力データの学習利用ポリシーと企業向け設定

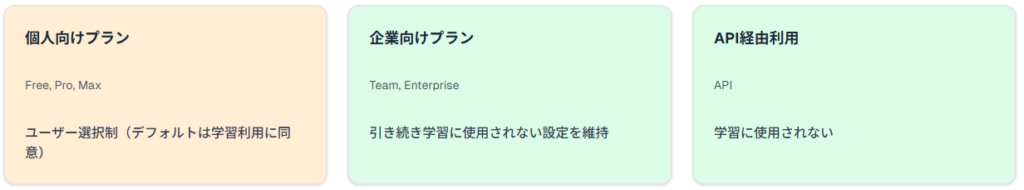

Claudeは2025年8月のポリシー更新により、プランによって学習利用の扱いが以下のように変更されました。

この企業向けプランでの厳格なデータ保護ポリシーが、ビジネス利用における重要な差別化要因となっています。企業管理者が全社員の利用状況を一元管理できるダッシュボードを提供し、データ処理の透明性を確保している点も評価されています。

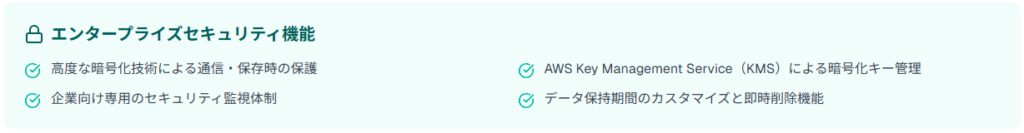

エンタープライズグレードのセキュリティ対策

通信時と保存時の両方で高度な暗号化を採用し、Claudeは金融機関レベルのセキュリティを実現しています。企業向けプランでは、厳格なセキュリティ基準に基づいてユーザーデータが保護される設計となっている点が特徴です。

データ保持期間のカスタマイズと即時削除機能

企業向けClaudeでは、データ保持期間を柔軟にカスタマイズできる機能を提供しています。即時削除機能により機密性の高い会話を終了と同時にサーバーから完全消去できる点は、企業の機密管理において重要な機能です。

欧州のGDPR規制に準拠したこの機能により、個人情報を扱う企業でも安心してClaudeを利用できます。法務部門向けには法的保持義務に対応した長期保存オプションも用意されており、コンプライアンス要件を満たしながらAIを活用できる環境が整っています。

AWSインフラによる安定運用体制

ClaudeはAmazon Web Services(AWS)のインフラを活用し、高い可用性と堅牢なセキュリティを実現しています。AWSのグローバルインフラを活用することで安定した稼働率を保証し、災害時でも業務継続が可能な冗長化システムを構築しています。

地理的データ所在地の指定が可能な点も企業利用で重要で、日本企業の場合は国内リージョンでのデータ処理を指定することができ、機密情報管理要件を満たすことが可能です。

Claudeは企業向けのデータ保護ニーズに的確に応える設計が際立っています。

入力情報を学習に使わない設定、即時削除機能、データ保持期間の柔軟性など、現場のセキュリティ要件を細かくカバーしています。

ChatGPTやGeminiとの安全性比較|企業はどれを選ぶべき?

企業のAIツール選択において安全性評価は最重要項目の一つです。ChatGPT、Gemini、Claudeの安全性を客観的に比較することで、企業規模や業界特性に応じた最適な選択が可能になります。

多くの企業がAI導入時に安全性を重要視しており、適切な比較検討が事業継続性に直結する重要な要素となっています。

主要AIツールの安全性特徴比較

各AIツールは異なる安全性アプローチを採用しており、それぞれに特徴があります。

- Constitutional AI技術による自己修正機能

- 企業向けプラン(Team、Enterprise)での学習データ除外設定

- 明文化された倫理原則に基づく判断システム

- 人間フィードバックからの強化学習(RLHF)

- 企業向けプランでの包括的管理機能

- コンテンツフィルタリングシステム

- Google Cloudのセキュリティインフラとの統合

- データ損失防止(DLP)機能

- Googleサービス全体との連携セキュリティ

企業向け機能とセキュリティ対策の違い

ChatGPT EnterpriseはMicrosoft 365との深度統合により、既存のセキュリティポリシーを継承できる点で優位性を持ちます。Azure Active Directoryとの連携により、単一認証(SSO)と多要素認証(MFA)を標準装備しています。

Gemini for WorkspaceはGoogle Cloudの企業向けセキュリティ機能をフル活用でき、データ損失防止(DLP)機能が特に強力です。

一方Claudeは独自のConstitutional AI技術により、他社では困難な倫理的判断を自動化できる点で差別化しています。この技術により、企業利用時の予測可能性と安全性が向上し、規制業界でも導入検討が進んでいます。

業界別・企業規模別の選択指針

業界特性と企業規模に応じたAIツール選択が重要になります。

金融・医療・法務業界

- 推奨:Claude(高い安全性と倫理的判断機能)

- 特徴:Constitutional AI技術による一貫した倫理判断

製造業・小売業

- 推奨:ChatGPT(Microsoft 365連携によるワークフロー効率化)

- 特徴:既存システムとのシームレスな統合

中小企業(100名未満)

- 推奨:Gemini for Workspace(統合性とコストバランス)

- 特徴:Googleサービス利用企業での高い親和性

エンタープライズ企業(1000名以上)

- 推奨:用途に応じた複数ツール検討

- 重要要素:管理機能の充実度、既存インフラとの統合性

各企業は自社の業界特性、既存システム環境、セキュリティ要件を総合的に評価し、最適なAIツールを選択することが重要です。

企業のAI導入においては、セキュリティ設計の思想そのものを見極める視点が求められます。各ツールの特徴を踏まえ、自社の業務環境・ガバナンス体制と照らし合わせた評価が不可欠です。

Claude利用時の注意点とベストプラクティス

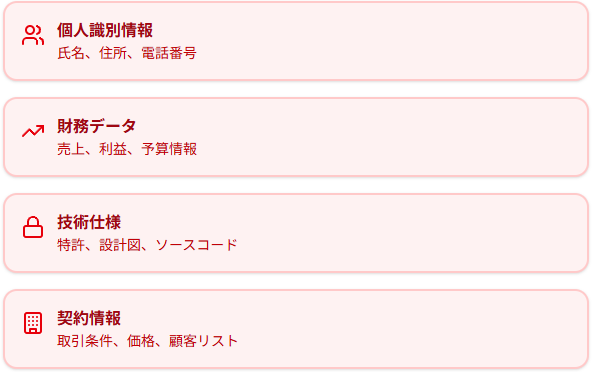

Claudeの高い安全性にも関わらず、企業利用では適切な運用ルールの設定が不可欠です。特に機密情報の取り扱いや出力内容の検証については、企業独自のガイドライン策定が必要になります。

AIツール導入に成功する企業では、明確な利用ガイドラインと従業員教育が重要な成功要因となっています。

機密情報入力時の避けるべき情報と対策

企業がClaudeを利用する際は、以下の機密情報の入力を避ける必要があります。

代替案として匿名化処理やデータマスキング技術を活用することで、機密性を保ちながらAIの恩恵を受けることが可能です。多くの企業では「顧客名をA社、B社に置換する」「金額は概算値に丸める」などの具体的な匿名化ルールを設定し、安全な活用を実現しています。

企業向けセキュリティ機能として、機密情報パターンを自動検知し、入力前に警告する仕組みの活用も効果的です。

出力内容の検証方法と正確性確保のポイント

Claudeの出力は高い精度を誇りますが、企業利用では必ず人間による検証が必要です。

効果的な検証プロセスを実装することで、品質維持と業務効率化を両立できます。

企業では、AI活用時に専任の監査体制を設置し、重要文書については人間による最終確認を実施することで、AI活用による業務効率化と品質維持を両立できます。

企業向けプランでの安全性最適化設定

Claude Enterpriseプランでは、企業のセキュリティ要件に応じた詳細な設定カスタマイズが可能です。

- データ保持期間の柔軟な設定

- アクセス制御による権限管理システム

- 監査ログの詳細レベル調整

- 外部連携制限の段階的設定

企業では部署ごとに異なるセキュリティ要件に応じた設定を適用することで、営業部門では柔軟な活用を可能にしつつ、経理部門では厳格なデータ管理を実現できます。

このように部署別の特性を考慮した設定により、業務効率と安全性の最適バランスを実現することが可能です。

Claudeの高度なセキュリティ機能を有効活用するには、技術的対策と運用ルールの両輪が必要不可欠です。

特に、入力前の匿名化処理や出力内容のレビュー体制の整備は実務上の必須要件です。

最新|Claudeのセキュリティ強化と今後の展望

継続的なセキュリティ強化により、Claudeは企業利用における信頼性をさらに高めています。2024年後半から2025年にかけて実装された新機能は、エンタープライズ市場でのポジションを向上させています。

セキュリティ重視の業界を中心に、企業向けAI市場でのClaude採用が拡大している傾向が見られます。

AI安全性基準ASL-3適用による新たな安全レベル

2025年にAnthropic社がAI安全性基準ASL-3(AI Safety Level 3)の保護措置をClaude Opus 4に適用し、業界最高水準の安全性を実現しました。

ASL-3基準により、Claudeは他のAIツールでは困難な高度なセキュリティ要件を満たす選択肢の一つとなっています。

継続的なセキュリティ強化への取り組み

Anthropic社では発見された脆弱性に対して迅速な対応を実施しており、影響を受けた企業への適切な通知、詳細な技術説明の提供、必要に応じた追加セキュリティ対策を行っています。

現在Claudeでは定期的なセキュリティ更新と包括的セキュリティ監査を実施しており、新たな脅威に対する予防的対策を継続しています。セキュリティ研究者向けのバグ報奨金プログラムも運営し、世界中の専門家からのセキュリティ強化協力を得ています。

プライバシーポリシー変更の影響

2025年8月のプライバシーポリシー更新により、Claudeのデータ利用方針が以下のように変更されました。

- 個人向けプラン(Free、Pro、Max):ユーザー選択制(デフォルトは学習利用に同意)

- 企業向けプラン(Team、Enterprise):引き続き学習に使用されない設定を維持

- データ保持期間:学習同意の場合は最大5年間保持

この変更により、企業向けプランでは引き続き厳格なデータ保護が維持され、GDPR、CCPA、日本の個人情報保護法への準拠体制が継続されています。

企業は自社のセキュリティ要件に応じて適切なプランを選択することで、安全性とビジネス効率を両立できる環境が提供されています。

継続的なアップデート体制や脆弱性対応フローは、エンタープライズ利用に求められる透明性と信頼性を担保するものです。学習制御のポリシー分離とGDPR対応は、法規制を意識する企業にとって重要な導入判断材料となります。

よくある質問|Claude安全性に関するビジネス現場の疑問

企業のClaude導入検討時に寄せられる代表的な質問について、具体的な事実に基づいて回答します。

これらの質問は企業のIT部門や法務部門から寄せられる内容を基にしており、導入決定に直結する重要なポイントを網羅しています。

Claudeのデータ学習利用について教えてください

2025年8月のプライバシーポリシー変更により、Claudeのデータ学習利用方針は以下のようになっています。

- 個人向けプラン(Free、Pro、Max): ユーザー選択制(デフォルトは学習利用に同意)

- 企業向けプラン(Team、Enterprise): 引き続き学習に使用されない設定を維持

- API経由利用: 学習に使用されない

企業向けプランでは会話データは暗号化されてサーバーに保存されますが、AIモデルの改善には利用されません。データの処理ログも詳細に記録され、監査対応や規制当局への報告も容易になっています。

企業の機密情報を入力しても大丈夫でしょうか?

Claude Enterpriseプランでは高度な機密情報保護機能を提供していますが、機密度の高い情報は適切な前処理が推奨されます。

個人名や企業名の匿名化、具体的な数値の概算化、機密文書の要約での利用に留めることが効果的な対策です。多くの企業では、機密情報レベルに応じた分類基準を設け、高レベルの情報については匿名化処理を義務化するルールを制定しています。

企業向けセキュリティ機能として、機密情報パターンを自動検知し、入力前に警告する仕組みも活用できます。

ChatGPTと比べてClaudeの方が安全なのでしょうか?

セキュリティの観点では、ClaudeとChatGPTにはそれぞれ異なる特徴があります。

- Claudeの特徴: 企業向けプランでの学習データ除外設定、Constitutional AIによる自動的な有害コンテンツ検出、明文化された倫理原則

- ChatGPTの特徴: 企業向け管理機能、既存システムとの統合面での優位性

業界特性が選択の重要な要因で、金融・医療・法務業界ではClaudeの高い倫理性が評価され、製造業やIT業界ではChatGPTの統合機能が重視される傾向があります。企業のニーズに応じた適切な選択が重要です。

無料版と有料版でセキュリティレベルに違いはありますか?

Claudeの基本的なセキュリティ機能(データ暗号化、Constitutional AI)は無料版でも提供されています。

ただし学習利用の設定や企業向けの高度な管理機能は以下のように異なります。

- 無料版: 個人利用レベルのセキュリティ、学習利用はユーザー選択制

- Claude Pro: 小規模チーム向けの基本管理機能

- Claude Enterprise: 大企業向けの包括的なセキュリティ管理機能、学習利用除外設定

中小企業の場合、Claude Proでも十分なセキュリティレベルを確保できることが多く、コストパフォーマンスの観点からも有効な選択肢となっています。

金融・医療業界でも安心して利用できますか?

ClaudeはSOC2 Type 2認証、HIPAA準拠により、金融・医療業界での利用に必要な主要な規制要件を満たしています。

多くの金融機関や医療機関でClaude Enterpriseの導入検討が進んでおり、特に顧客対応業務や文書処理業務での活用が検討されています。

ただし患者の個人情報や顧客の財務情報を直接入力することは避け、適切な匿名化処理や要約での活用が推奨されます。規制当局との協議においてもClaudeの安全性設計は評価されており、業界での導入に向けた環境が整いつつあります。