DeepSeekの商用利用は規約的に可能?企業での利用の危険性も解説

「DeepSeekは商用利用して大丈夫なのか」「中国サーバーにデータを預けても問題ないのか」と不安を感じつつも、そのコストメリットや性能の高さから、ビジネスでの活用を検討している方は多いはずです。特に、個人情報保護法や不正競争防止法、秘密保持契約への影響を正しく理解しないまま業務利用を進めると、思わぬコンプライアンス違反につながりかねません。

この記事では、DeepSeekの商用利用可否や中国法準拠によるリスク、ChatGPTとの違いといった「今まさに知りたいポイント」を押さえつつ、記事全体でどのような判断材料が得られるのかをお伝えします。あなたの会社でDeepSeekを使うべきかどうか、自信をもって判断できるようになりましょう。

- DeepSeekの商用利用は可能か?MITライセンスの具体的な内容と注意点

- 個人情報や機密情報を入力した場合の法的リスク(個人情報保護法・不正競争防止法)

- 中国サーバーでのデータ保管と中国法(国家情報法・データセキュリティ法)によるリスク

- ChatGPT EnterpriseやClaude等の他サービスとのセキュリティ・プライバシー比較

- 企業がDeepSeekを安全に活用するための具体的な対策

DeepSeekのライセンスと商用利用について

DeepSeekはMITライセンスで公開されており、国内企業でもプロダクト組み込みや社内システムへの利用がしやすいモデルです。

一方で、MITライセンスは自由度が高い代わりに、利用者側で知財やコンプライアンスを管理する前提になっています。AIを業務で活かす際は「使えるかどうか」だけでなく「自社の法務・セキュリティ体制の範囲で安全に運用できるか」をあわせて検討することが欠かせません。

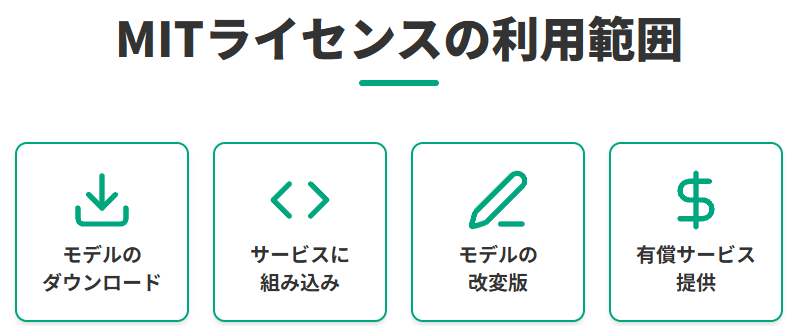

MITライセンスで認められている利用範囲

MITライセンスでは、DeepSeekのモデルをダウンロードして自社環境で動かすことも、APIとして自社のサービスに組み込むことも可能です。改変版を含めて有償サービスとして提供できる点も、SaaSや受託開発ビジネスと相性が良いポイントです。

必要なのは著作権表示とライセンス文を残すことだけで、モデル自体の追加ロイヤリティは発生しませんが、API利用時には別途料金が必要です。実務では、OSSポリシーにMITライセンスの取り扱いを明記し、開発チームと法務が共通認識を持つことから始めると運用がスムーズになります。

出力物の知的財産権と著作権の扱い

DeepSeekの生成物は、一般的な生成AIと同様にユーザー側で自由に利用できることを想定した設計とされています。ただし、学習データに含まれていたコンテンツと似た表現が混ざる可能性があるため、公開コンテンツや製品コードに使う場合は、人の目によるチェックを挟んだ方が安全です。

特に、マニュアル、広告コピー、仕様書、アプリケーションの中核ロジックなどは、著作権やブランドイメージの観点から社内レビューをルール化しておくと安心です。AIを叩き台として使い、最終版は人間が責任を持って仕上げるという線引きを決めておくと、現場でも判断しやすくなります。

ChatGPTと利用条件を比較

ChatGPTの法人向けプランでは入力データはデフォルトで学習に利用されない一方、DeepSeekには学習利用を止めるための設定がありません。また、ChatGPTの法人向けプランは契約ベースで守秘義務やデータの扱いが整理されている一方で、DeepSeekは約款ベースで個別交渉の余地が乏しく、入力データの扱いも原則としてサービス側の約款に従います。

この違いは、機密情報や個人データを扱う部門にとっては「採用できるかどうか」を左右するほど大きなポイントになります。現実的には、セキュリティ要件が高い業務にはChatGPT系の法人プランを、機密性が低くコスト重視の用途にはDeepSeekを、といった住み分けを前提に検討した方が判断しやすいでしょう。

ReAlice株式会社 AIコンサルタント

ReAlice株式会社 AIコンサルタントDeepSeekはMITライセンスにより導入しやすい一方、利用者側で知財やデータ保護を適切に管理する姿勢が不可欠です。生成物の権利帰属はシンプルですが、学習データ由来の表現混入リスクを考えると、公開物にはレビュー体制を設けるのが実務的です。ChatGPTの法人向けプランと比べると、データ保護や契約の堅牢性に差があるため、業務の機密度に応じたサービス選定が合理的です。

4つの利用パターンとセキュリティリスク

DeepSeekは、ブラウザから使うWeb版、システム連携用のAPI、ローカルで動かすオープンモデル、スマホなどのアプリ版という複数の形態があります。どの形態を選ぶかで、データの流れとリスクの種類が大きく変わります。

AI導入の相談では、この整理ができていないために「なんとなく危ない」「なんとなく便利」で議論が止まるケースが多く、まずは利用形態別に線を引くことが有効です。

Webインターフェースでの利用リスク

Web版は登録すればすぐ使えるため、現場レベルでの”草の根導入”が起こりやすい形態です。しかし、ブラウザから送信したテキストは国外サーバーで処理され、サービス側のポリシーに従って保存・学習に利用されます。

そのため、社内文書や顧客情報をそのまま貼り付けると、本人の同意なく第三者に提供したのと同じ状況になり得ます。情報システム部門としては、「私物PCからのWeb利用も含めて禁止」「アイデア出しや一般的な質問だけに限定」など、線引きを明文化することが欠かせません。

API経由での業務利用における注意点

API経由でシステムに組み込むと、ユーザーはAIを意識せずに機能を使えるため、業務効率化のインパクトは大きくなります。一方で、システムから送られるデータは裏側で外部サーバーに渡るため、「オンプレの業務システムだから安全」と誤解すると危険です。

設計段階で、個人情報や営業秘密を含むフィールドをマスキングする、ログを国内で分離管理するなど、アーキテクチャレベルでの対策が必要になります。そのうえで、障害発生時や規約変更時にすぐ切り替えられるよう、別ベンダーのAPIも候補に入れた構成にしておくと安心です。

オープンモデルのローカル環境利用は安全か

オープンモデルを自社サーバーや閉域ネットワーク内で動かせば、入力データが外部に送信されないため、情報漏洩のリスクは大きく抑えられます。ただし、高性能GPUサーバーの調達や運用、モデル更新の追随など、インフラとMLOpsの負荷は無視できません。

中小規模の組織では、最初からフルローカルを目指すのではなく、「まずはクラウド上の閉域ネットワーク」「次の段階でオンプレ」という段階的なロードマップを描いた方が現実的です。どのレベルまで自前で持つかは、扱うデータの機密度とIT組織の成熟度を見ながら決めるのが良いでしょう。

利用形態別のリスクを比較

Web・API・ローカルそれぞれの長所と弱点を整理すると、「コストは低いがデータが外に出る形態」と「コストは高いがデータを閉じ込められる形態」のどちらを選ぶかという構図がはっきりしてきます。一般的には、社外に出しても問題ない情報だけを扱う部門ではWebやAPI、秘匿性の高い情報を扱う部門ではローカルモデルという棲み分けがわかりやすい選択肢です。

全社で一律に「使う/使わない」を決めるよりも、情報区分ごとに許容できるリスクレベルを決め、それに応じて利用形態を選ぶ方が、現場の納得感も得やすくなります。

WebやAPIは導入が容易な反面、外部処理が前提となるため情報区分に応じた制御が欠かせません。ローカル実行は安全性が高い一方で、インフラや運用の負荷が増す点を見落とせません。結局のところ、コストと保護レベルのバランスを踏まえ、業務ごとに許容できるリスクに応じた形態選択が効果的です。

個人情報を入力するとどうなる?法的リスクを解説

DeepSeekへの入力が問題になるのは、技術的な安全性だけでなく、日本の個人情報保護法との関係です。法律専門家からは、「個人データを本人の同意なく海外事業者に流してしまうリスク」について注意が呼びかけられています。

顧客情報や従業員情報を扱う部門では、この観点を外すと、社内規程よりも重い”法令違反”というレベルの問題につながりかねません。

個人情報保護法上の留意点

法律専門家の分析によると、DeepSeekのプライバシーポリシー上、入力データが学習に使われ得ること、中国法が適用されることなどを踏まえ、個人データの入力には十分な検討が必要とされています。

ポイントは、中国法が適用されるため「日本の法律に基づく保護を前提にできない可能性がある」という点です。そのため、本人から明確な同意を得ていない顧客データや従業員データを入力すると、第三者提供の規制に抵触するリスクが出てきます。

DeepSeekが「委託」に該当しない理由

個人情報保護法では、外部の事業者に処理を任せる「委託」であれば、一定の条件のもとで本人同意なしにデータを渡すことが認められています。しかし、委託と認められるためには、「委託元の指示に従って処理し、目的外利用をしない」ことが前提です。

DeepSeekのように、サービス側が自らの判断で学習に再利用する可能性がある形態は、委託というより「別の事業者への提供」に近い扱いになります。そのため、「委託だから大丈夫」とみなして個人データを入力すると、法令解釈とズレが生じる危険があります。

オプトアウト機能がない点のリスク

多くの生成AIサービスは、入力内容を学習に使わないよう設定できるオプションを用意していますが、DeepSeekにはそれに相当する機能が見当たりません。一度送信された情報は、サービス側の判断でモデル改善の材料として扱われる可能性があります。

ユーザーから見て「どこまで残るのか」「いつ消えるのか」が不透明なため、個人データを入れてしまうと、後から消去を求めても完全には対応してもらえないリスクがあります。この状況を前提にすると、「そもそも入れない」という運用以外に、安全な選択肢はほぼないと考えた方が良いでしょう。

ChatGPTとの対応の違い

ChatGPTは法人向けプランで、入力データを学習に使わない設定や、契約ベースのデータ保護の取り決めを用意しています。一方、DeepSeekは約款ベースで、入力データの扱いをユーザー側から細かくコントロールする余地がありません。

この違いは「どちらが高性能か」という話とは別次元で、法務・コンプライアンス担当者の視点から見ると非常に大きな差です。個人情報を扱うシステムに組み込むなら、現時点ではChatGPT系や国内クラウド経由のサービスの方が、社内説明もしやすいと言えます。

DeepSeekに個人情報を入力する行為は、技術面の懸念に加えて日本の個人情報保護法との整合性が大きな論点になります。学習再利用や中国法の適用といった前提から、委託ではなく第三者提供として扱われる可能性が高く、本人同意なしの入力は法的リスクを伴います。オプトアウト手段が存在しないため、個人データを保護する観点では「入力しない」以外の現実的な回避策が乏しい状況です。

機密情報を入力すると起こりうる法的問題

機密情報や営業秘密をDeepSeekに入力した場合、不正競争防止法や秘密保持契約との関係で、個人情報とは別のリスクが立ち上がります。生成AIは”相談相手”として便利な反面、「誰に話しているか」がブラックボックスになりがちです。

ここを整理しないまま利用が広がると、法的なトラブルだけでなく、取引先からの信頼低下にも直結します。

営業秘密の「秘密管理性」が失われるリスク

不正競争防止法上の営業秘密は、「有用で」「公になっておらず」「秘密として管理されている」という3要件を満たす情報だけが対象です。このうち「秘密として管理されている」という条件は、誰にでも見える場所に置かないことや、守秘義務を課した相手にしか見せないことなどで担保されています。

守秘義務を負わない外部サービスにそのまま入力してしまうと、「自社ですら秘密扱いしていない」と評価されかねません。一度この要件が崩れると、その情報は法的に営業秘密とみなされなくなり、万が一盗まれても保護を受けにくくなる点が厄介です。

秘密保持契約違反の可能性

取引先と結ぶNDA(秘密保持契約)では、「第三者への開示禁止」「目的外利用の禁止」が定番の条項です。取引先から預かった要件定義書や顧客リストをDeepSeekに入力すると、NDA上の「第三者への開示」に該当するおそれがあります。

たとえ相手に実害が出なかったとしても、契約違反と判断されれば、損害賠償や取引打ち切りにつながることもあります。AI導入のプロジェクトでは、NDAの対象情報をどう扱うかを必ず最初に整理し、「AIに入れてよい情報/ダメな情報」を関係者で共有しておくことが重要です。

不正競争防止法との関係

第三者の営業秘密を不正に取得・使用・開示した場合、不正競争防止法による民事・刑事の責任を問われる可能性があります。悪意がなくても、「リスクを認識できたのに適切な措置を取らなかった」ケースでは、企業としての管理責任を厳しく見られます。

AIに入力した情報がどのように保存され、誰からアクセスできるのかが不透明なサービスに、他社の秘匿情報を流す行為は避けるべきです。

- 社内教育では、「コピー先がクラウドのメモ帳なのか、生成AIサービスなのか」でリスクが大きく変わることを具体例とともに伝えると理解が進む

- 不正競争防止法違反の場合、個人には10年以下の懲役もしくは2000万円以下の罰金またはこれらの併科が科される可能性がある

- 法人には5億円以下の罰金が科されることもある

機密情報をDeepSeekに入力する行為は、営業秘密の管理要件の喪失やNDA違反といった、個人情報とは異なる重大な法的リスクにつながります。秘密管理性が崩れると、情報が法的に保護されなくなるうえ、外部サービスへの入力は第三者提供と見なされる余地があり、契約上の責任も発生し得ます。また、不正競争防止法違反は企業だけでなく個人にも重い罰則が及ぶため、扱う情報の線引きを組織として明確にすることが必須です。

入力データはどこに保存される?

データがどこに置かれ、どの国の法律が適用されるかは、クラウドサービス選定において技術的なスペック以上に重要な要素です。DeepSeekの場合、サーバーの所在地と準拠法が日本企業にとってのリスク要因になります。

グローバルでビジネスを展開する企業ほど、データ主権やサプライチェーンリスクの観点からサービスを評価する必要があります。

中国サーバーでの処理と保管の実態

DeepSeekは中国拠点の企業が運営しており、入力データは中国国内のサーバーで処理・保管される前提になっています。中国には国家情報法があり、国家安全保障上必要と判断された場合、政府が企業に対してデータ提供を求める法的権限があります。

そのため、ビジネス上の機密情報や顧客データを入力すると、理論上は政府当局によるアクセスリスクが存在します。専門家や一部の組織からは、中国拠点のAIサービスを業務で使う際には慎重な判断が求められると指摘されています。

中国法準拠に伴うリスクとは

DeepSeekの利用規約は中国法に基づいて作られており、トラブルが起きた場合は中国の裁判所で解決することが前提です。日本の法律で認められている権利や手続きが、中国法のもとでは十分に機能しない可能性があります。

また、中国の個人情報保護法では、重要データの国外移転に制限があり、日本企業が後からデータの返還や削除を求めても応じてもらえないケースも考えられます。このリスクは、米中の技術覇権競争が続く中で、米国市場やEU市場でのビジネスにも影響を及ぼす可能性があるため、グローバル企業では特に注意が必要です。

アカウント削除後もデータは残るのか

DeepSeekの利用規約を見ると、アカウントを削除した後もバックアップやログとしてデータが一定期間残る可能性が示されています。完全な削除を保証する記載がないため、誤って機密情報を入力してしまった場合でも、後から取り消すことは事実上困難です。

個人情報保護法では、本人からの利用停止・消去請求に応じる義務がありますが、海外事業者に対してその権利を実効的に行使できるかは不透明です。万が一入力してしまった場合は、法務部門に速やかに報告し、必要に応じて本人や取引先への通知を検討する体制を整えておくべきでしょう。

利用規約が一方的に変更されることで起こるリスク

多くのクラウドサービスと同様に、DeepSeekの利用規約にも「運営者が一方的に変更できる」旨の条項が含まれています。現在は無料または低価格で提供されている機能が、ある日突然有料化されたり、データ保管ポリシーが変わったりする可能性があります。

業務システムに組み込んでいる場合、規約変更によって利用継続が困難になると、代替手段の確保や業務停止のリスクが発生します。2025年1月末にはデータベースのセキュリティ問題が報告されており、ビジネスクリティカルなシステムには向かないと判断する企業も出てきています。

DeepSeekは中国国内のサーバーで処理・保管され、中国法が適用される前提のため、データ主権や法的保護の観点で日本企業にとって特有のリスクが生じます。国家情報法に伴うアクセス可能性や、削除請求の実効性の乏しさは、機密データの扱いに大きく影響します。また、規約が一方的に変更される点も運用継続の不確実性を高めます。業務利用では、入力する情報の区分管理と代替手段の確保を必須とし、グローバル展開企業ほど慎重な判断が求められます。

生成AIサービス利用における専門家の指摘とリスク評価

2025年に入り、DeepSeekを含む生成AIサービスの業務利用について、セキュリティ専門家や一部組織から注意喚起が行われています。

背景には、技術的な脆弱性だけでなく、法制度の違いやサプライチェーンリスクへの懸念があります。民間企業にとっても、政府の見解は自社のリスク評価を行う際の重要な参考情報になります。

セキュリティ専門家による注意喚起の内容

セキュリティ専門家や企業からは、約款型サービスは入力データの管理を利用者側で制御できないこと、中国法が適用されるリスクがあることが指摘されています。

機密情報や個人情報を生成AIに入力しないという原則は、多くの組織でリスク管理の基本として推奨されています。この内容は民間企業にも参考になる判断基準を示しており、「コストが安いから使う」という視点だけでは不十分であることを明確にしています。

政府機関における利用判断の基準

政府機関では、生成AIサービスを業務利用する際に「要機密情報の入力禁止」「個人情報の入力禁止」「サプライチェーンリスクの評価」という3つの軸で判断しています。特に、中国拠点のサービスについては、国家情報法によるデータ提供義務のリスクを重視し、慎重な対応を取っています。

民間企業でも、この判断基準を参考にして「自社の情報資産をどこまでリスクにさらせるか」を評価するのが有効です。

政府機関の機密情報、安全保障に関わる情報、未公開の政策情報などを生成AIに入力することを禁止。民間企業でも、自社の機密度分類に応じて同様の線引きが有効です。

本人同意なく個人データを入力しないことを原則とする。特に、オプトアウト機能がないサービスでは、個人情報保護法の観点から入力を避けるべきです。

サービス提供者の国籍、データ保管場所、適用法令を評価し、特定国への依存度が高いサービスは慎重に判断する。金融機関、医療機関、公共インフラ事業者など、規制業種では特に重要です。

IT調達ガイドラインとの整合性

デジタル庁の「政府情報システムにおけるクラウドサービスの利用に係る基本方針」では、クラウドサービスを調達する際にセキュリティ要件、データ保管場所、準拠法を評価することが求められています。中国拠点のサービスでデータが中国国内に保管される場合、セキュリティ要件やデータ保管場所の観点から、慎重な評価が必要とされています。

民間企業のIT調達部門でも、同様の基準を設けてサービス選定を行うことで、リスクの高いサービスを事前に排除できます。特に、取引先や投資家から「データガバナンスの状況」を問われる場面が増えている企業では、IT調達ガイドラインの整備が信頼性向上につながります。

生成AIの業務利用では、技術的な性能だけでなく、適用法令やデータの越境管理を含む総合的なリスク評価が不可欠です。専門家や政府機関が示す指針は、入力禁止情報やサプライチェーンリスクといった実務的な判断軸を提供しており、民間企業でもそのまま応用できます。とりわけ、国際情勢や法制度によって保護水準が左右されるサービスには慎重な姿勢が求められます。

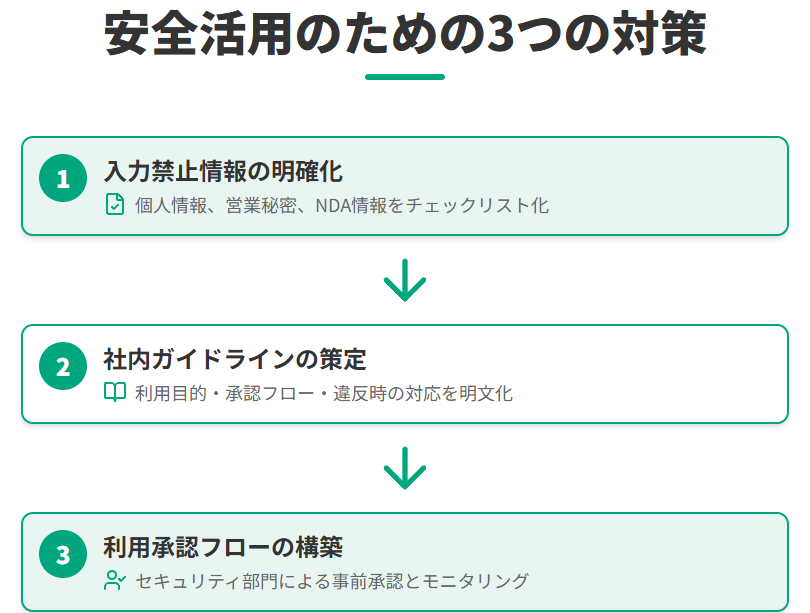

DeepSeekを安全に活用するための対策

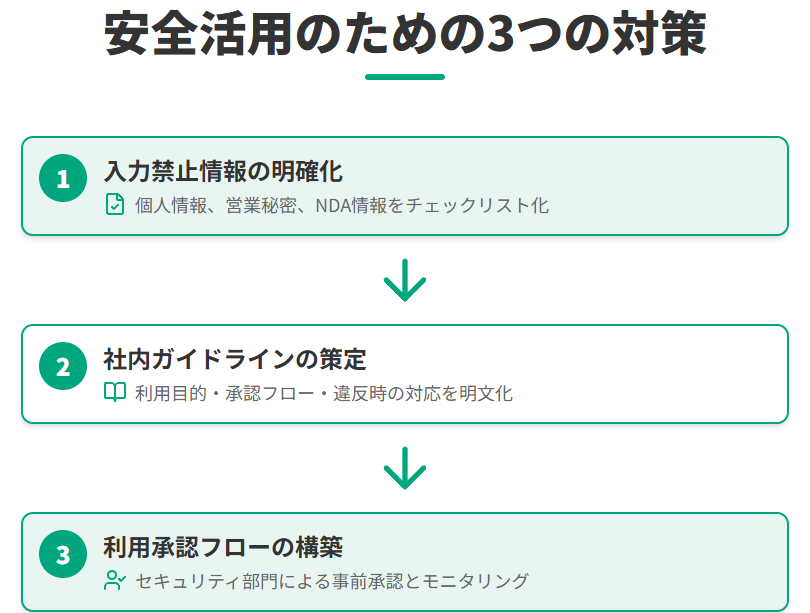

DeepSeekを全面的に禁止するのではなく、「リスクの低い用途に限定して使う」「入力禁止情報を明確化する」「社内ルールを整備する」という段階的なアプローチが現実的です。

AIを活用して業務効率を上げるには、セキュリティとコストのバランスを取りながら、組織全体でガバナンスを効かせることが欠かせません。ここでは、企業が実務で使える具体的な対策を整理します。

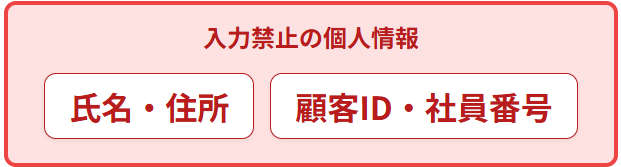

入力禁止情報のチェックリスト

DeepSeekを利用する際は、「何を入力してはいけないか」を明文化したチェックリストを作成し、全従業員に周知することが第一歩です。具体的には、個人情報、営業秘密、秘密保持契約の対象情報、未発表の新製品情報、顧客リスト、人事情報、財務データが入力禁止対象になります。

また、社内規程で「社外秘」「機密」などの分類ラベルが付いた文書も入力禁止とすべきです。チェックリストは定期的に見直し、法令改正や社内ルール変更に合わせて更新することで、実効性を保つことができます。

個人情報を入力してはいけない理由

個人情報保護法では、本人の同意なく個人データを第三者に提供することが原則禁止されており、DeepSeekへの入力が「第三者提供」に該当する可能性が高いためです。

また、オプトアウト機能がなく、入力したデータが学習に利用され、完全な削除が困難であるため、個人の権利利益を侵害するリスクがあります。

- 氏名、メールアドレス、電話番号、住所

- 社員番号、顧客ID、会員番号

- 個人を識別できる情報全般

営業秘密・機密情報の取扱い

営業秘密をDeepSeekに入力すると、不正競争防止法上の「秘密管理性」が失われ、法的保護が受けられなくなるリスクがあります。

また、理論的には学習データに含まれた情報が出力される可能性も指摘されており、技術的な情報漏洩リスクも考慮すべきです。

- 顧客リスト、製造ノウハウ、販売戦略

- 未発表の新製品情報、価格戦略

- 技術仕様書、設計図面

- 競争上の優位性を持つ情報全般

第三者から預かった秘密情報の注意点

取引先から秘密保持契約に基づいて開示された情報をDeepSeekに入力すると、契約違反として損害賠償請求の対象となるだけでなく、取引停止や信用失墜につながります。

また、預かった情報が取引先の営業秘密に該当する場合、不正競争防止法違反として刑事罰の対象となる可能性もあります。実務では、「秘密保持契約の対象情報は原則AI入力禁止」「やむを得ず使う場合は契約相手の事前承諾を書面で得る」という運用ルールを設けるべきです。

社内ガイドライン策定のポイント

DeepSeekを含む生成AIサービスの利用ガイドラインを策定する際は、「利用目的の明確化」「入力禁止情報の定義」「承認フローの設定」「違反時の対応」の4つを明文化することが重要です。利用目的としては、「アイデア出し」「文章の下書き作成」「一般的な情報収集」など、機密性の低い用途に限定するのが安全です。

ガイドラインは法務部門、情報セキュリティ部門、人事部門が連携して作成し、全従業員向けの研修を実施することで実効性を高めることができます。現場の利便性とリスク管理のバランスを取り、「禁止一辺倒ではなく、安全な使い方を示す」姿勢でガイドラインを作ると、現場の納得感も得やすくなります。

利用承認フローの構築方法

企業がDeepSeekを業務利用する際は、情報システム部門や情報セキュリティ部門による事前承認フローを設けることで、リスクの高い利用を未然に防ぐことができます。承認フローでは、「利用目的」「入力予定のデータの種類」「代替手段の検討結果」を申請させ、セキュリティ部門が承認可否を判断する形が一般的です。

承認後も定期的に利用状況をモニタリングし、不適切な利用が発見された場合は速やかに是正する体制を整えることが重要です。AIを活用した業務効率化を進める際は、「スピード重視で現場に任せる」のではなく、「ガバナンスを効かせながら段階的に展開する」慎重なアプローチが長期的には成功につながります。

コストとセキュリティのバランス

DeepSeekの最大の魅力は低コストですが、「安いから使う」という判断だけでは法的リスクやセキュリティリスクを見落とす危険があります。企業がAI活用戦略を立てる際は、「コスト削減効果」と「リスク発生時の損失」を天秤にかけ、総合的な費用対効果を評価すべきです。

例えば、セキュリティ要件が高い業務ではChatGPT EnterpriseやMicrosoft Azure OpenAI Serviceなど、データ保護が保証されたサービスを選択し、機密性の低い情報のみを扱う業務ではDeepSeekを活用するという使い分けが現実的です。「全社で一律にDeepSeekを禁止する」のではなく、「業務の機密度に応じてサービスを使い分ける多層防御戦略」を採用することで、コストとセキュリティの両立が可能になります。

入力禁止情報の明確化や承認フローの整備といった組織的なガバナンスが、安全性を確保するうえで不可欠です。個人情報や営業秘密は法的リスクが大きいため、用途を低機密領域に限定し、代替サービスとの使い分けでリスクを抑える戦略が有効です。ガイドラインと教育を組み合わせることで現場の迷いや誤用を防ぎ、コストとセキュリティの均衡を取った運用が実現しやすくなります。

ChatGPTやClaude等との違いは?

DeepSeekと他の主要な生成AIサービスを比較することで、自社に適したサービス選定の判断材料が得られます。

特に、守秘義務条項、データ保管場所、オプトアウト措置、出力物の利用制限という4つの観点で比較することが有効です。ここでは、ビジネス利用における実務的な違いを整理します。

守秘義務条項の有無による比較

ChatGPT EnterpriseやMicrosoft Azure OpenAI Serviceは、エンタープライズ契約で守秘義務条項が明文化されており、入力データが学習に利用されない保証があります。一方、DeepSeekの利用規約には守秘義務条項が存在せず、入力データが学習に利用される可能性があります。Claudeも有料プランでデータ保持をオフにするオプションがあり、企業向けには個別契約で守秘義務を設定できます。守秘義務条項の有無は、企業が機密情報を扱う業務でAIを利用する際の最重要判断基準となります。

データ保管場所と適用法令の違い

ChatGPTとClaudeは米国拠点のサービスで、データは米国またはEUのデータセンターで保管され、米国法またはEU法が適用されます。Microsoft Azure OpenAI Serviceは、日本リージョンを選択することで国内のデータセンターにデータを保管でき、日本法が適用されます。

一方、DeepSeekは中国拠点のサービスで、データは中国のサーバーで保管され、中国法が適用されます。データ主権やサプライチェーンリスクの観点では、日本企業にとって日本リージョンを選択できるサービスが最も安全です。

| サービス名 | データ保管場所 | 適用法令 | 守秘義務条項 |

|---|---|---|---|

| DeepSeek | 中国 | 中国法 | なし |

| ChatGPT Enterprise | 米国/EU/日本等(選択可) | 米国法/EU法/日本法等(選択可) | あり |

| Microsoft Azure OpenAI | 日本(選択可) | 日本法(選択可) | あり |

| Claude | 米国/EU | 米国法/EU法 | あり(有料プラン) |

オプトアウト措置の有無

ChatGPT、Claude、Microsoft Azure OpenAI Serviceはいずれも、有料プランまたはエンタープライズ契約でデータ保持をオフにするオプションがあり、入力データの学習利用を拒否できます。一方、DeepSeekにはオプトアウト機能が存在せず、入力データが自動的に学習に利用される可能性があります。

オプトアウト措置の有無は、個人情報保護法の「本人の権利保護」の観点から重要であり、企業のコンプライアンス部門ではオプトアウト可能なサービスを優先的に選択すべきです。

出力物の利用制限の比較

ChatGPT、Claude、Microsoft Azure OpenAI Serviceは、利用規約で出力物の知的財産権がユーザーに帰属することを明示しており、商用利用が認められています。DeepSeekもMITライセンスで出力物の商用利用が認められていますが、出力内容が学習データに含まれていた第三者の著作物と類似する可能性があるため、利用者側での確認が必要です。

また、ChatGPTとClaudeの利用規約では出力物の利用に一定の制約がある場合がありますが、DeepSeekで生成された出力物については、ユーザーが自由に利用できます。ただし、出力内容が第三者の著作物と類似する可能性があるため、商用利用時は内容確認が必要です。

- DeepSeekで生成された出力物は自由に利用できる一方、著作権リスクは利用者が負う必要がある

- ChatGPT系サービスは出力物の他モデル学習利用を制限しているため、知財保護の観点で安心

- 商用利用を前提とする場合は、出力物のレビュー体制を整えることが重要

主要サービスと比較すると、DeepSeekは守秘義務やデータ制御の仕組みが乏しいため、扱える情報の範囲が他社より狭くなる傾向があります。データ保管場所や適用法令も大きく異なり、特に国内リージョンを選べるサービスとの安全性の差は無視できません。オプトアウト機能の有無はコンプライアンスに直結し、企業では契約面で制御できるサービスを選ぶ合理性が高まります。

よくある質問|DeepSeekの商用利用について

DeepSeekは無料で商用利用できますか?

DeepSeekは無料版でも商用利用が可能で、MITライセンスにより出力物を自由にビジネスに活用できます。ただし、無料版でもデータが中国サーバーに送信され、学習に利用される可能性があるため、個人情報や機密情報を入力すると法的リスクが生じます。

商用利用する場合は、「何を入力してよいか」を明確にし、リスクの低い用途に限定することが重要です。また、API利用は有料ですが、ChatGPTと比較して低コストで利用できるため、コスト重視の開発案件では魅力的な選択肢となります。

DeepSeekに顧客情報を入力しても問題ありませんか?

顧客情報(氏名、メールアドレス、電話番号、購買履歴など)は個人情報に該当するため、本人の同意なくDeepSeekに入力すると個人情報保護法違反のリスクがあります。法律専門家からも注意喚起が行われており、DeepSeekへの個人データ入力は原則避けるべきです。

どうしても顧客情報を使ったAI活用が必要な場合は、オプトアウト可能なChatGPT EnterpriseやMicrosoft Azure OpenAI Serviceなど、データ保護が保証されたサービスを選択すべきです。

ローカル環境でオープンモデルを使えば安全ですか?

DeepSeekのオープンモデルを自社サーバーやオンプレミス環境で動かす場合、データが外部に送信されないため、情報漏洩リスクは大幅に低減されます。MITライセンスにより、モデルを自由にダウンロード・改変して商用利用できるため、データ主権を重視する企業にとって有力な選択肢です。

ただし、高性能なGPUサーバー(NVIDIA A100やH100など)が必要で、初期投資とメンテナンスコストがかかります。また、モデル自体が学習した知識の中に第三者の著作物が含まれている可能性があるため、出力物の独自性確認は必要です。

- 金融機関、医療機関など規制業種でデータ主権が重要な企業

- 高度な機密情報を扱う研究開発部門

- GPUサーバーの調達とMLOps体制が整っている企業

- 長期的にAI活用を進める戦略を持つ企業

MITライセンスとは具体的にどのようなライセンスですか?

MITライセンスは、ソフトウェアやAIモデルを誰でも自由に使用・改変・再配布できるオープンソースライセンスで、商用利用も無償で認められています。ライセンス条件は「著作権表示とライセンス文を残すこと」のみで、ロイヤリティの支払い義務や利用用途の制限はありません。

企業がMITライセンスのソフトウェアやモデルを利用する際の注意点は、「自由に使える代わりに、知財侵害や情報漏洩が発生した場合の責任は利用者側が負う」という点です。また、MITライセンスは「モデル本体」のライセンスであり、DeepSeekのWebサービスやAPIを利用する場合は別途利用規約が適用されます。

ChatGPTとDeepSeekはどちらが業務利用に適していますか?

業務の機密度によって使い分けるべきです。個人情報や機密情報を扱う業務では、守秘義務条項があり、データ保護が保証されたChatGPT Enterpriseの方が安全です。一方、一般的な文章作成、アイデア出し、公開情報の要約など、機密性の低い業務ではDeepSeekのコスト効率が魅力的です。

また、技術力とリソースがある企業なら、DeepSeekのオープンモデルをローカル環境で運用することで、コストとセキュリティを両立できます。「全社で一律にどちらかを選ぶ」のではなく、「業務特性に応じて複数のサービスを使い分ける」戦略が現実的です。

自社の業務を「高機密(個人情報・営業秘密を扱う)」「中機密(社内情報を扱う)」「低機密(公開情報のみ)」に分類します。高機密業務にはChatGPT Enterprise等の契約型サービスを選択し、低機密業務にはDeepSeekを活用するという住み分けが基本です。

DeepSeekのコスト削減効果と、情報漏洩や法令違反が発生した場合の損失を天秤にかけます。法令違反の場合、罰金だけでなく信用失墜や取引停止のリスクもあるため、総合的な費用対効果で判断することが重要です。

業務ごとに「使って良いサービス」「入力禁止情報」「承認フロー」を明文化し、全従業員に周知します。法務・情報セキュリティ・人事部門が連携してガイドラインを作成し、定期的な研修を実施することで実効性を高めます。

AI技術の進化や法令改正に合わせて、利用ガイドラインを定期的に見直します。利用状況をモニタリングし、不適切な利用が発見された場合は速やかに是正する体制を整えることで、リスクを継続的に管理できます。

DeepSeekは商用利用が可能で、コスト面でのメリットが大きい一方、個人情報保護法や不正競争防止法、秘密保持契約との関係で法的リスクが存在します。日本企業がDeepSeekをビジネスで活用する際は、業務の機密度に応じてサービスを使い分け、入力禁止情報を明確化し、社内ガイドラインを整備することが不可欠です。

AI活用による業務効率化を安全に進めるために、本記事で解説したリスク評価と対策を参考にしてください。