ElevenLabs の安全性|企業導入前に確認したいセキュリティ項目とは?

「ElevenLabsの音声生成AIを業務で使いたいけれど、セキュリティは本当に大丈夫なのか?」「企業の機密情報を扱っても問題ないのか?」こうした疑問を抱えている企業の担当者は少なくありません。AI音声技術の導入は業務効率化に大きく貢献する一方で、ディープフェイクによるなりすまし詐欺や情報漏洩のリスクも現実化しており、安全性の評価は慎重に行う必要があります。

本記事では、ElevenLabsのセキュリティ体制を徹底解説します。SOC 2 Type 2、GDPR、HIPAA準拠などのコンプライアンス対応状況から、C2PA準拠のディープフェイク対策、Reality Defenderとの提携によるリアルタイム検出技術まで、企業導入に必要な情報を網羅的に紹介します。

大手企業の導入事例を交えながら、導入前に確認すべきチェックリストまで実践的な内容をお届けします。ElevenLabsの安全性を正しく理解し、自社に最適な導入判断を行うために、ぜひ最後までお読みください。

- ElevenLabsのセキュリティ体制とコンプライアンス対応状況

- ディープフェイク対策として実装されているC2PA準拠技術

- 医療・金融・教育業界での具体的な導入事例

- 実際のユーザーが報告する課金トラブルやアカウント停止リスクなどの注意点

- 企業導入前に確認すべきチェックリスト

ElevenLabsのセキュリティ体制|企業が知るべき基本情報

ElevenLabsは多層防御のセキュリティ設計を採用し、企業の機密データを保護しています。2025年現在、同社のセキュリティフレームワークは規制産業でも採用される水準に達しており、金融機関や医療機関の厳格な要件にも対応可能です。

以下、企業が導入判断で確認すべき主要なセキュリティ対策を説明します。

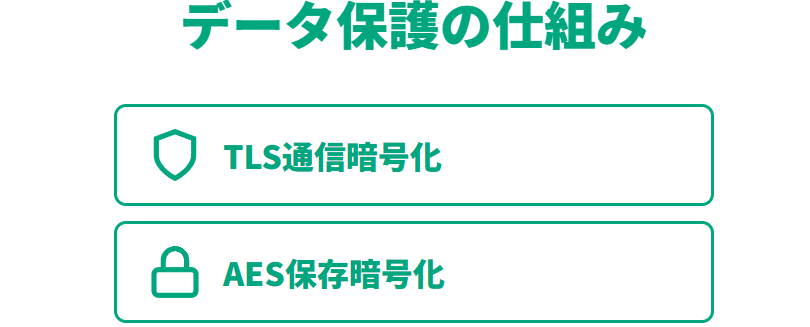

データ暗号化と通信保護の仕組み

ElevenLabsはTLS(Transport Layer Security)によるエンドツーエンド暗号化を実装し、クライアントとサーバー間の通信を完全に保護します。保存されるデータについてもAES(Advanced Encryption Standard)による暗号化が施され、不正アクセスからデータを守る仕組みです。

この暗号化レベルは、PCI DSS Level 1認証の取得にも貢献しており、決済カード情報を扱う業務でも利用できる水準となっています。実務的な観点から見ると、APIキーの管理とアクセス権限の設定を適切に行えば、エンタープライズ環境でも十分なセキュリティが確保できるでしょう。

SOC 2・GDPR・HIPAAへの準拠状況

ElevenLabsはSOC 2 Type 2認証を取得しており、セキュリティ、可用性、機密性に関する厳格な監査をクリアしています。この認証はエンタープライズ顧客向けに提供され、第三者機関による独立した評価を受けた証明です。

GDPRに関しては、データ主体の権利保護や適法なデータ処理を保証する体制が整備されており、EU圏内での事業展開にも対応しています。

- 医療分野ではHIPAA準拠のBusiness Associate Agreement(BAA)を提供し、Protected Health Information(PHI)を扱う医療機関でも利用可能

- 2025年7月にはインドのデータレジデンシー要件にも対応し、グローバル展開する企業のコンプライアンスニーズに対応

- SOC 2 Type 2レポートはエンタープライズ顧客向けに提供され、詳細なセキュリティ統制の証明として活用可能

ゼロリテンションモードによるデータ非保持オプション

ゼロリテンションモード(Zero Retention Mode)は、ElevenLabsのサーバー上に顧客のコンテンツやデータを一切保存しない設定で、エンタープライズプランで利用可能です。音声生成のリクエスト処理後、入力データと出力データがすぐに削除され、データフットプリントを最小限に抑えられます。機密性の高いプロジェクトや個人情報を含む音声生成では、この機能が特に重要な役割を果たすでしょう。

AIコンサルタントの視点では、契約書の音声化や内部トレーニング資料の作成など、外部に漏れてはいけない情報を扱う場面で、ゼロリテンションモードの活用は必須といえます。ただし、この機能はデフォルトでは無効なため、契約時に明示的に有効化する必要があることを覚えておきましょう。

ReAlice株式会社 AIコンサルタント

ReAlice株式会社 AIコンサルタントElevenLabsは、通信・保存の両面で暗号化を実装しており、業界標準のセキュリティレベルを確保しています。SOC 2やGDPRだけでなく、HIPAAや各国のレジデンシー要件にも対応している点は多様な業界にとって評価ポイントです。

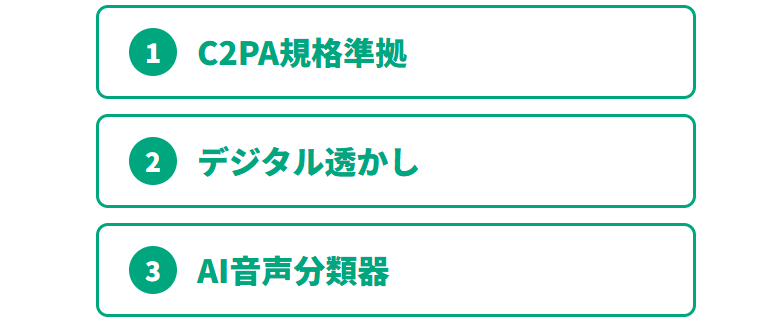

AI音声の悪用を防ぐ|ElevenLabsが実装する3つの独自技術

AI音声技術の進化に伴い、ディープフェイクやなりすまし詐欺のリスクも高まっています。こうした背景から、ElevenLabsは技術的・倫理的な両面から悪用防止策を講じており、2025年11月から国際標準C2PAに準拠した来歴証明システムを導入しました。

以下、同社が実装する3つの中核技術を詳しく見ていきます。

C2PA標準準拠で実現する音声の追跡可能性

C2PA(Coalition for Content Provenance and Authenticity)は、デジタルコンテンツの作成元と編集履歴を証明する国際標準規格です。ElevenLabsは2025年11月にこの規格に準拠し、生成されたすべての音声ファイルに「Content Credentials(コンテンツ資格情報)」を埋め込む仕組みを導入しました。

これにより、音声ファイルの作成日時、使用したモデル、編集履歴などのメタデータが記録され、AI生成音声であることが明確に識別できます。

- 音声ファイルの作成日時と生成に使用したAIモデル

- 編集履歴とコンテンツの変更記録

- AI生成音声であることを示す識別情報

- Adobe、Microsoft、BBCなど主要企業が参加するC2PA連合の認証

実務では、報道機関や広告代理店がこの技術を活用することで、情報源の真正性を確認し、フェイクニュースの拡散を防げるでしょう。

デジタル透かしとAI音声分類器の仕組み

ElevenLabsは生成された音声に不可視のデジタル透かし(ウォーターマーク)を埋め込み、人間の耳では聞き取れないレベルで識別情報を記録しています。この透かしは音声ファイルが編集や圧縮されても残存し、AI生成音声かどうかを後から検証できる仕組みです。さらに、AI音声分類器(AI Speech Classifier)を開発し、ElevenLabsで生成された音声を自動的に検出する技術を公開しています。

2024年7月にはReality Defenderとの提携により、295時間以上の合成音声データを提供し、ディープフェイク検出モデルの精度向上に貢献しました。Reality Defenderのシステムは8言語に対応し、90%以上の検出精度を実現しており、政府機関や金融機関での採用が進んでいます。

音声クローニング時の本人同意プロセス

音声クローニング機能を使用する際、ElevenLabsは本人の明示的な同意を求める厳格なプロセスを実装しています。具体的には、音声サンプルをアップロードする際に「この音声をクローニングする権利と同意を持っている」ことを確認するチェックボックスが表示され、利用者はこれに同意しなければ先に進めません。

音声サンプルアップロード時に「この音声をクローニングする権利と同意を持っている」ことを確認するチェックボックスに同意

本人が「私は[氏名]です。[プロジェクト名]のために[期間]、ElevenLabsで音声をクローニングすることに同意します」と述べる検証用音声の提出が必須

2025年9月にAILASと提携し、声優や俳優の権利保護を強化する認証ID制度を導入。Voice Libraryで公開される音声が本人の同意のもとで登録されていることを第三者に証明可能

C2PA準拠による来歴証明は、音声コンテンツにおける真正性担保の実務的な解となり得ます。不可視ウォーターマークと分類器の併用は検出耐性と運用性の両立という点で技術的に評価できます。

ディープフェイクリスクへの対策|企業が取るべき防衛策

AI音声技術の発展は業務効率化に貢献する一方で、悪意ある利用によるリスクも現実化しています。前述の技術的安全策を理解するだけでなく、企業は自社内での運用ルールを整備することが不可欠です。

以下、具体的なリスクシナリオと防衛策を解説します。

なりすまし詐欺やフェイクニュース生成のリスク

音声クローニング技術は、企業の経営陣や従業員になりすました詐欺に悪用される可能性があります。2019年にイギリスのエネルギー企業CEOの声を模倣した詐欺事件では、ドイツ子会社の責任者が22万ユーロ(約2700万円)をハンガリーの口座に送金させられる被害が発生しました。2020年にはUAEの銀行で、ディープフェイク音声を使った詐欺により3500万ドル(約38億円)の被害が報告されています。

フェイクニュースの分野では、政治家や著名人の偽音声が選挙や株価操作に利用されるリスクがあり、2024年の民主主義選挙の完全性を守るため、ElevenLabsはAI Elections Accordに署名しました。

- 音声による重要な指示や承認には必ず複数の認証手段(ビデオ通話や対面確認)を組み合わせる

- 100万円以上の送金指示には、音声だけでなくメールや社内システムでの二重確認を義務付ける

- 従業員教育でAI音声詐欺の存在を周知し、不審な音声指示に対する警戒心を高める

- 重要な意思決定プロセスには必ず複数の承認者を設定する

Reality Defenderとの提携によるリアルタイム検出

ElevenLabsは2024年7月にディープフェイク検出のリーディング企業であるReality Defenderと戦略的提携を結び、音声ディープフェイクの検出精度を劇的に向上させました。この提携により、Reality Defenderの検出システムには295時間以上のElevenLabs音声データが統合され、8言語にわたる検出能力が強化されています。

Reality Defenderの特許取得済みマルチモデルアプローチは、クラウドベースのプラットフォームとAPIを通じて、詐欺、偽情報キャンペーン、有害なディープフェイクを高精度で識別します。米国国防総省や主要金融機関がこのツールを既に採用しており、リアルタイムでAI生成音声の脅威を検出する体制を構築しています。企業のセキュリティ部門は、このような第三者検出ツールの導入を検討し、受信する音声コンテンツの真正性を検証する体制を構築すべきです。

利用規約違反の監視体制と対応フロー

ElevenLabsは禁止利用ポリシー(Prohibited Use Policy)を定め、悪意ある利用を積極的に監視しています。同社のAI安全チームは、コンテンツモデレーション技術と人間によるレビューを組み合わせ、規約違反の早期発見に努めています。

違反が検出された場合、警告、一時停止、永久アカウント削除といった段階的な措置が取られます。企業がElevenLabsを導入する際は、自社の従業員にも禁止事項を明確に伝え、社内の利用ガイドラインを整備することが重要です。

禁止されているコンテンツとペナルティ

ElevenLabsの禁止利用ポリシーでは、以下のような行為が明確に禁じられています。

- 本人の同意なしに他人の声をクローニングすること

- Voice CAPTCHAなどの音声検証メカニズムを回避すること

- 無許可のロボコールや自動ダイヤルシステムを利用すること

- スパムの生成や配布を促進すること

- 重要インフラの破壊やマルウェアの作成に関与すること

これらの違反行為が確認された場合、ElevenLabsは即座にアカウントを停止し、法執行機関への報告を含む適切な措置を講じます。企業は従業員研修でこれらの禁止事項を徹底し、意図しない違反を防ぐための内部統制を整備すべきです。

また、コンテンツ生成前に社内レビュープロセスを設けることで、コンプライアンスリスクを最小化できます。

AI音声合成技術の進化は業務活用の幅を広げる一方で、なりすましや詐欺といった現実的なリスクを孕んでいます。特に音声のみでの意思決定や送金承認は危険性が高く複数チャネルによる本人確認が不可欠です。

エンタープライズプランで強化されるセキュリティ機能

ElevenLabsのエンタープライズプランは、標準プランでは提供されない高度なセキュリティ機能とコンプライアンスオプションを備えています。

前述の基本的なセキュリティ対策に加え、大規模組織や規制産業の企業向けに特化した機能が提供されており、これらは導入判断の重要な要素となります。以下、エンタープライズ専用の主要セキュリティ機能を詳しく解説します。

データレジデンシーとEU圏内でのデータ保管

データレジデンシーは、顧客データを特定の地理的管轄区域内に保存する機能で、エンタープライズプラン限定で提供されます。ElevenLabsは標準では米国にデータを保存していますが、2025年5月にEU圏内、同年7月にはインド国内でのデータ保管オプションを追加しました。

EU圏で事業を展開する製造業や通信企業にとって、この機能はGDPRのデータ主権要件を満たすために不可欠です。インドでのデータレジデンシーは、同国の個人データ保護法案への対応を見据えた措置で、現地規制を遵守しながらAI音声技術を活用できる環境を提供します。

データレジデンシーを有効化すると、完全に分離されたElevenLabsワークスペースが提供され、専用のWebアドレスを通じてアクセスする仕組みです。実務では、多国籍企業は地域ごとのコンプライアンス要件を事前に整理し、必要な地域でデータレジデンシーを契約することが推奨されます。

ロールベースアクセス制御(RBAC)と多要素認証

エンタープライズプランでは、ロールベースアクセス制御(RBAC)により、組織内の各ユーザーに適切な権限を付与できます。管理者は音声生成、音声クローニング、請求情報へのアクセスなど、機能ごとに細かく権限を設定し、内部統制を強化可能です。多要素認証(MFA)の実装により、パスワードだけでなく追加の認証要素を求めることで、不正アクセスのリスクを大幅に低減します。

大規模組織では従業員の入退社が頻繁に発生するため、RBACによる権限管理は特に重要となります。退職者のアカウントを速やかに無効化し、必要最小限の権限だけを付与するゼロトラストの原則を実践することで、情報漏洩リスクを最小化できるでしょう。

専任サポートとカスタムSLAの提供内容

エンタープライズ顧客には専任のサポートチームが割り当てられ、技術的な質問やトラブルシューティングに迅速に対応します。カスタムSLA(Service Level Agreement)では、稼働率保証、応答時間、問題解決までの期限などが明文化され、ビジネスの継続性が担保されます。セキュリティ質問票への対応もエンタープライズサポートに含まれるため、企業の調達部門やセキュリティ部門が求める詳細な技術情報を入手しやすくなります。

AIコンサルタントの視点では、ミッションクリティカルな業務でElevenLabsを利用する場合、SLAの内容を契約前に十分に確認し、自社の事業継続計画(BCP)と整合させることが重要です。

API統合時のセキュリティ考慮事項

ElevenLabsのAPIを既存システムに統合する際は、APIキーの安全な管理が最優先課題となります。APIキーは環境変数や専用のシークレット管理サービス(AWS Secrets ManagerやAzure Key Vaultなど)に保存し、ソースコードに直接記述しないことが基本です。

API経由で送信されるデータもTLSで暗号化されますが、機密性の高い音声データを扱う場合は、ゼロリテンションモードを有効化し、リクエスト完了後にサーバー上にデータが残らないようにします。

- APIキーは環境変数や専用のシークレット管理サービスで保存し、ソースコードへの記述を避ける

- APIの利用ログを詳細に記録し、異常なアクセスパターンや大量のリクエストを監視

- 定期的にAPIキーをローテーションし、退職者や外部委託先が使用していたキーは即座に無効化

- ゼロリテンションモードを活用し、機密データがサーバーに残存しないよう設定

データレジデンシーやRBAC、ゼロリテンション対応など、大規模・多国籍組織での導入を前提に設計されている点が特徴的です。特に、GDPRや各国のデータ保護法制に準拠する柔軟性とAPI統合時のセキュリティ指針は実運用上の信頼性を支えます。

業界別のElevenLabs導入判断|医療・金融・教育での活用可否

業界ごとに求められる規制要件は大きく異なり、ElevenLabsの導入可否はコンプライアンス対応状況に左右されます。

前述のセキュリティ機能を踏まえ、医療、金融、教育の3つの主要セクターにおける具体的な導入事例と判断のポイントを解説します。

HIPAA準拠による医療分野での利用

ElevenLabsは医療分野向けにHIPAA準拠のBusiness Associate Agreement(BAA)を提供し、Protected Health Information(PHI)を含む音声データの処理を可能にしています。米国の大手病院チェーンでは、患者教育用の多言語音声コンテンツ作成にAI音声技術を活用し、アクセシビリティを向上させています。日本でも、一部の医療機関が外国人患者向けの案内音声に音声AI技術を試験導入し、医療通訳の負担軽減を図っています。

ただし、HIPAA準拠機能はエンタープライズプラン契約者のみに提供され、事前にBAAの締結が必須です。医療機関がElevenLabsを導入する際は、まずPHIを含むデータを扱うかどうかを明確にし、該当する場合はエンタープライズプランとBAA締結を前提に契約交渉を進めるべきです。また、ゼロリテンションモードを有効化し、患者情報がサーバーに残存しないよう設定することが推奨されます。

金融業界で求められるコンプライアンス要件

金融機関では、PCI DSS(Payment Card Industry Data Security Standard)への準拠が必須であり、ElevenLabsはPCI DSS Level 1認証を取得しています。これにより、カード情報を扱う決済関連の音声サービスでも利用可能な水準を満たしています。大手金融機関では、顧客対応の自動化やコンプライアンス研修の音声教材作成にAI音声技術の導入を検討しています。

導入時には内部監査部門との連携が不可欠で、SOC 2 Type 2レポートを入手し、セキュリティ統制の詳細を確認することで、取締役会や監査委員会への説明責任を果たせます。また、金融機関特有のデータ保持期間要件に対応するため、音声ファイルのライフサイクル管理(生成、保存、削除)を明確に定義し、コンプライアンス部門と合意することが重要です。

教育機関におけるプライバシー保護の実践

教育分野では、学生のプライバシー保護が最優先事項であり、GDPR(欧州)やFERPA(米国)といった法規制への対応が求められます。ElevenLabsのGDPR準拠体制により、EU圏内の教育機関は安心して音声教材の作成やアクセシビリティ向上(視覚障害者向けの音声化)に活用できます。英国の一部の教育機関では、オンライン講座の多言語展開にAI音声技術を活用し、世界中の学習者にアクセス可能な教育コンテンツを提供しています。

日本でも、一部の大学が、アクセシビリティ向上のために講義資料の音声化を試験的に導入しています。教育機関がElevenLabsを導入する際は、学生の音声データを使用する場合に保護者の同意を得るプロセスを整備し、データの収集目的と保存期間を明確に開示することが必要です。また、卒業や退学により学生がいなくなった後のデータ削除手順を事前に定め、個人情報保護法に準拠した運用を確立すべきです。

教育分野においては、法令対応に加え、同意取得・保存期間・削除プロセスの整備が技術以上に鍵となります。

共通して言えるのは、使えるかではなくどのデータを、どの設定で使うかを先に決めることが成功条件である点です。

ElevenLabsを実際に利用した人の評価|セキュリティ面での注意点

実際のユーザー体験は、公式のセキュリティ仕様だけでは見えてこない運用上の課題を明らかにします。業界別の導入判断に加え、現場で直面する実務的な問題点を理解することが重要です。

Trustpilotやその他のレビューサイトには、セキュリティや課金に関する具体的なフィードバックが投稿されており、導入前にこれらの情報を把握することが求められます。以下、実際の利用者が報告している主な注意点を解説します。

課金トラブルとクレジット消費の管理方法

一部のユーザーは、無料トライアル期間終了後の自動課金や、予想外のクレジット消費に関する問題を報告しています。特にオーディオブックのような長尺コンテンツを生成する際、クレジット消費量が想定を超えることがあるため、事前に料金計算機で概算を確認することが推奨されます。企業で利用する場合は、請求管理者を指定し、月次の利用状況を定期的にレビューする体制を整えるべきです。

クレジット消費の予算を設定し、上限に近づいたらアラートを受け取る仕組みを導入することで、予期せぬコスト増加を防げます。大量の音声コンテンツを生成する際は、予算を超過するリスクがあるため、社内承認プロセスの整備が重要です。契約時に返金ポリシーを確認し、サービスが期待に沿わない場合の対応手順を把握しておくことも重要でしょう。

アカウント停止リスクを避けるための運用ルール

ElevenLabsは禁止利用ポリシーに違反したアカウントを予告なく停止する権限を持っています。音声クローニング時の同意確認を怠ったり、スパムやロボコールに利用したりすると、アカウントが永久停止されるリスクがあります。企業内で複数のユーザーがElevenLabsを利用する場合、全員が禁止事項を理解し、同意確認プロセスを遵守する文化を醸成することが不可欠です。

定期的な社内研修で利用規約を再確認し、新入社員や外部委託先にも同じルールを適用することで、意図しない違反によるアカウント停止を防げます。万が一アカウントが停止された場合に備え、重要な音声資産は定期的にバックアップし、別の保管場所に保存しておくことも推奨されます。

サポート体制と問題解決までの流れ

標準プランのユーザーからは、サポート対応がAIチャットボット中心で、複雑な問題の解決に時間がかかるという指摘があります。一方、エンタープライズプラン契約者は専任サポートチームによる迅速な対応を受けられるため、ミッションクリティカルな用途で使用する企業はエンタープライズプランの選択が現実的です。

Trustpilotのレビューでは、エンタープライズユーザーが技術的な問題を24時間以内に解決できた事例が報告されている一方、標準プランでは48時間以上待たされたケースも見られます。問題が発生した際は、具体的なエラーメッセージやスクリーンショットを添えてサポートに連絡することで、解決までの時間を短縮できるでしょう。また、ElevenLabsの公式ドキュメントやコミュニティフォーラムには多くのトラブルシューティング情報が蓄積されているため、サポートに連絡する前にこれらのリソースを確認することも有効です。

複数ユーザーでの利用や業務委託先を含む運用では、違反リスクを防ぐためのルール周知と教育も重要です。サポート体制に差があるため、用途やリスク許容度に応じたプラン選択が合理的な導入判断となるでしょう。

ElevenLabs導入する前に確認したいチェックリスト

ElevenLabsの導入判断には、技術的な検証だけでなく、組織全体のセキュリティポリシーや法務要件との整合性確認が必要です。

実際のユーザー評価を踏まえ、以下では企業が導入前に確認すべき主要項目をチェックリスト形式で解説します。

既存のITセキュリティポリシーとの整合性確認

自社のITセキュリティポリシーに、外部AIサービスの利用に関する規定があるかを最初に確認します。多くの企業では、クラウドサービス利用時にセキュリティ評価やリスクアセスメントを義務付けており、ElevenLabsもこのプロセスの対象です。具体的には、SOC 2レポートやセキュリティ質問票を情報セキュリティ部門に提出し、既存のベンダー管理プロセスに沿って評価を受ける必要があります。

データ分類ポリシーも重要な確認点で、ElevenLabsで処理するデータが「機密」「社外秘」「公開」のどのレベルに該当するかを明確にし、それぞれのレベルに応じた保護策(ゼロリテンションモードやデータレジデンシーなど)を選択します。実務では、既存のデータガバナンス委員会にElevenLabs導入計画を諮り、全社的な合意を得ることが、後々のトラブルを防ぐ鍵となるでしょう。

契約交渉時に確認すべき5つのポイント

エンタープライズ契約を締結する際、以下の5つのポイントを必ず確認してください。

生成された音声コンテンツの権利が自社に帰属することを契約書に明記し、第三者への利用権限についても明確化する

稼働率保証やサービスレベルの具体的内容と障害時の補償条件を確認し、自社のビジネス継続要件と整合させる

契約終了後に自社データが完全に削除されるまでの期間と手順を文書化し、証明書の発行を求める

セキュリティインシデント発生時の通知義務と対応手順を契約に盛り込み、何時間以内に報告を受けられるかを明確化

下請け業者のリストを入手し、自社データがどの第三者に共有される可能性があるかを把握する

これらの交渉は法務部門と連携して進め、必要に応じて契約内容の修正を求めることが重要です。

従業員研修で伝えるべき利用ガイドライン

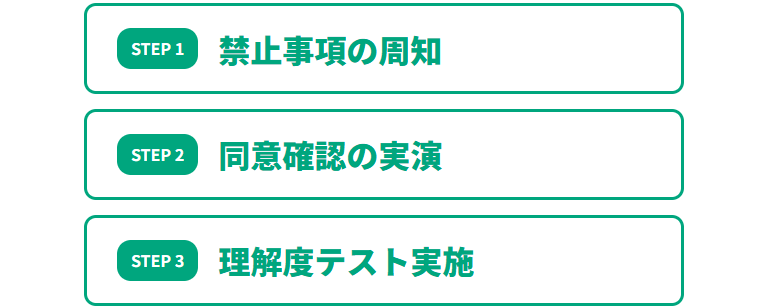

ElevenLabsを全社展開する前に、利用者向けの研修プログラムを実施することが成功の鍵です。研修では、禁止利用ポリシーの主要項目(他人の声の無断クローニング、スパム生成、ロボコールなど)を具体例とともに説明し、違反のリスクを明確に伝えます。音声クローニング時の同意確認プロセスを実演し、同意書のテンプレートと記録方法を共有することで、コンプライアンス違反を防げます。

また、機密情報を含む音声を生成する際の注意点(ゼロリテンションモードの使用、データレジデンシーの選択など)を実務に即して説明し、チェックリストを配布します。研修後は理解度テストを実施し、全員が基準をクリアするまで繰り返すことで、組織全体のセキュリティ意識を高められるでしょう。

インシデント発生時の責任範囲の明確化

セキュリティインシデントが発生した際の責任分界点を事前に明確にすることは、迅速な対応と法的リスク回避に不可欠です。ElevenLabsの責任範囲は、同社のインフラとサービス提供に関する部分に限定され、ユーザーがアップロードしたコンテンツや、利用規約に違反した使用方法については利用者側の責任となります。

契約書で、データ漏洩やサービス障害が発生した場合の通知義務、調査協力、損害賠償の上限などを明記し、双方の責任範囲を文書化します。社内では、インシデント対応チーム(CSIRT)にElevenLabs関連のエスカレーション手順を組み込み、どの部門が初動対応を担当し、どのタイミングで経営層に報告するかを定めます。また、インシデント発生を想定したシミュレーション訓練を定期的に実施し、対応手順の実効性を検証することも重要です。

音声生成という特性上、従業員教育と同意取得のプロセス設計も欠かせません。

CSIRT体制とインシデント対応フローの事前整備により、不測の事態にも迅速かつ責任分界を持った対応が可能となります。

よくある質問|ElevenLabsの安全性と企業利用

企業がElevenLabsの導入を検討する際、セキュリティとプライバシーに関する具体的な疑問が数多く寄せられます。

導入前チェックリストを踏まえ、以下では最も頻繁に質問される項目について、実務的な視点から回答します。

ElevenLabsで生成した音声は第三者に悪用されませんか?

ElevenLabsで生成された音声にはC2PA準拠のコンテンツ資格情報とデジタル透かしが埋め込まれており、AI生成音声であることが技術的に検証可能です。ただし、悪意ある第三者が音声ファイルを入手し、編集や悪用を試みるリスクはゼロではありません。企業側の対策として、生成した音声ファイルへのアクセス権限を厳密に管理し、不要なファイルは速やかに削除することが重要です。

機密性の高いプロジェクトでは、ゼロリテンションモードを有効化し、ElevenLabsのサーバーにデータを残さない設定にすることで、流出リスクを最小化できます。また、Reality Defenderなどの第三者検出ツールを活用し、自社が公開していない音声がインターネット上で悪用されていないかを定期的にモニタリングする体制を構築することも有効でしょう。

企業の機密情報を含む音声データはどう保護されますか?

ElevenLabsはエンドツーエンドのTLS暗号化により、通信中のデータを保護し、保存データにはAES暗号化を適用しています。エンタープライズプランでは、ゼロリテンションモードを有効化することで、音声生成処理後にサーバー上の入力データと出力データが自動的に削除され、データフットプリントを最小限に抑えられます。

さらに、データレジデンシー機能により、EU圏内やインド国内など、特定の地理的管轄区域にデータを保管することが可能で、現地のデータ保護法に準拠した運用が実現します。機密情報を扱う場合は、これらの機能を組み合わせ、契約時にBusiness Associate Agreement(BAA)やData Processing Agreement(DPA)を締結することで、法的保護を強化できます。

無料プランと有料プランでセキュリティレベルに差はありますか?

基本的な暗号化やGDPR準拠などの基礎的なセキュリティ対策は、無料プランでも提供されています。しかし、エンタープライズ向けの高度なセキュリティ機能(ゼロリテンションモード、データレジデンシー、HIPAA準拠のBAA、SOC 2 Type 2レポートへのアクセス、RBAC、専任サポート)は、有料のエンタープライズプランでのみ利用可能です。

無料プランや個人向け有料プランでは、これらの機能が提供されないため、規制産業や機密性の高い業務での利用には適していません。企業がElevenLabsを業務で利用する場合、セキュリティとコンプライアンスの要件を事前に整理し、必要な機能が含まれるプランを選択することが不可欠です。

音声データの保存期間と削除方法について教えてください

標準設定では、ElevenLabsはユーザーがアップロードした音声サンプルと生成された音声ファイルを、アカウント削除またはユーザーによる手動削除まで保持します。エンタープライズプランでゼロリテンションモードを有効化すると、音声生成処理が完了した時点で入力データと出力データがサーバーから自動的に削除され、長期保存されません。

ユーザーは管理画面から個別の音声ファイルや音声サンプルを手動で削除でき、削除後はElevenLabsのバックアップシステムからも完全に除去されます。契約終了時のデータ削除については、エンタープライズ契約のData Processing Agreementで削除期間(例:契約終了後30日以内)と手順が定められているため、契約時に確認し、自社のデータガバナンスポリシーと整合させることが重要です。

競合サービスと比較してElevenLabsのセキュリティはどうですか?

ElevenLabsは2025年12月時点で、SOC 2 Type 2、ISO 27001、PCI DSS Level 1、GDPR、HIPAAといった主要なコンプライアンス基準に準拠しており、音声AI業界ではトップクラスのセキュリティ体制を誇ります。競合のSynthflowもSOC 2、GDPR、HIPAA、ISO 27001に対応していますが、ElevenLabsはReality Defenderとの戦略的提携によるディープフェイク検出や、C2PA準拠の来歴証明システムなど、独自の安全対策を実装している点が特徴です。

Amazon PollyやGoogle Cloud Text-to-Speechといった大手クラウドベンダーのサービスは、親会社AWSやGoogle Cloudの広範なコンプライアンス認証を継承している点で信頼性が高いですが、ElevenLabsは音声AI専業として、より専門的な悪用防止策(AILAS認証、VoiceCAPTCHA)を提供している点が差別化要素です。企業が選定する際は、自社のコンプライアンス要件、予算、既存システムとの統合性を総合的に評価し、最適なサービスを選択すべきです。