Gamma情報漏洩が起きる5つの原因|最新フィッシング事例と企業の対策法

「Gammaで情報漏洩のリスクはあるの?」「企業でGammaを安全に使うにはどうすればいい?」そんな疑問をお持ちの方も多いのではないでしょうか。AI搭載のプレゼン資料作成ツール「Gamma」は、わずか数分で美しいスライドを自動生成できる便利さから、多くのビジネスパーソンに支持されています。

しかし2025年4月、Gammaを悪用した大規模なフィッシング攻撃が発覚し、企業の認証情報が狙われる深刻な事例が報告されました。生成AIツールの利便性の裏には、プロンプトに入力した機密情報が学習データとして利用されるリスクや、サイバー攻撃に悪用される危険性が潜んでいます。

本記事では、Gammaの情報漏洩リスクの実態、実際に起きたセキュリティ事例、そして企業が講じるべき具体的な対策まで、AIコンサルタントの視点から徹底解説します。安全にGammaを活用し、業務効率化とセキュリティを両立させたい方は、ぜひ最後までお読みください。

- 2025年4月に発生したGammaを悪用したフィッシング攻撃の実態

- Gamma自体のセキュリティ対策の実装状況

- 生成AIツール利用時の情報漏洩リスクと、実際に起きた企業の情報漏洩事例

- 企業がGammaを安全に導入・運用するための具体的な対策

- フィッシング攻撃メールの見分け方と、情報漏洩が発生した場合の対処法

Gammaで起きた情報漏洩事例と最新動向

2025年4月に発覚したフィッシング攻撃の詳細

2025年4月15日、セキュリティベンダーAbnormal Securityは、Gammaが多段階フィッシング攻撃に悪用されている事実を公表しました。攻撃者は正規のアカウントを乗っ取り、PDF添付を装った画像付きメールを送信し、受信者をGammaページから偽のMicrosoft SharePointログインページへ誘導する手法を使用しました。

Abnormal Securityの研究者Callie Hinman Baron氏とPiotr Wojtyla氏は、この攻撃が従来のフィッシングよりも高度であり、従業員が正規のツールだと信じ込みやすい点を警告しています。この手法は、ビジネスツールへの信頼を逆手に取った極めて悪質な攻撃です。

正規ドメインを悪用した攻撃の巧妙な手口

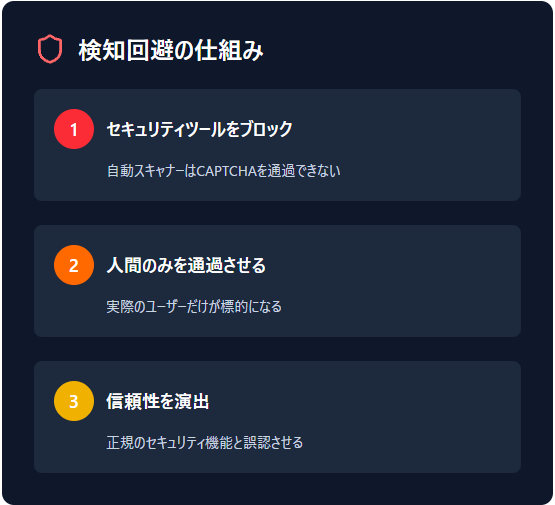

攻撃の特徴として、正規ドメイン「gamma.app」を利用することで受信者の信頼を獲得し、セキュリティフィルターによる検知を回避している点が挙げられます。さらにCloudflare Turnstileというボット検出システムを組み込み、セキュリティスキャナーによる自動分析を防ぐ仕組みを構築しました。

この二重の防御機構により、人間のユーザーだけを標的にする精巧な攻撃が可能になっています。企業のセキュリティ担当者は、正規サービスを経由した攻撃への対策を見直す必要があります。

企業の認証情報が狙われる仕組み

フィッシングページでは、Adversary-in-the-Middle(AiTM)技術を活用し、ユーザーが入力した認証情報をリアルタイムで検証する仕組みが導入されています。

誤ったパスワードを入力すると「Incorrect password」エラーが表示されることから、攻撃者が実際のMicrosoftサーバーと通信しながら認証情報を窃取していることが判明しました。

この攻撃は企業のサプライチェーン全体に影響を及ぼす危険性があり、正規アカウントから送信されたメールは取引先企業にも信頼されやすく、二次的被害が拡大する恐れがあります。AIツールの利便性とセキュリティリスクのバランスを考慮した運用体制の構築が急務となっています。

ReAlice株式会社 AIコンサルタント

ReAlice株式会社 AIコンサルタント正規ドメインと高度なAiTM技術を組み合わせた新たな脅威モデルを示しています。特に、信頼性の高い業務ツールを装うことで、従来のメールセキュリティ対策をすり抜ける点が深刻です。企業は、正規サービス経由の攻撃も想定したゼロトラスト設計と、多要素認証の徹底を急ぐべきです。

Gammaツール自体の安全性を検証

それでは、Gamma自体のセキュリティ対策はどうなっているのでしょうか。ここからはツール運営側が実施している保護施策を確認していきます。

運営元が実施しているセキュリティ対策

Gammaの運営元は、ユーザーデータ保護のために複数のセキュリティ対策を実施しています。データ送信時にTLS 1.2以上のプロトコルを採用し、通信内容を暗号化することで第三者による盗聴を防ぐ仕組みです。

また、ゼロトラストアーキテクチャを導入することで、ユーザーのアイデンティティとコンテキストに基づいたアクセス制御を実現し、内部および外部からの脅威に対する防御を強化しました。これらの対策により、基本的なセキュリティレベルは確保されていると言えます。

AES-256暗号化とデータ保護の取り組み

保存データの保護には、AES-256暗号化という世界中の業界で信頼されている暗号化標準が採用されています。仮に権限のない第三者がストレージにアクセスしても、暗号化されたデータを解読することはほぼ不可能です。

定期的なキーローテーションの実施により暗号化をさらに強化し、攻撃者が脆弱性を悪用しにくい環境を維持する取り組みも行われています。OAuth 2.0トークンを使用した安全なAPIアクセスも提供されており、企業の認証情報を必要とせず取り消し可能なトークンで資格情報の盗難リスクを軽減できます。このような多層的な防御策が、企業利用における信頼性の基盤となっています。

GammaはTLS 1.2以上やAES-256暗号化など、業界標準のセキュリティ技術を採用しており、通信・保存の両面で高い安全性を確保しています。さらにゼロトラストアーキテクチャとOAuth 2.0による多層防御設計は、企業利用におけるリスク低減に有効です。

生成AIツール利用時の情報漏洩リスク

Gamma自体のセキュリティ対策に加えて、生成AIツール全般に共通する情報漏洩リスクについても理解しておく必要があります。ここでは、AIツール利用時に企業が直面する典型的なリスクを解説します。

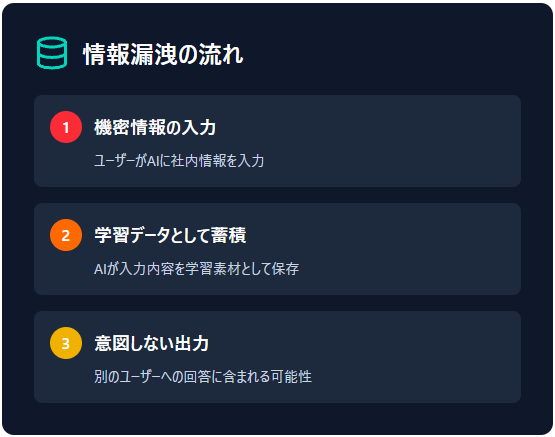

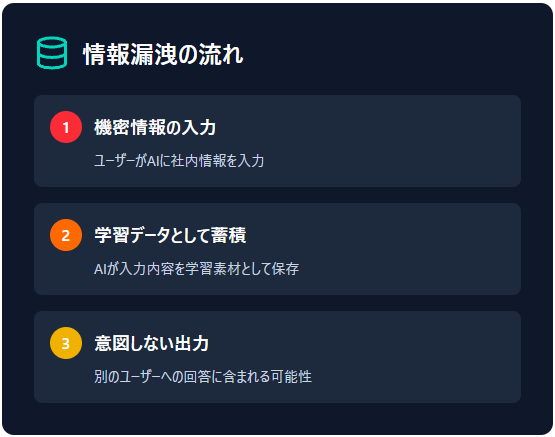

プロンプトに入力した情報が学習データになる危険性

一部の生成AIツールでは、ユーザーが入力したテキストを学習データとして蓄積し、今後の回答精度を高めるために利用する仕組みを持っています。企業の機密情報や個人情報を入力すると、AIが学習し、将来的に別のユーザーの質問に対する回答として意図せず出力されるリスクがあります。

AIは情報の重要性や機密性を自動で判断できないため、サービスによっては入力された内容を学習素材として処理してしまう点に注意が必要です。多くのサービスでは学習のオプトアウト設定が可能ですが、この仕組みを理解せずにツールを利用すると、知らないうちに社内情報が外部に流出する恐れがあります。

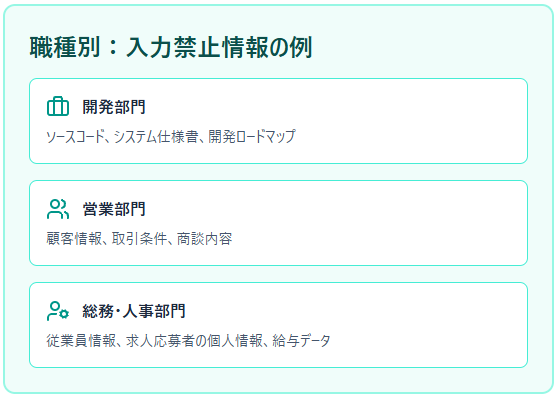

機密情報を入力してはいけない理由

製品仕様に関するメモ、ソースコード、プロジェクト名、顧客名簿、社内文書などの機密情報を生成AIに入力すると、深刻な情報漏洩につながる可能性があります。データの学習をオプトアウトしていても、クラウド上に保存された時点で外部アクセスのリスクは生じるためです。

プロンプトインジェクション攻撃など、AIのセキュリティ脆弱性を悪用した攻撃手法も存在します。企業は従業員に対して、どのような情報が機密に該当するのかを明確に定義し、周知徹底する必要があります。

実際に起きた企業の情報漏洩トラブル事例

それでは、実際にどのような情報漏洩事故が発生しているのか見ていきましょう。以下の事例から、生成AI利用時のリスクを具体的に理解できます。

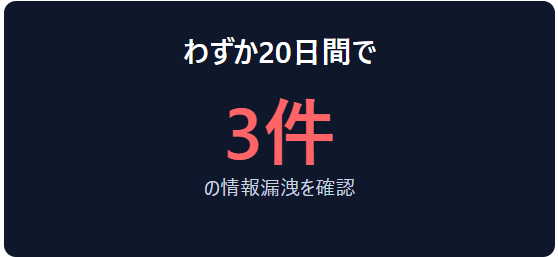

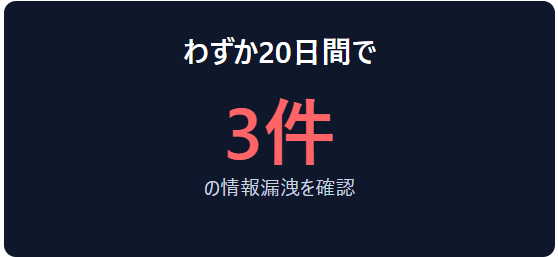

サムスン電子の機密情報漏洩事例

2023年4月、韓国のサムスン電子において、エンジニアがChatGPTに社内のソースコードや機密情報を入力し、重大な情報漏洩事故が発生しました。ChatGPTの利用を許可してからわずか20日という短期間で3件の情報漏洩が確認され、半導体設備のソースコード、歩留まり関連プログラム、会議内容が外部サーバーに保存される事態となりました。

サムスン電子は緊急措置としてChatGPTへの1質問あたりのアップロード容量を1,024バイトに制限し、従業員に対して知的財産や会社関連の情報、個人データを入力しないよう厳重に注意喚起しました。この事例は、従業員教育の重要性と利用ルールの明確化がいかに重要かを示しています。企業がAIツールを導入する際は、事前の利用ガイドライン策定と従業員への徹底した教育が不可欠です。

AIは文脈や機密度を自動的に判断できないため、人為的な誤入力こそが最大の脅威です。特にクラウド環境では、オプトアウト設定だけでは十分ではなく、社内ルールと教育による運用管理が欠かせません。

Gammaを悪用したサイバー攻撃の全容

ここからは、Gammaを悪用したサイバー攻撃の技術的な詳細と、攻撃者がどのような手法を用いているのかを掘り下げて解説します。

Abnormal Securityが報告したAiTM攻撃とは

Adversary-in-the-Middle(AiTM)攻撃は、攻撃者がユーザーと正規サービスの間に立ち、通信内容を盗聴・改ざんする高度な手法です。Gammaを悪用したフィッシング攻撃では、この技術を活用してユーザーが入力した認証情報をリアルタイムで検証し、正規のMicrosoftサーバーと通信しながら窃取しました。

従来のフィッシング攻撃と決定的に異なるのは、AiTM技術を用いた攻撃が一般的に多要素認証(MFA)を突破する能力を持つ点です。企業がMFAを導入していても、この種の攻撃手法の前では無力化される危険性があります。

Cloudflare Turnstileによる検知回避技術

攻撃者はCloudflare Turnstileというボット検出システムを利用して、セキュリティスキャナーによる自動分析を巧みに回避しています。このCAPTCHA機能により、人間のユーザーだけがフィッシングページにアクセスできるようになり、セキュリティツールによる事前検知が極めて困難になりました。

この認証ステップが攻撃の正当性を高め、ユーザーが疑いを持ちにくくする心理的効果も生んでいる点が巧妙です。従来のセキュリティ対策だけでは防ぎきれない新たな脅威と言えるでしょう。

多段階攻撃で従業員を騙す手法

攻撃者は単一の手法ではなく、複数のステップを組み合わせた多段階攻撃を展開しています。各ステップで正規のプロセスを模倣することで、従業員の警戒心を解く狙いがあります。

PDF添付を装ったメール送信

攻撃の第一段階では、正規の侵害されたアカウントからフィッシングメールが送信されます。メールにはPDF文書の添付が示唆されていますが、実際にはGammaプレゼンテーションページへのリンクが埋め込まれている点が特徴です。

従業員が信頼できる送信者からのメールと判断しやすく、添付ファイルを開く感覚でリンクをクリックしてしまう危険性があります。社内の既知のアカウントからの送信であることが、攻撃成功率を大幅に高めています。

偽のMicrosoft SharePointログインページへの誘導

Gammaページには「Review Secure Documents」というボタンが配置されており、クリックするとMicrosoft SharePointを装った中間ページに遷移する仕組みです。この中間ページでCloudflare Turnstileによる認証ステップを経た後、最終的に偽のSharePointログインページに誘導され、認証情報の入力を求められます。

この多段階の手法により、ユーザーは各ステップで正規のプロセスだと錯覚し、警戒心を解いてしまう傾向があります。企業は従業員に対して、こうした手口を事前に周知し、不審なログインページでの認証情報入力を避けるよう教育する必要があります。

正規サービスの信頼性と多段階誘導を巧妙に組み合わせた新しい脅威モデルです。特にCloudflare Turnstileを用いた検知回避や、MFAをすり抜ける中間者攻撃の仕組みは、従来の防御策では対応しきれません。

企業がGamma利用時に講じるべき対策

これまで見てきたリスクに対して、企業はどのような対策を講じるべきでしょうか。ここでは実践的な防御策を解説します。

生成AI利用ガイドライン策定のポイント

企業で生成AIを安全に活用するには、明確な利用ルールの策定と全従業員への周知徹底が不可欠です。

ルールを周知する際は、単に禁止事項を並べるだけでなく、他社で発生した情報漏洩事例や法的リスクを交えて説明することで、従業員の理解と協力を得やすくなります。

AIコンサルタントの視点から見ると、ガイドライン策定時には経営層・IT部門・法務部門が連携し、実効性のある運用体制を構築することが成功の鍵となります。

従業員向けセキュリティ教育の実施方法

従業員に対するセキュリティトレーニングを定期的に実施し、データ保護の重要性や適切な情報管理方法について学ぶ機会を提供することが求められます。

- フィッシングメールの見分け方を実例で学習

- 不審なリンクへのアクセス回避方法の実践

- パスワード管理の重要性とツールの活用

- 実際の攻撃メールを用いた模擬訓練

単発の研修ではなく、継続的な啓蒙活動により従業員一人ひとりの意識を高めていくアプローチが効果的です。実際の攻撃メールを用いた模擬訓練を実施することで、理論だけでなく実践的な対応力を養うことができます。

アクセス権限とデータ管理のルール整備

AIツールの利便性を損なわずにセキュリティを確保するには、適切なアクセス権限の設定とデータ管理が重要です。ここでは具体的な対策を見ていきましょう。

共有設定と権限管理の徹底

プレゼンテーション資料には、必要最小限のメンバーのみがアクセスできるよう適切な権限設定を行うことが重要です。特に機密性の高い資料については、社外への共有を制限し、社内メンバーのみに限定する設定を徹底しましょう。

権限の過剰付与は情報漏洩リスクを高めるため、定期的に共有設定を見直す運用も有効です。また、共有リンクを開く前に送信者を確認し、見覚えのないリンクは慎重に扱う習慣を身につけることが大切です。

技術的対策よりも「運用と教育」の整備が鍵となります。特にガイドラインの策定では、IT部門だけでなく経営層・法務部門を巻き込んだ全社的な枠組みが不可欠です。さらに、定期的なセキュリティ訓練と権限管理の見直しを組み合わせることで、人的ミスや不正アクセスを未然に防ぐ実効性の高い体制を構築できます。

安全にGammaを使うための5つの実践方法

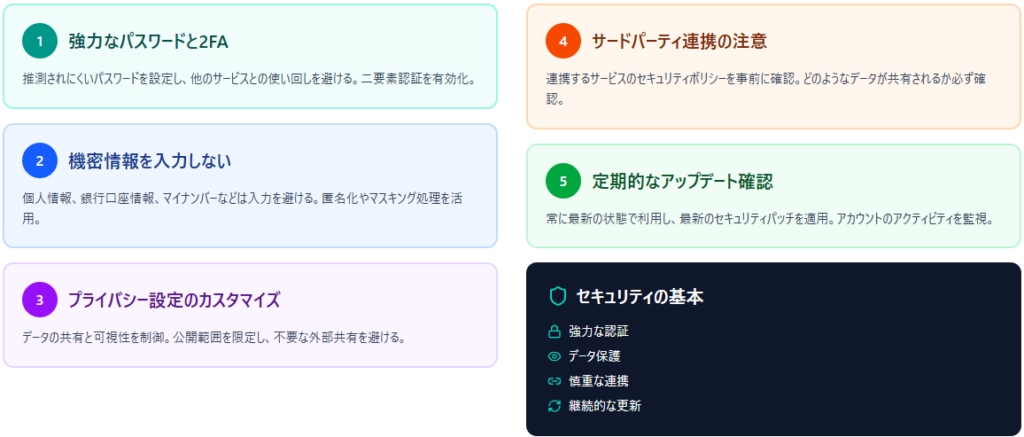

ここからは、日常業務でGammaを安全に利用するための具体的な実践方法をご紹介します。

アカウントのセキュリティを強化するため、推測されにくい強力なパスワードを設定し、他のサービスとの使い回しを避けることが基本です。

さらに、アカウントのセキュリティ設定で二要素認証(2FA)が利用できる場合は有効にすることで、パスワードが漏洩した場合でも不正アクセスを防げます。パスワード管理ツールを活用すれば、複雑なパスワードでも安全に管理できるためおすすめです。

氏名、住所、メールアドレス、電話番号、銀行口座情報、クレジットカード情報、マイナンバーといった個人を特定可能な情報は、AIに一度入力しただけでも学習データに含まれて再出力されるリスクがあるため、入力を避けるべきです。

安全性を高める方法として、匿名化やマスキング処理を施したデータでAIに指示を出す運用が有効です。顧客情報を扱う場合は「顧客A」「顧客B」といった仮名を使うなど、工夫次第でAIツールの利便性を保ちながらリスクを低減できます。

Gammaのプライバシー設定をカスタマイズし、データの共有と可視性を制御することで、個人情報をより細かく管理できます。

プレゼンテーションの公開範囲を限定し、不要な外部共有を避ける設定を行いましょう。初期設定のままではセキュリティレベルが不十分な場合もあるため、導入時に必ず設定を確認することが重要です。

Gammaは他のサービスと連携できる機能を持っていますが、サードパーティ統合には潜在的なリスクが伴います。連携するサービスのセキュリティポリシーを事前に確認し、信頼できるサービスのみと連携することが重要です。

連携を許可する前に、どのようなデータがサードパーティに共有されるのかを必ず確認しましょう。

Gammaを常に最新の状態で利用することで、最新の機能やセキュリティパッチを利用でき、既知の脆弱性から保護されます。定期的なアップデートの実施を習慣化し、アカウントのアクティビティを積極的に監視することで、不審な行動を早期に検出できます。

定期的にサービスの更新情報を確認しておくと、手動での更新忘れを防げるため推奨されます。

技術的設定と日常的な運用ルールの両立が欠かせません。特に二要素認証の有効化やプライバシー設定の見直しは、初期段階で必ず行うべき基本対策です。さらに、機密情報のマスキングや信頼性の低い外部連携の制限を徹底することで、リスクを大幅に軽減できます。

Gamma以外の生成AIツールにも共通するリスク

Gammaに限らず、他の生成AIツールでも同様のセキュリティリスクが存在します。ここでは汎用的な対策を確認しましょう。

ChatGPTやClaude利用時の情報漏洩対策

ChatGPTやClaudeなど他の生成AIツールでも、ユーザーが入力したデータが学習に利用される可能性があるため、機密情報の入力を避けることが基本です。

ChatGPTでは「すべての人のためにモデルを改善する」をオフにすることで学習をオプトアウトできますが、OpenAIはセキュリティ上の理由から最大30日間プロンプトのデータを保持する仕組みがあります。完全な情報保護を求める場合は、企業向けプランやAPI経由での利用を検討すべきです。

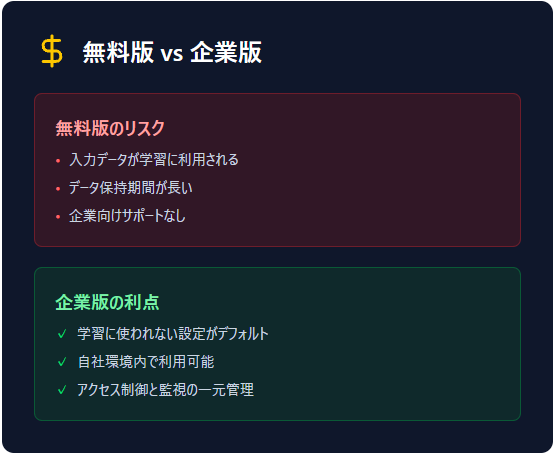

無料版AIツールと企業版の違い

無料版の生成AIツールでは入力データが学習に利用されるリスクが高い一方、企業版やAPI経由での利用では学習に使われない設定がデフォルトになっている場合が多くなっています。

ChatGPT APIやAzure OpenAI Serviceを活用すれば、企業の自社環境内で生成AIの機能を利用でき、アクセス制御や監視などのセキュリティ対策も社内システムと一元管理しやすくなります。

コスト面では無料版が魅力的ですが、情報漏洩リスクを考慮すると企業版の導入が賢明な選択と言えるでしょう。

ビジネス層が選ぶべきAIツールの基準

企業でAIツールを選定する際は、データ保護機能、コンプライアンス対応、サポート体制を重視することが重要です。Microsoft 365 Copilotのように、入力されたデータが保護され、AIの学習に利用されない企業向けツールを選ぶことで、セキュリティと利便性を両立した形で生成AIを活用できます。

AIコンサルタントの立場から見ると、初期コストよりも長期的なリスク管理を優先し、自社のセキュリティポリシーに適合したツールを選定することが業務効率化の成功につながります。

「利便性とセキュリティのトレードオフ」を正しく理解することです。特に無料版では入力データが学習対象となるケースが多く、企業環境での利用にはリスクが伴います。API経由や企業向けプランを採用することで、データ保護やアクセス制御を自社ポリシーに沿って運用できる点が大きな利点です。

よくある質問|Gammaの情報漏洩リスクと安全対策

Gammaに入力した情報は他のユーザーに見られますか?

Gammaは基本的にユーザーが作成したプレゼンテーションを他のユーザーに公開しない仕様になっていますが、共有設定を誤ると意図しない第三者にアクセスされる可能性があります。

共有リンクを発行する際は、アクセス権限を適切に設定することが重要です。公開範囲を「リンクを知っている全員」ではなく「特定のユーザーのみ」に設定し、閲覧・編集・コメントなどの権限を必要最小限に制限することで、情報漏洩リスクを大幅に低減できます。

無料版と有料版でセキュリティレベルは変わりますか?

無料版でも基本的なセキュリティ対策(AES-256暗号化、TLS 1.2以上の通信など)は提供されています。Proプランではパスワード保護機能などの追加セキュリティ機能が利用可能です。また、Gammaでは二要素認証(2FA)機能も提供されています。

機密性の高い資料を扱う場合は、二要素認証を有効にし、適切なアクセス権限設定を行うことをおすすめします。特に金融機関や医療機関など、高度なセキュリティが求められる業種では、これらのセキュリティ機能を最大限活用することが重要です。

Gammaのフィッシング攻撃メールを見分ける方法は?

送信者のメールアドレスを慎重に確認し、普段やり取りのない相手や不自然なドメインからのメールには警戒が必要です。

- PDF添付を装っているのにリンクのみが含まれている

- 緊急性を強調して即座のアクションを求める

- マウスオーバーして実際のURLを確認すると不審なドメイン

リンクをクリックする前に、マウスオーバーして実際のURLを確認する習慣をつけることも有効です。

企業でGammaを導入する際の最低限の対策は?

利用ガイドラインの策定、従業員へのセキュリティ教育、二要素認証の有効化、アクセス権限の適切な設定が最低限必要となります。さらにUTM(統合脅威管理)のようなセキュリティ対策ツールを導入し、指定されたAIサイトへのアクセス制限やログの取得を行うことで、技術的に補完することが推奨されます。

導入前にトライアル期間を設けて、自社のセキュリティ要件に適合するか検証することも重要です。

情報漏洩が起きた場合の対処法を教えてください

情報漏洩が発生した場合は、直ちにアカウントのパスワードを変更し、二要素認証を有効にして不正アクセスを防ぎます。影響を受けた可能性のあるデータの範囲を特定し、関連する取引先や顧客への通知、監督官庁への報告など、法的に必要な対応を速やかに実施することが重要です。

初動対応の遅れが被害を拡大させるため、インシデント対応マニュアルを事前に整備しておくことをおすすめします。