GitHub Copilotで情報漏洩が起こる理由とは?企業が今すぐ実践すべき5つのセキュリティ対策

GitHub Copilotを導入する企業が急増する中、「情報漏洩リスクは大丈夫?」「セキュリティ対策はどうすれば?」といった不安を抱える開発現場も多いのではないでしょうか。

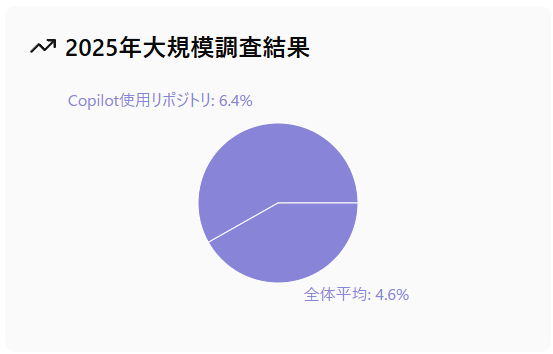

実際に、GitGuardianの2025年調査では、Copilot利用環境の6.4%で機密情報の漏洩が確認されており、適切な対策なしに導入することの危険性が浮き彫りになっています。

また、ニューヨーク大学の研究では、GitHub Copilotが生成したコードの40.73%に脆弱性が含まれていることが判明し、AIコーディングツールの利便性と引き換えに生じるセキュリティリスクへの関心が高まっています。一方で、適切な設定と運用手順を確立すれば、これらのリスクは大幅に軽減できることも分かってきました。

本記事では、GitHub Copilotによる情報漏洩が起こる具体的な理由から、VSCode環境での実践的なセキュリティ設定、企業向けプランの違い、インシデント対応まで、企業が今すぐ実践すべき5つのセキュリティ対策を詳しく解説します。

- GitHub Copilotで情報漏洩が実際に起こる理由

- 個人向けと企業向けプランの違い|Business・Enterpriseプランの高度なセキュリティ機能

- VSCode環境での具体的なセキュリティ設定方法と機密ファイルの除外手順

- 企業導入時に必須の運用ガイドライン

- セキュリティインシデント発生時の対応フローと継続的な監視体制の構築方法

GitHub Copilotで本当に情報漏洩は起こるのか?

パブリックリポジトリのコードを学習したAIモデルが、機密情報を含むコードを提案してしまう現象が実際に観測されています。

この問題の根本原因は、学習データに含まれていた機密情報がモデルに記憶され、類似のコンテキストで再び出力される点にあります。

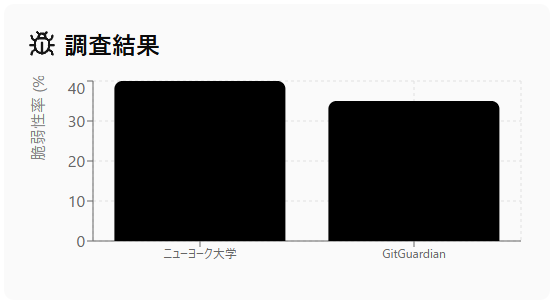

脆弱性を含むコード生成の実態

ニューヨーク大学による1,689個のプログラム分析では、40%に脆弱性が含まれていました。またGitGuardianの調査では35%のCopilot生成コードにセキュリティ上の脆弱性が確認されています。

- CWE-798(ハードコードされた認証情報)

- SQLインジェクション

- パスインジェクション

この調査結果から、生成されたコードには必ずレビュー工程が必要であることが分かります。

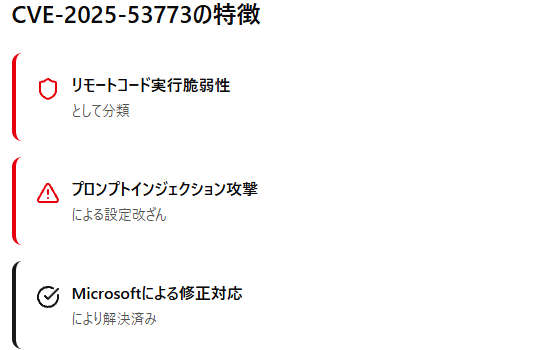

2025年に発生したCVE-2025-53773とは

8月に発見されたこの脆弱性は、GitHub Copilotにおけるリモートコード実行の問題として報告されました。プロンプトインジェクション攻撃により、システムの設定改ざんが可能となる脆弱性です。

この事例は、AI開発ツールの潜在リスクを示す重要な教訓となりました。

GitGuardianの調査で判明した実際の漏洩率

2025年の大規模調査で明らかになった数値は驚くべきものでした。GitHub Copilotを使用するパブリックリポジトリの漏洩率6.4%は、全体平均4.6%を大きく上回っています。

詳細分析では、8,127件の提案中2,702件で機密情報らしき記述が生成され、1回の提案あたり平均0.33件の本物の機密情報が含まれる可能性が示されました。この統計データは、偶発的な情報漏洩が現実的な脅威であることを物語っています。

ReAlice株式会社 AIコンサルタント

ReAlice株式会社 AIコンサルタントGitHub Copilotによる情報漏洩リスクは「理論上の懸念」ではなく、統計的にも実証されている現実的な脅威です。学習過程で取り込まれた機密情報が、類似コンテキストで再生成される可能性がある以上、生成コードのレビューとセキュリティチェックは必須です。

個人向けと企業向けプランのセキュリティ機能の違い

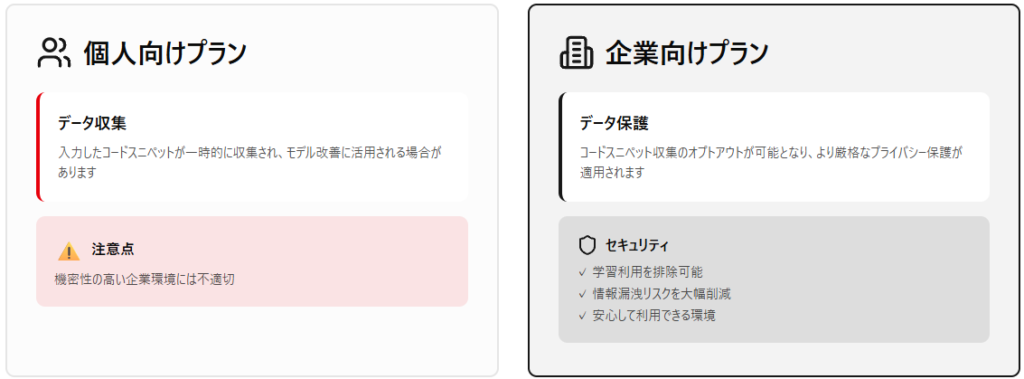

プラン選択によって、データの取り扱い方針が根本的に変わります。

個人向けプランでは、入力したコードスニペットが一時的に収集され、モデル改善に活用される場合があります。企業向けプランでは、コードスニペット収集のオプトアウトが可能となり、より厳格なプライバシー保護が適用されます。

Copilot Businessプランの管理機能

組織管理者による一元管理機能が特徴的です。組織全体でのポリシー管理、パブリックコード一致提案のブロック、指定ファイルの除外、監査ログによるプライバシー強化が可能となります。SAML SSO認証やIP制限機能により、エンタープライズレベルのセキュリティ基準をクリアしています。

多くの企業では、このプランを活用して開発チーム全体のCopilot利用を統制し、企業のセキュリティポリシーに準拠した運用を実現しています。

Copilot Enterpriseプランの高度なセキュリティ

エンタープライズアカウントによる複数組織横断管理が最大の特徴です。GitHub Enterprise Cloudのセキュリティプロトコルに準拠し、カスタムセキュリティポリシー、専用サポート、監査ログAPIが提供されます。

高度なコンプライアンス機能により、最高レベルのセキュリティが求められる環境での運用が可能となり、業界最高水準の保護機能を備えています。

- 複数組織横断での統括管理

- カスタムセキュリティポリシー提供

- 監査ログAPI活用可能

- 高度なコンプライアンス機能

様々な業界で、Enterpriseプランの機能を活用し、厳格な規制要件に適合したCopilot運用体制が構築されています。

プラン別データ取り扱いポリシーの比較

データ処理方針に明確な違いがあります。個人向けプランでは、コードスニペットが収集される可能性があるため、機密性の高い企業環境には不適切です。

Business・Enterpriseプランでは、コードスニペット収集のオプトアウトが可能で、学習利用を排除できます。この仕様差により、企業向けプランでは情報漏洩リスクを大幅に削減し、安心して利用できる環境が整備されています。

個人向けプランは利便性重視で、コード収集や学習利用の仕組みが残るため、企業利用にはリスクが伴います。一方、Businessプランでは一元的な利用統制とログ監査が可能になり、運用ポリシーを企業側で細かく設定できます。さらにEnterpriseプランでは、複数組織を横断した高度なセキュリティ運用が可能で、厳格な法規制がある業界にも対応できます。

情報漏洩を防ぐ実践的な設定方法と運用手順

安全な利用には正しい設定が不可欠です。基本対策として、GitHubの設定画面で「Allow GitHub to use my data for product improvements」のチェックを外し、データ学習への協力を停止できます。

この設定だけでも、個人向けプランでのリスクを大幅に軽減できます。

VSCode環境での具体的なセキュリティ設定

settings.jsonファイルでの詳細設定が効果的です。

機密情報を含むファイル(.env、config.json、データベース設定など)を除外設定に指定し、提案対象から除外します。

"github.copilot.advanced": {

"excludeFiles": [

"**/*.env",

"**/config.json",

"**/database.yml",

"**/*.key",

"**/*.pem"

]

}多くの企業では、開発環境全体でこれらの設定を標準化し、機密情報の自動除外によってリスクを大幅に削減しています。

パブリックコード一致提案の抑制設定

「Suggestions matching public code」を「Block」に変更する設定が重要です。

Apache 2.0ライセンスなど既存のオープンソースコードとの完全一致を抑制し、意図しないライセンス違反を防げます。多くの企業では、この機能を全社で標準設定とし、オープンソースライセンスへの適切な対応を実現しています。

機密ファイルの除外設定方法

.gitignoreファイルとの連携による包括的対応が有効です。環境変数ファイル(.env*)、設定ファイル(config.、settings.)、証明書ファイル(.pem、.key)を自動除外対象とし、開発者の設定ミスによる情報漏洩を防ぎます。

多くの組織では、組織全体で統一された除外ルールを適用し、新入社員でも安全にCopilotを利用できる環境を整備しています。

データ学習の無効化や機密ファイルの提案除外設定は、情報漏洩リスクを大幅に低減できます。VSCodeや.gitignoreと連携した多層的な設定は、個人任せの対策よりも実効性が高く、組織全体で標準化すべき基本施策といえるでしょう。

企業導入時に確立すべき運用ガイドライン

企業レベルでの安全な導入には、技術的対策と組織的対策の両面からアプローチする必要があります。利用ポリシーの策定、従業員教育の実施、技術的防御策の導入を三本柱とした運用体制の構築が効果的です。

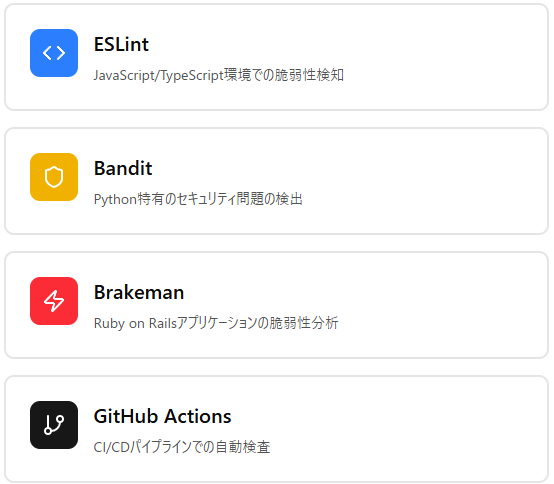

静的解析ツールとの組み合わせによる多層防御

ESLint(JavaScript/TypeScript)、Bandit(Python)、Brakeman(Ruby on Rails)などの静的解析ツールとの連携が重要です。ハードコードされた認証情報や脆弱性の自動検出により、Copilotで生成されたコードの安全性を担保します。

多くの企業では、GitHub ActionsにSASTツールを組み込み、Copilot生成コードの自動脆弱性検査を実現し、開発効率とセキュリティを両立させています。

GitHub Secret Scanningとの連携活用

Secret Scanning機能の有効化により、APIキーやパスワードを含むファイルを自動検知できます。Push protection設定と組み合わせることで、機密情報のリポジトリ誤投入を防止します。

「Push protection for yourself」を有効にするだけで、既存のセキュリティ体制を強化可能です。

GitHubの設定画面から「Security」→「Code security and analysis」で機能を有効化

個人設定で「Push protection for yourself」を有効化し、機密情報の誤投入を防止

組織管理者による一括設定で、全メンバーに対してセキュリティ機能を強制適用

多くの企業では、Secret Scanningと社内セキュリティツールを連携させ、機密情報の検出から対応まで自動化したフローを構築しています。

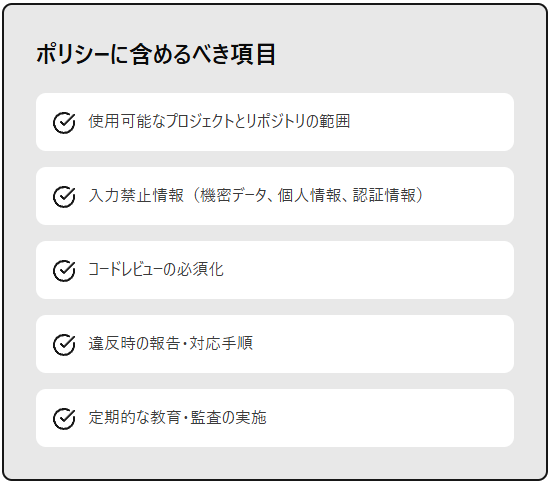

利用ポリシーの明文化と従業員教育

使用可能プロジェクトの明確化、入力禁止情報の具体的な定義、違反時の対応手順の策定が必要です。従業員教育では、セキュリティリスクの理解促進と正しい使用方法の習得を目的とした継続的な研修を実施します。

多くの企業では、AI開発ツール利用ガイドラインを策定し、全開発者向けの定期研修により適切な利用方法の組織内浸透を図っています。

静的解析ツールやSecret Scanningとの連携は、ヒューマンエラーを補完し、生成コードの安全性を自動で担保する有効な手段です。また、利用ポリシーの明文化と継続的な従業員教育により、現場レベルでのセキュリティ意識を高めることが、長期的な運用安定に直結します。

セキュリティインシデント対応と継続的な監視体制

セキュリティ事故発生時の対応準備が重要です。インシデント検知、初動対応、影響範囲の特定、関係者への連絡、復旧作業、事後検証までの一連の流れを事前に整備しておく必要があります。

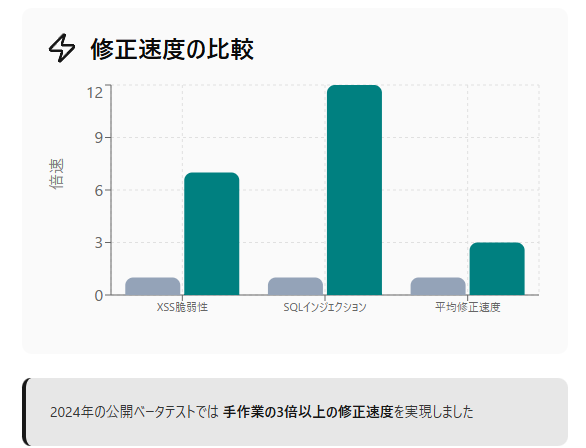

Copilot Autofixによる脆弱性の自動修正

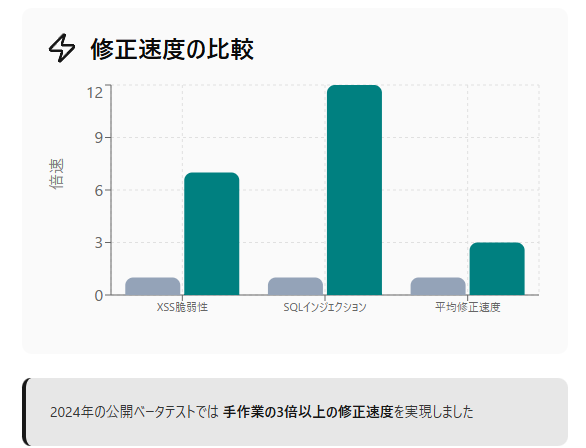

GitHub Advanced SecurityのCopilot Autofixは、AIによる脆弱性分析と修正コード生成を行います。SQLインジェクション、クロスサイトスクリプティングなど数十種類の脆弱性に対応し、2024年の公開ベータテストでは手作業の3倍以上の修正速度を実現しました。特にXSS脆弱性は7倍速く、SQLインジェクションは12倍速く修正可能となっています。

多くの企業では、Autofixによる自動脆弱性修正でセキュリティパッチ適用時間を大幅に短縮し、開発チームの生産性向上を達成しています。

この機能の活用により、修正作業の効率化、ヒューマンエラーの削減、学習コストの低減が見込めます。

GitHub Advanced Securityのライセンスがあれば、組織や企業が所有するすべてのリポジトリで利用可能です。

インシデント発生時の対応フロー

GitHub Copilotに起因する情報漏洩疑いが生じた場合、即座にアクセス権限の停止、影響範囲の特定、関係者への連絡を実行します。時系列での明確な手順定義により、被害拡大の防止と迅速な復旧を目指します。

- 該当ユーザーのCopilotアクセス権限停止

- 関連リポジトリの一時的なアクセス制限

- インシデント対応チームへの即時連絡

- Copilot利用ログの詳細分析

- 漏洩の可能性がある機密情報の特定

- 影響を受けるシステムの範囲確定

- 必要に応じたパスワード・トークン変更

- セキュリティ設定の見直し

- 再発防止策の策定と実装

多くの企業では、AI開発ツール専用のインシデント対応チームを設置し、24時間体制での監視と迅速な対応体制を整備しています。

定期的な監査とポリシー見直しの重要性

新たな脅威への対応として、四半期ごとのセキュリティ評価とポリシー更新が効果的です。技術進歩と脅威の変化に応じて、常に最新のセキュリティレベルを維持する必要があります。

多くの企業では、AI活用セキュリティ委員会を設置し、定期的なリスク評価と対策見直しによって継続的なセキュリティ向上を実現しています。

- セキュリティインシデントの振り返りと対策効果の検証

- 新しい脅威情報への対応策追加

- 利用ガイドラインの改訂と従業員教育内容の更新

- 技術的対策の有効性評価とツールのアップデート

ログの監視と異常検知体制の構築も重要な要素です。通常と異なる時間帯からのアクセス、一度に大量のコードが生成・保存される状況、不自然なAPI呼び出しの繰り返しなど、不審な挙動を監視する仕組みが必要となります。

SIEM(セキュリティ情報イベント管理)ツールやEDR(エンドポイント検出と対応)ツールの導入により、包括的な監視体制を構築できます。

Autofixのような自動修正機能を活用することで、脆弱性対応のスピードと精度を飛躍的に高められますが、それだけで安全性が担保されるわけではありません。事前に明確な対応フローを策定し、ログ監視や定期的なリスクレビューを組み合わせることで、初動の遅れや見落としを防ぎ、実効性の高いセキュリティ運用が可能になります。

よくある質問|GitHub Copilotの情報漏洩対策について

GitHub Copilotは完全に安全なツールと考えて良いですか?

適切な設定と運用によりリスクを大幅に軽減できますが、完全な安全性は保証されません。

入力値検証の不備や古いライブラリ利用による脆弱性混入の可能性があるため、生成コードの必須レビューが重要となります。

企業向けプランの採用と総合的なセキュリティ対策により、許容可能なレベルまでリスクを抑制することは十分に可能です。

- 生成されたコードには必ずセキュリティレビューを実施

- 静的解析ツールやSASTツールを活用した自動チェック

- ペネトレーションテストによる実践的な脆弱性確認

- セキュリティ知識を持つ開発者によるレビュー体制

脆弱性が含まれた場合の責任はどこにありますか?

生成されたコードに脆弱性があった場合、最終的な責任は開発者と組織にあります。Copilotはコンテキストに基づいてコードを生成するツールであり、出力内容の品質保証は利用者側の責任となります。生成されたコードに対する徹底的なレビューとテスト実施が不可欠です。

GitHub Copilotが学習する大量のコードには脆弱性のあるものも含まれており、そのため生成されたコードをそのまま利用すると、アプリケーションに脆弱性が混入するリスクがあります。組織のセキュリティポリシーやコンプライアンス要件を考慮し、適切なレビュー体制を確立することが重要です。

機密情報流出のリスクはどの程度現実的ですか?

Business・Enterpriseプランでは、プライベートリポジトリのコードが学習対象外となり、データ保持も行われないため、流出リスクは大幅に低減されます。

個人向けプランでは一時的なデータ収集の可能性があるため、適切な設定による対策が必要です。GitGuardianの6.4%漏洩率は主にパブリックリポジトリの事例であり、適切な運用により企業環境でのリスクは大幅に削減可能です。

他のAIコーディングツールと比較した安全性はどうですか?

GitHub Copilotの企業向けプランは、充実したセキュリティ機能を提供しています。SOC 2 Type IIやISO/IEC 27001認証の取得、エンタープライズレベルの管理機能、専用サポート体制など、企業利用に特化した安全性の高いソリューションとなっています。

一方、CursorもSOC 2認証を取得しており、プライバシーモードやSAML/OIDC SSOに対応するなど、企業利用に必要なセキュリティレベルを提供しています。ただし、GitHub Copilotの方がセキュリティポリシーの細かい制御や一元管理機能で優位性があります。

GitHub Copilotは、提案が生成される前にセキュアではないコーディングパターンをブロックするAIベースの脆弱性防止システムを適用しています。ハードコードされた資格情報、SQLインジェクション、パスインジェクションなど、最も一般的な脆弱なコーディングパターンに対する防御機能が組み込まれており、企業向けセキュリティ機能において高い水準を維持しています。

ライセンス違反のリスクはありますか?

オープンソースライセンスに基づくコードが提案される場合、ライセンス違反の可能性があります。Apache 2.0ライセンスなどのコードを適切な帰属表示なしに利用すると違反となるリスクがあります。「duplication detection filter」機能の有効化により、パブリックコードとの一致を回避し、このリスクを大幅に軽減できます。

GitHub Copilotを安全に活用するためには、データ送信設定の確認、生成コードのレビュー体制の確立、ライセンス条項の遵守など、様々な対策を講じる必要があります。

これらの対策を徹底することで、GitHub Copilotのメリットを最大限に活かしつつ、リスクを最小限に抑えることができます。安全な開発環境を構築し、GitHub Copilotを有効活用することで、より効率的で高品質なソフトウェア開発を実現しましょう。