Luma AIの危険性とは?企業導入前に確認すべきセキュリティリスクと対策

「Luma AIをビジネスで使いたいけど、セキュリティは大丈夫?」「商用利用で著作権トラブルに巻き込まれたらどうしよう」そんな不安を抱えていませんか?

Luma AIは9億ドルの資金調達に成功した信頼性の高いAI動画生成ツールですが、ビジネス利用には著作権侵害・個人情報漏洩などのリスクに加え、偽サイトによるマルウェア配布にも注意が必要です。実際に2025年6月には人気を悪用した偽サイトを通じたマルウェア配布キャンペーンが確認され、多くの企業が警戒を強めています。

本記事では、Luma AIの安全性を運営体制・投資家構成から徹底検証し、企業導入前に確認すべき主要なリスクと具体的な対策を解説します。生成AI導入企業が実践する社内ガイドライン策定のステップや、Runway・Pika Labsとの安全性比較、PARCO・KDDIなど国内企業のAI活用事例まで、実務で即活用できる情報を網羅しました。

Luma AIの運営体制と信頼性

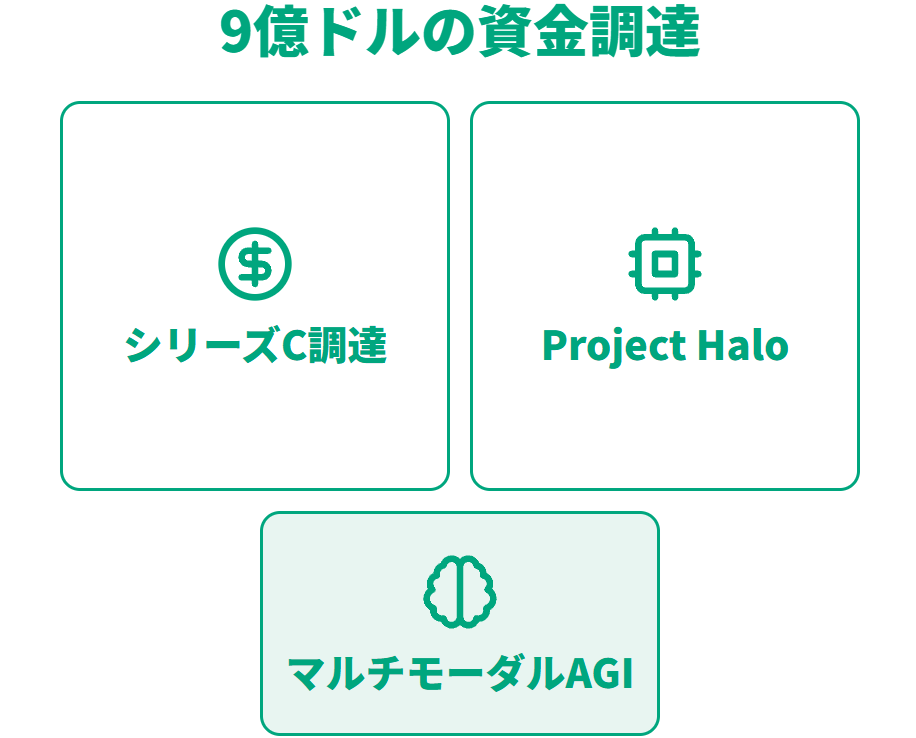

9億ドルの資金調達に成功した企業背景

Luma AIは2025年11月、HUMAINが主導するシリーズC資金調達で9億ドル(約1400億円)を調達しました。本ラウンドにはAMDベンチャーズ、アンドリーセン・ホロウィッツ、アンプリファイ・パートナーズ、マトリックス・パートナーズが参加しています。

調達資金は2ギガワット規模のAIスーパークラスター「Project Halo」構築と、マルチモーダルAGI研究開発に投じられます。累計調達額は10億ドルを超え、財務基盤の強固さを示しています。

カリフォルニア拠点の技術的信頼性

米国カリフォルニア州パロアルトに本社を置くLuma AIは、元Apple AI研究者のAmit Jain(CEO)らが2021年に創業しました。チーフサイエンティフィックアドバイザーにはUC Berkeley教授のAngjoo Kanazawa氏が就任し、学術的な信頼性を担保しています。

旗艦モデルRay3はアドビ製品やAWSに統合され、大手エンターテインメントスタジオや広告代理店で実際に活用されています。米国の法的枠組み内で運営される体制は、ビジネス利用における安心材料となります。

投資家構成から見る安全性評価

投資家にはAndreessen Horowitz、Amazon、NVIDIA、AMD Venturesなど、グローバル企業が名を連ねます。Andreessen Horowitzは2024年1月のシリーズBでもリード投資家を務め、継続的な支援を提供しています。

これらの投資家は厳格な企業調査を経て出資判断を下すため、セキュリティ体制に一定の保証があると考えられます。ただし投資家の存在だけで技術的安全性が保証されるわけではなく、企業独自の評価が求められます。

Luma AIをビジネス利用する際の5つのリスク

運営体制の信頼性を確認したうえで、次は実務で直面する具体的なリスクを見ていきましょう。

著作権・肖像権侵害の可能性

生成した動画の著作権は基本的にユーザーに帰属しますが、元素材が第三者の権利対象である場合は侵害リスクが生じます。他社の商標デザインや著名人の肖像を無断使用した素材から動画を生成すると、権利者からクレームを受ける可能性があります。

生成されたコンテンツの商用利用は有料プラン(Plus、Unlimited、Enterprise)でのみ許可されており、Free/Liteプランは個人利用に制限されます。社内の法務部門による事前確認と、素材の権利関係を明確にする管理体制が欠かせません。

個人情報とプライバシー保護の課題

アップロードしたデータがAI学習に再利用される可能性に注意が必要です。有料プラン(Plus/Unlimited/Enterprise)ではデータ利用が「サービス提供と技術改善」に限定されますが、無料・ライトプランではAIモデルのトレーニングを含む広範な利用が認められています。

顔写真や社員映像を含むコンテンツは、プライバシー侵害のリスクが高まります。機密情報を扱う場合は、利用規約でデータ二次利用条件を精査し、エンタープライズプランの契約を検討すべきでしょう。

Luma AIには生成品質のばらつきと誤認識がある

AI補完アルゴリズムは入力画像の品質に依存するため、低解像度や暗い画像では精度が低下します。顔の変形や不自然な動きが発生する報告があり、ビジネス用途では事前の品質チェックが欠かせません。

日本語プロンプトは利用可能との報告がありますが、公式の言語対応状況は明確でないため、重要な業務では英語での指示を推奨します。生成物の目視確認を怠ると、納品物に不適切な表現が混入するリスクがあるため、人間レビューを組み込んだワークフロー設計を強く推奨します。

偽サイトによるマルウェア感染の危険

2025年6月、ZscalerのThreatLabzチームがLuma AIの人気を悪用したマルウェア配布キャンペーンを確認しました。「Luma AI ブログ」などの検索で上位表示される偽サイトが構築され、Vidar、Lumma、Legion Loaderなどが配布されています。

偽サイトはJavaScriptでブラウザ情報を収集後、マルウェアダウンロードページへ自動リダイレクトする仕組みです。公式サイトからのみアクセスし、検索結果を安易に信頼しない教育が求められます。

不適切コンテンツの意図しない生成

意図しない不適切表現(露出表現、暴力的描写など)が生成されるリスクがあります。利用規約でディープフェイクやアダルトコンテンツは禁止されていますが、AIの特性上、予期せぬ形で規約違反コンテンツが生成される可能性があります。

マーケティング素材として使用する場合、広告表示法や景品表示法に抵触しないよう法務チェックが必要です。生成物を複数名でレビューし、コンプライアンス違反がないか確認するプロセスの必須化をお勧めします。

Luma AIを企業導入する前に確認すべきセキュリティ対策

リスクを理解したら、次は具体的な対策を講じましょう。

社内ガイドライン策定のステップ

安全な利用には「生成AIの利用ガイドライン」策定が欠かせません。生成AI導入の先行事例として、富士通は「生成AI利活用ガイドライン」を公開し、サイダスは利用可能ツールの限定と禁止事項の明文化で段階的導入を実現しました。

ガイドラインには、利用可能な部署・担当者の範囲、アップロード可能データの種類、生成物の商用利用ルール、違反時の対応フローを盛り込みます。まず少人数のパイロットチームで運用し、問題点を洗い出してから全社展開する方法が、リスク最小化と効果最大化を両立させます。

- 利用可能な部署・担当者の範囲

- アップロード可能なデータの種類(公開情報のみ/機密情報禁止)

- 生成物の商用利用ルール

- 違反時の対応フロー

機密情報の取り扱いルール設定

アップロード禁止情報として、顧客の個人情報、未発表の製品情報、社内財務データ、従業員の顔写真を含む動画などを明確化します。生成AIガイドライン策定時は、機密情報・個人情報の入力禁止と第三者の権利侵害可能性のある利用制限を明記します。

使用端末を業務用PCに限定し、私物端末からのアクセスを禁止する方法が実務的です。データ分類ポリシーで「公開情報」「社外秘」「機密」の3段階に素材を分類し、「公開情報」のみアップロード可能とするルール明確化が有効です。

生成物の検証プロセス構築

目視確認フローの設計

生成された動画は、人間による目視確認を経てから公開・納品する体制が必須です。著作権・肖像権侵害の可能性、不適切表現の有無、品質基準(顔の変形・不自然な動きなど)、ブランドガイドラインへの適合性をチェックリスト化します。

2段階レビュー体制が効果的で、第1段階で制作担当者が技術的品質を、第2段階で法務・コンプライアンス担当者が法的リスクを評価します。この体制により見落としリスクを大幅に削減できます。

制作担当者が顔の変形、不自然な動き、画質などの技術的品質を確認

法務・コンプライアンス担当者が著作権、肖像権、不適切表現の有無を評価

品質チェック体制の整備

生成物のバージョン管理、修正履歴の記録、承認フローの明確化が求められます。動画ファイルに「作成日時・担当者・素材の出所・レビュー担当者」をメタデータとして記録し、トレーサビリティを確保しましょう。問題発生時の迅速な原因究明体制がリスク管理の実効性を高めます。

定期的な教育研修とガイドラインの継続的見直し、成果測定と改善プロセスの確立が長期的な品質維持に繋がります。

Luma AIと他のAI動画生成ツールの安全性比較

セキュリティ対策と並行して、他ツールとの比較も検討材料になります。

Runway・Pika Labsとの違い

Luma AI、Runway Gen-4、Pika 2.1を比較すると、生成速度と品質のバランスに差があります。Pika Turboモデルは高速化が特徴で、Runway Gen-4は5秒動画を約30秒で生成します。各ツールの最新の生成速度は公式情報を参照してください。

セキュリティ面では、いずれも米国企業運営で基本的な安全性は確保されていますが、詳細仕様は非公開です。Runway Gen-4は24fps出力と4Kアップスケーリングでプロフェッショナル向け、Luma Dream MachineはRay3でHDR/EXR出力に対応し後処理の柔軟性に優れます。

ビジネス用途に適したツールの選定基準

生成速度、出力品質、ライセンス条件、コストの4軸で評価します。短尺SNS広告やUGC向けにはPika 2.1/Turboの高速生成が適し、製品解説動画やモーショングラフィックスにはLuma Dream Machineのビジュアルアノテーション機能が有用です。

国内では、PARCOが全編AI生成の広告動画を公開し独特な世界観で注目を集め、KDDIも「三太郎」シリーズでAIアニメーションを活用しています。複数ツールを並行評価し、用途別に使い分ける「マルチツール戦略」が効果的です。

- 生成速度:動画の生成にかかる時間

- 出力品質:解像度、フレームレート、HDR対応

- ライセンス条件:商用利用の可否、著作権の帰属

- コスト:月額料金、クレジット制、無料プランの有無

コスト対効果から見た総合評価

Luma AIの商用利用には月額29.99ドルのプラスプラン以上が必須で、無料プランとライトプランは個人利用向けです。プラスプランは月間10,000クレジット、ウォーターマークなし、最大4つの並行生成が可能で、中小企業のマーケティング素材制作に適しています。

エンタープライズプランは月間20,000クレジット以上、処理キューで最高優先度、データプライバシー保証があり、機密情報を扱う大企業向けです。AI動画生成技術の発展により、高品質な商用コンテンツ制作が実現可能になっています。

初期コストを抑えつつ品質確保を目指す企業にはLuma AIのプラスプラン、プロフェッショナル品質最優先ならRunway Gen-4の24fps・4K出力が適しています。

安全にLuma AIを活用するための実践ガイド

比較検討を終えたら、実際の活用シーンを具体的にイメージしましょう。

推奨される利用シーン

社内プレゼンテーション素材の作成

社内会議やプレゼンテーション用のコンセプト動画制作に適しています。機密情報を含まない公開可能な素材のみを使用すれば、リスクは最小化されます。

新製品のアイデア提案動画や社内研修用の説明動画などが該当し、Draft Modeで反復作業を最大10倍高速化し、短時間で複数パターンを生成して最適案を選択できます。

プロトタイプ動画の制作

製品開発の初期段階でコンセプトを視覚化するプロトタイプ動画制作に有効です。大日本除虫菊(KINCHO)は2023年に画像生成AIをブレスト相手として活用し、AIで生成した画像を参考に最終的にCGで制作するアプローチを採用しました。

プロトタイプ段階で顧客フィードバックを得るためのMVP動画制作では、完璧な品質より迅速な仮説検証が優先されるため、Luma AIの特性とマッチします。

避けるべき利用シーン

一方で、リスクが高く避けるべきシーンも明確にしておく必要があります。

顔写真を含むコンテンツの無許可使用

他者の顔写真を無断使用した動画生成は、肖像権侵害の重大なリスクがあります。社員の顔写真であっても、本人の明示的な許可なく動画素材として使用するとプライバシー権侵害で訴訟リスクが生じます。

Luma AIは顔の変形が発生する可能性があり、本人が不快に感じる表現が生成されるケースが報告されています。顔写真使用時は事前に本人から書面で同意を取得し、生成後に本人確認を実施する体制が必須です。

個人情報を含む動画の生成

顧客名簿、社員の個人情報、財務データなど機密性の高い情報を含む動画の生成は絶対に避けるべきです。アップロードしたデータがAI学習に再利用されるリスクがあり、第三者への情報漏洩に繋がる可能性があります。

GDPRや日本の個人情報保護法の観点からも、個人情報の外部プラットフォーム送信は慎重な判断が求められます。個人情報を含む動画が必要な場合は、データプライバシー保証のあるエンタープライズプラン契約、またはオンプレミス環境で動作するAIツール導入を検討すべきです。

段階的導入のベストプラクティス

企業導入は、小規模パイロット運用、効果測定、ガイドライン改善、全社展開の4段階で進めることを推奨します。

第1段階では、マーケティング部門など特定部署の3〜5名に限定し、1〜2か月間の試用期間を設けます。第2段階で生成した動画の活用効果(クリック率・エンゲージメント率など)を定量評価し、投資対効果を算出します。

第3段階でパイロット運用で判明した課題をガイドラインに反映し、より実効性の高いルールに改善します。第4段階で改善されたガイドラインと教育プログラムを準備したうえで全社展開し、大規模な失敗リスクを回避しながら組織全体のAI活用能力を向上させます。

特定部署の3〜5名に限定し、1〜2か月間の試用期間を設定

クリック率・エンゲージメント率などを定量評価し、投資対効果を算出

パイロット運用で判明した課題をガイドラインに反映し、実効性を高める

改善されたガイドラインと教育プログラムを準備したうえで、組織全体に展開

よくある質問|Luma AIの安全性とビジネス活用

生成した動画の著作権は誰に帰属しますか?

生成した動画・3Dモデルの所有権は基本的にユーザーに帰属します 。ただし、有料プランでもLumaにはサービス改善やAIモデル開発のための使用権が付与されます 。元素材が第三者の著作権対象である場合、生成物の著作権主張は制限されます。

商用利用時は、使用素材の権利関係を明確化し、第三者の著作物を参照していないか確認し、必要に応じて法務部門のレビューを受けることで著作権侵害リスクを回避できます。

セキュリティ面で最も注意すべき点は何ですか?

偽サイトによるマルウェア感染と機密情報の漏洩リスクに最も注意が必要です。2025年6月に確認されたマルウェア配布キャンペーンでは、Luma AI関連の検索で上位表示される偽サイトからVidar、Lumma、Legion Loaderなどが配布されました。

必ず公式サイトからアクセスし、検索結果のURLを安易にクリックしない習慣づけが重要です。機密情報や個人情報を含むデータをアップロードしないルールを社内で徹底し、違反時の対応フローを明確化することで情報漏洩リスクを最小化できます。

既存のAI動画生成ツールと比べて安全性は高いですか?

Luma AIの安全性はRunway Gen-4やPika 2.1と同等レベルと評価できます。いずれも米国企業が運営し、Andreessen HorowitzやNVIDIAなどの大手投資家が支援しており、基本的な信頼性は確保されています。ただし各ツールとも詳細なセキュリティ仕様を公開していないため、企業独自のリスク評価が必要です。

いずれのツールも詳細なセキュリティ仕様を公開していないため、絶対的な安全性の比較は困難です。どのツールを選択する場合も、社内ガイドライン策定と検証プロセス構築を前提に導入することをお勧めします。

企業で導入する場合、最初に行うべきことは何ですか?

利用目的の明確化とリスク評価が最初のステップです。Luma AIで何を実現したいのか(マーケティング素材制作、プロトタイプ作成など)、扱うデータの機密性レベル、想定される法的リスク(著作権、肖像権、個人情報保護法など)を洗い出します。

次に3〜5名の小規模パイロットチームを編成し、1〜2か月間の試用期間を設けます。この期間に生成物の品質、ワークフローの適合性、発生した問題を記録し、利用ガイドライン策定の基礎資料とします。生成AI導入の先行企業事例を参考に 、自社に適したガイドライン項目を設計することが成功の鍵です。