Leonardo AI 安全性を企業目線で検証|導入前に確認すべき重要な5項目

「Leonardo AIは本当に安全なのか?」「企業で導入しても情報漏洩のリスクはないのか?」ビジネスでAI画像生成ツールの活用を検討する際、セキュリティへの不安は誰もが抱える悩みです。

Leonardo AIは2024年7月にCanvaに買収され、世界中で1,900万人以上が利用する人気ツールですが、無料プランと有料プランでプライバシー設定が大きく異なることや、データ保護の仕組み、インフラ環境など、企業担当者が知っておくべき重要な情報が数多く存在します。

本記事では、Leonardo AIの安全性について、データ保護、プライバシー管理、Canva買収後の変化、他の画像生成AIとの比較まで、AIコンサルタントの実務視点から徹底解説します。

- 無料プランと有料プランのプライバシー設定の決定的な違いと、プライベートモード機能を活用した情報漏洩リスク回避の具体的な方法

- 2024年7月のCanva買収後のセキュリティ体制の変化と、Canva Shieldによる知的財産権侵害補償制度(エンタープライズ顧客向け)の詳細

- Midjourney・Stable Diffusionとのセキュリティ比較と、コストパフォーマンスと安全性のバランスから見た最適なツール選定基準

- AWSインフラ上での運用とデータ保護の実態、企業導入時の社内ポリシー策定で押さえるべきポイント

- 機密情報を扱う際の運用ルール、継続的なリスク管理の実践方法

Leonardo AIの安全性|企業導入前に確認すべきポイント

Leonardo AIとは?Canva買収で注目される画像生成ツール

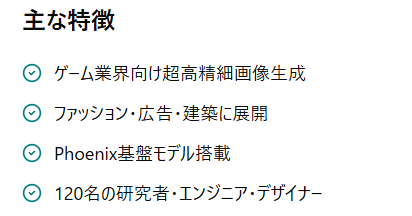

オーストラリアのシドニーを拠点とするLeonardo AIは、2022年12月の設立以降、急成長を遂げた企業です。当初はゲーム業界向けの超高精細画像生成に特化していましたが、その後ファッション、広告、建築など幅広い業界に展開し、登録ユーザー数は1,900万人を超え、過去18カ月で10億枚以上の画像を生成する実績を残しています。

2024年7月のCanva買収では、120名の研究者・エンジニア・デザイナーを擁するチームと、Phoenix基盤モデルがCanvaのAI技術強化に貢献することになりました。

データセキュリティへの取り組み

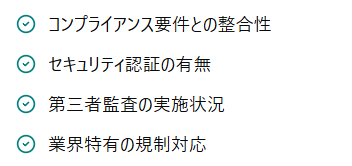

Leonardo AIは、AWSインフラ上で運用され、転送中および保管中のデータに対する暗号化を実施しています。企業導入を検討する際は、自社のコンプライアンス要件に照らし、ベンダーのセキュリティ体制を確認することが重要です。

特に金融機関や医療機関など、コンプライアンス要件の厳しい業界では、セキュリティ認証の有無や第三者監査の実施状況が導入可否判断の重要な材料となります。

無料プランと有料プランで異なるプライバシー設定

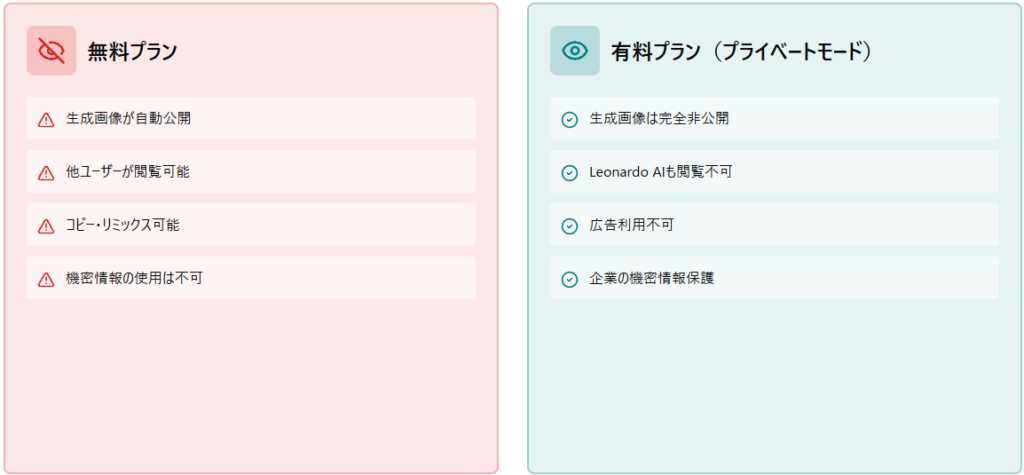

プライバシー設定の違いは、企業が最も注意すべきポイントといえます。無料プランでは生成画像がすべて自動公開され、他のユーザーが閲覧・コピー・リミックスできる仕様です。

対照的に、有料プラン(Apprentice、Artisan、Maestro)の「プライベートモード」をオンにすると、生成画像は完全に非公開となり、Leonardo AI自身も閲覧や広告目的での使用ができなくなります。企業の機密情報を扱う場合、プライベートモード設定が競合他社への情報漏洩防止に不可欠です。

ReAlice株式会社 AIコンサルタント

ReAlice株式会社 AIコンサルタント企業利用ではプライバシー設定とデータ管理の理解が欠かせません。特に無料プランでは生成画像が自動的に公開されるため、機密性の高い業務では必ず有料プランの「プライベートモード」を利用する必要があります。AWS環境での暗号化対応など一定の安全基準は満たしていますが、業界によっては追加の監査や認証確認が求められる点に注意が必要です。導入前に自社のセキュリティ要件との整合を必ず確認すべきです。

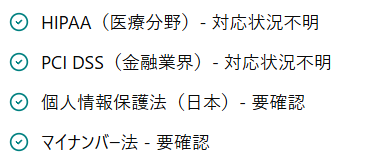

セキュリティ認証とコンプライアンス対応状況

企業が確認すべきセキュリティ体制

Leonardo AIは、AWSインフラストラクチャ上で運用され、データの暗号化や安全管理措置を実施しています。企業導入を検討する際は、SOC 2やISO 27001などの国際的なセキュリティ認証の有無を確認することが重要です。

SOC 2認証には2つのレベルがあり、Type Iは特定時点でのセキュリティコントロール設計の適切性を評価し、Type IIは3〜12ヶ月の期間にわたりコントロールが継続的に有効機能しているかを検証する、より厳格な認証です。企業の実務担当者がベンダーリスク評価を行う際、これらの認証の有無は長期契約の信頼性を判断する重要な要素となります。

データ保護とコンプライアンス対応

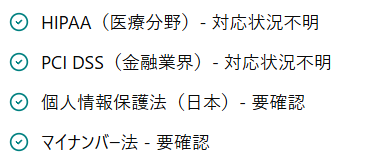

Leonardo AIはデータ保護方針を定めていますが、ISO 27001認証については公式発表が確認できていません。医療分野で必要とされるHIPAAや、金融業界のPCI DSSなど業界特有の認証も、現時点では対応状況が不明瞭です。

該当業界の企業は、自社のコンプライアンス要件に照らし、ベンダーのセキュリティ体制を慎重に検証する必要があります。

日本企業が重視すべき確認事項

日本の個人情報保護法やマイナンバー法との整合性確認は、導入の前提条件です。データの国外移転規定、第三者提供の制限、安全管理措置の内容を利用規約で確認し、自社のセキュリティポリシーと照合しましょう。

2024年7月のCanva買収後、Leonardo AIは独立して運営を継続する方針が示されています。情報システム部門は、定期的に最新のセキュリティ体制を確認し、ベンダーリスク評価の一環として必要な文書の提出を依頼することをお勧めします。

国際的なセキュリティ認証の取得状況を最優先で確認すべきです。特にSOC 2 Type IIやISO 27001の有無は、長期運用時の信頼性を測る重要な指標となります。現状では業界特有の認証対応が不明瞭なため、医療・金融分野では個別検証が不可欠です。また、日本企業は個人情報保護法との整合性や国外データ移転の扱いを十分に精査する必要があります。

データ保護とプライバシー管理の実態

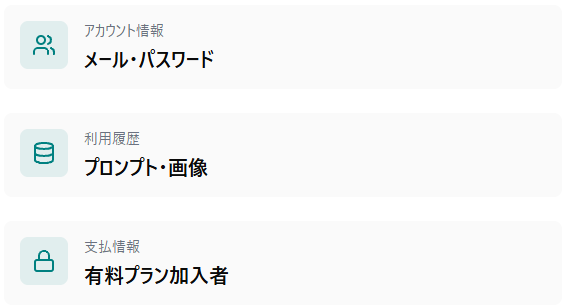

収集される個人情報と利用目的

アカウント作成時にメールアドレス、ユーザー名、パスワードが必須となり、有料プラン加入者は支払情報も提供します。加えて、画像生成時のプロンプト(テキスト指示)、生成画像データ、使用モデルやパラメータなどの利用履歴が記録されます。

これらのデータはサービス提供、機能改善、カスタマーサポート、不正利用検出に使われますが、無料プランの公開画像については、Leonardo AIが広告や製品改善に利用する権利を保持する点に注意が必要です。

企業が機密性の高い製品デザインを扱う場合、プライバシーポリシーの詳細を精査し、データの二次利用範囲を明確に把握しておきましょう。

生成コンテンツの権利と利用範囲

有料プランでプライベートモードを使用した場合、生成画像は他のユーザーにもLeonardo AI自身にも表示されず、広告や製品改善の目的で使用されません。一方、無料プランや公開設定では、Leonardo AIが画像とプロンプトを広告や製品改善に利用できます。

さらに他のユーザーも、公開画像を閲覧・コピー・リミックスできる仕様となっています。企業の機密情報を扱う場合、有料プラン契約とプライベートモード設定により、競合他社への情報流出を防ぐことが重要です。

プライベート生成機能の活用でリスクを回避

有料プラン限定のプライベートモード機能は、企業のビジネスリスクを大幅に軽減する鍵です。画像生成ページの左サイドバーで「Private Mode」トグルをオンにすると、生成画像は他のユーザーにもLeonardo AI自身にも表示されず、広告や改善目的での使用対象から除外されます。

実務上の注意点として、無料プランから有料プランにアップグレードした場合でも、アップグレード前に公開設定で生成した画像は公開状態のままです。機密性の高いプロジェクトでは、プロジェクト開始前に有料プラン契約とプライベートモード設定を完了させることを強くお勧めします。

無料プランでは生成データが広告や学習目的で再利用される点に注意が必要です。企業が機密情報や製品デザインを扱う場合は、必ず有料プランの「プライベートモード」を利用し、データの公開範囲を明確に制御すべきです。特にアップグレード前の生成物が自動的に非公開化されない仕様は見落としがちなリスクです。

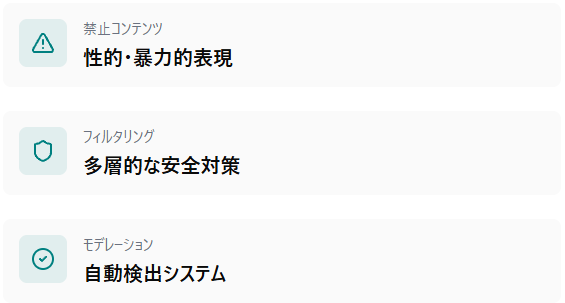

AI倫理と不適切コンテンツへの対策

禁止されているコンテンツと利用規約の詳細

利用規約では、露骨な性的コンテンツ、暴力的表現、差別や憎悪を助長する内容などの生成が明確に禁止されています。「エロティカ」「暴力」「子供」に関連するキーワードを2つ以上組み合わせた場合、コンテンツモデレーションフィルターが自動的に作動し、画像生成がブロックされます。

Leonardo APIを使用する場合も、NSFW(Not Safe For Work)コンテンツの生成はデフォルトでブロックされ、フラグが立てられたプロンプトは400エラー(Bad Request)を返します。社内ガイドラインには禁止コンテンツの具体例を明記し、従業員がコンプライアンス違反やブランドリスクを回避できる体制を整えましょう。

著作権侵害を防ぐための仕組み

Leonardo AIは、Stable Diffusionモデルを活用しながら独自のPhoenix基盤モデルも開発し、著作権に配慮した運用を行っていますが、生成画像が既存著作物に類似する可能性はゼロではありません。利用者自身が類似性チェックを行う責任があります。

2024年のCanva買収後、Canva Shieldと呼ばれる補償制度により、エンタープライズ顧客(100席以上)がMagic Studio製品で生成したコンテンツに起因する知的財産権侵害の申し立てに対し、追加費用なしで補償が提供されます。

この補償制度は、企業が安心してAI生成コンテンツを商用利用するための重要な安全装置です。

不適切表現に対するフィルタリング機能

入力プロンプトと出力画像の両方に多層的な安全対策を実装しています。入力段階では特定のキーワード組み合わせを自動検出し、不適切なコンテンツ生成の可能性がある場合にプロンプトをブロックします。

出力段階では機械学習技術で生成画像をスキャンし、稀に発生する不適切、安全でない、または有害なコンテンツをユーザーに表示する前に検出します。さらにユーザーが予期しない生成結果を報告できる仕組みも提供されています。

ただし、フィルタリング機能には限界があるため、最終的な品質チェックとブランドガイドライン適合性の確認は人間が行う体制を整えることが重要です。

暴力・性的・差別的な表現を自動検出して生成を制御する仕組みを備えています。ただし、完全な防止は難しいため、企業側でも社内ガイドラインを整備し、利用目的と表現範囲を明確にしておくことが重要です。著作権面ではCanva Shieldによる補償制度が整備されつつも、最終的な責任は利用者にあります。

技術面から見たセキュリティ対策

データ暗号化とアクセス制御の実装状況

Amazon Web Services(AWS)のグローバルインフラストラクチャを活用し、データの転送時および保管時の保護を確保しています。AWSの強固なセキュリティ基盤により、業界標準の暗号化技術が適用されます。

有料プランユーザーはプライベートモードで生成コンテンツへのアクセスを完全に制御できます。企業導入時には、二要素認証(2FA)の有効化、強固なパスワードポリシーの適用、最小権限の原則に基づくユーザー権限管理を併用すべきです。

クラウド基盤のセキュリティインフラ

Leonardo AIはAWS上で運用されており、AWS re:Invent 2023でも事例として紹介されました。推論処理にはAmazon EC2 Inf2インスタンス(AWS Inferentiaチップ搭載)を採用し、高いコストパフォーマンスを実現しています。

AWSのグローバルインフラストラクチャは回復力、セキュリティ、スケーラビリティを提供し、急激なユーザー増加にも効率的に対応できます。IT部門はAWSの共有責任モデルを理解し、クラウドプロバイダー側とユーザー側それぞれのセキュリティ責任範囲を明確にしましょう。

アカウント保護のために導入すべき対策

アカウントの乗っ取りや不正アクセスへの対策は不可欠です。推測されやすいパスワードを避け、大文字・小文字・数字・記号を組み合わせた複雑なパスワードを設定し、定期的に変更することが基本です。

第三者アプリやブラウザ拡張機能との連携を最小限に抑え、公式APIを使用する場合もAPIキーの厳格な管理とアクセスログの監視を実施しましょう。生成AI全般において、機密情報を入力することで外部流出するリスクが報告されています。

こうした教訓から、利用者への定期的なセキュリティ教育、アクセス権限の定期見直し、退職者アカウントの即座の無効化など、組織的な対策が情報漏洩リスクを大幅に低減します。

データ暗号化やアクセス制御を実装していますが、企業側にも適切な運用体制が求められます。特に二要素認証の導入、APIキーの厳格な管理、最小権限設計の徹底は必須です。クラウド環境では共有責任モデルを理解し、ベンダー任せにせず自社側でもセキュリティ監査を行うことが重要です。

Canva買収による安全性への影響

買収後のセキュリティ体制の変化

2024年7月のCanva買収により、セキュリティ体制の強化が期待されています。月間アクティブユーザー1億5千万人以上を抱えるCanvaは、エンタープライズグレードのデザインプラットフォームとして成長を続けています。

買収後もLeonardo AIは独立したプラットフォームとして運営されますが、Canvaの財務リソース、専門知識、ライセンスコンテンツのサポートを受けて加速的に成長します。重要なのは、Canvaユーザーのコンテンツは、ユーザーが明示的にオプトインを選択しない限りLeonardo AIと共有されないという原則が明示されている点です。

Canva AIセキュリティによる補償とは

2023年に導入されたCanva Shieldは、信頼性、安全性、プライバシーを保護するツールの集合体です。

その中核をなすのがエンタープライズ顧客向けのAI出力補償制度で、100席以上のエンタープライズプランを契約している企業は、Magic Studio製品で生成したコンテンツに起因する知的財産権侵害の申し立てに対し、追加費用なしで補償を受けられます。

Canvaはクリエイターへの投資として総額2億ドル以上を拠出し、ロイヤリティプログラムやコンテンツモデレーション、自動レビュー、報告システムなどのツールを提供しています。この投資規模は、Canvaの安全性とクリエイター支援への取り組みを示すものです。

今後の機能統合で期待される安全性向上

Leonardo AIのPhoenix基盤モデルをはじめとする先進技術が、既存のMagic Studioと統合されることで、より高品質なAI画像生成が可能になると期待されています。超高精細画像生成、動画生成、AIスケッチ、カスタムモデルトレーニングなどの機能が提供される見込みです。

120名の研究者・エンジニア・デザイナーチームがCanvaのR&D能力を強化し、長期的なイノベーション投資が加速します。企業ユーザーにとっては、2つのプラットフォームの長所を組み合わせた、より安全で高機能なAI画像生成環境が実現することが期待されます。

CanvaによるLeonardo AIの買収は、技術力とセキュリティの両面でプラスの影響をもたらすと考えられます。特に「Canva Shield」の導入により、企業利用時の知的財産リスクが大幅に軽減される点は注目に値します。両社の連携によって、AI生成の品質と安全性が同時に向上する基盤が整いつつあります。

他の画像生成AIとの安全性比較

Midjourney、Stable Diffusionとのセキュリティ比較

3つの主要な画像生成AIは、それぞれ異なるセキュリティアプローチを採用しています。

企業利用で選ばれる理由とリスク評価

無料プランから有料プランまでの柔軟な価格設定と、商用利用を明確に許可するライセンス条項が、企業に選ばれる主な理由です。すべてのプラン(無料・有料問わず)で商用利用が可能で、有料プランのプライベートモード使用時には生成画像が他のユーザーやLeonardo AI自身に使用されません。

Midjourneyはクラウドベースで設定不要な使いやすさを提供しますが、サブスクリプションコストが高ボリューム使用時に高額になる可能性があります。Stable Diffusionはオープンソースで無料ですが、ホスティングやGPU、クラウドインフラのコストが発生し、技術的専門知識が必要です。

ベンダーリスク評価では、初期コスト、運用コスト、技術的要求、セキュリティ要件、スケーラビリティを総合的に検討しましょう。

コストパフォーマンスと安全性のバランス

無料プランでも月に一定枚数の画像生成が可能で、有料プランでは大幅に生成枚数が増加し、プライベートモードや優先インフラなどのプレミアム機能が利用できます。各ツールの料金体系は変動するため、導入検討時には公式サイトで最新の価格を確認することが重要です。

Stable Diffusionはソフトウェア自体は無料ですが、Amazon EC2やAzureなどのクラウドインフラコスト、GPU利用料が別途発生します。

Leonardo AIの有料プランとプライベートモード機能は、比較的低コストでビジネス利用に適したプライバシー保護を実現し、中小企業にとっても導入しやすい選択肢です。総所有コスト(TCO)分析では、生成ボリューム、機密性要件、技術リソースを考慮しましょう。

Leonardo AIはプライベートモードにより、比較的低コストで堅実なデータ保護を実現しており、中小企業にも導入しやすい構成です。一方で、Midjourneyは利便性に優れるもののコスト上昇リスクがあり、Stable Diffusionは自由度が高い反面、運用管理の責任がユーザー側に重くのしかかります。

企業導入時のセキュリティチェックリスト

社内ポリシー策定で押さえるべき3つのポイント

どの部門・プロジェクトで使用を許可するか、商用利用の可否、生成コンテンツの用途制限(社内資料のみ、外部公開可など)を具体的に定義しましょう。

機密情報、個人情報、公開情報などのデータ分類に応じて、Leonardo AIへの入力可否を判断する基準を策定し、機密性の高い情報をプロンプトに含めないルールを徹底します。

有料プランの契約、プライベートモード設定の義務化、アカウント発行・削除のプロセス、定期的なアクセス権限レビューを含む運用手順を文書化し、全従業員に周知しましょう。

機密情報を扱う際の運用ルール

機密情報を含むビジュアルコンテンツを生成する場合、有料プランへの加入とプライベートモード設定が絶対条件です。プロンプトには顧客の個人情報、企業の営業秘密、未発表の製品情報など機密性の高いテキストを直接入力しないよう徹底しましょう。

代わりに一般的な表現や抽象化した指示を使用し、生成後の画像編集で具体的な情報を追加する手法を推奨します。生成された画像は企業の文書管理システムやセキュアなストレージに保存し、Leonardo AIのクラウド上に長期保存しない運用ルールを設けることが望ましいです。

機密プロジェクトに関わる従業員には個別のセキュリティ研修を実施し、情報漏洩リスクへの意識を高める取り組みが有効です。

継続的なリスク管理とアップデート対応

急速に進化するAI技術を基盤としているため、利用規約、プライバシーポリシー、セキュリティ機能が頻繁にアップデートされます。情報セキュリティ担当者は四半期ごとに最新の利用規約を確認し、自社のコンプライアンス要件との整合性を検証する体制を構築しましょう。

将来的なLeonardo AIとCanvaの統合を見据えて、新機能のセキュリティ影響評価を実施し、導入前にリスクアセスメントを行うプロセスを確立します。定期的なセキュリティ監査では実際の利用ログを分析し、ポリシー違反や異常なアクセスパターンを検出する仕組みを導入します。

AI技術の発展に伴う新たなリスク(ディープフェイク悪用、著作権侵害の増加など)に対応する体制を整備することが重要です。

特に機密情報の取り扱いに関しては、プロンプト入力段階でのリスク抑止とプライベートモードの徹底が鍵となります。利用規約やセキュリティ機能の更新頻度が高いため、定期的な監査と社員教育を組み合わせたPDCAサイクルの運用が効果的です。AI統合の進展を見据えたリスクアセスメント体制の構築が、企業の長期的な安全運用を支えます。

よくある質問|Leonardo AIの安全性について

Leonardo AIは無料プランでも商用利用できますか?

無料プランでの商用利用は可能ですが、重要な制限があります。無料プランで生成したコンテンツの知的財産権はLeonardo AIに帰属し、生成した画像はすべて自動的に公開されます。

公開された画像は他のユーザーも閲覧・コピー・リミックスできる状態となり、Leonardo AIも広告や製品改善に利用できます。そのため、無料プランでの商用利用は個人利用や学習目的にとどめ、本格的な商用展開には有料プランの利用が推奨されます。

有料プランに加入し、プライベートモードで生成すれば、知的財産権がユーザーに帰属し、他のユーザーやLeonardo AIに使用されることはありません。

生成した画像が勝手に公開されることはありませんか?

有料プランでプライベートモードを有効にすれば、生成した画像が勝手に公開されることはありません。

プライベートモードをオンにすると、画像は他のユーザーにもLeonardo AI自身にも表示されず、広告や製品改善目的での使用対象から除外されます。無料プランまたは有料プランでプライベートモードを無効にした場合、生成画像は公開ギャラリーに自動的に投稿され、他のユーザーが閲覧・コピー・リミックスできる状態になります。

機密性の高いコンテンツを扱う場合、画像生成前にプライベートモード設定を確認する習慣を徹底することが重要です。

セキュリティ認証について教えてください

企業がAI画像生成ツールを導入する際は、SOC 2やISO 27001などのセキュリティ認証の有無を確認することが重要です。これらの認証は、データ管理プロセスが業界標準に準拠していることを示す指標となります。

導入検討時には、営業担当者に最新のセキュリティ認証状況やコンプライアンス文書の提供を依頼し、自社の要件と照合することをお勧めします。

データの管理プロセスが業界標準に準拠し、第三者による客観的な検証を受けていることを意味します。

データの暗号化や保管場所について教えてください

Amazon Web Services(AWS)のグローバルインフラストラクチャを使用してデータを処理・保管しています。

AWSは業界標準の暗号化技術を提供し、データの転送時(TLS/SSL)および保管時(AES-256など)の暗号化を実装しています。具体的なデータセンターの所在地については、AWSの複数リージョンを活用していますが、詳細な保管場所は企業顧客向けのセキュリティ文書で個別に開示される可能性があります。

日本企業が個人情報保護法の観点からデータの国外移転に懸念がある場合は、データ処理契約(DPA)の締結や、具体的なデータ保管場所の確認を営業担当者に依頼することが推奨されます。

企業で導入する際に最も注意すべきリスクは何ですか?

最も注意すべきリスクは、無料プランまたはプライベートモード無効時の意図しない情報公開です。

従業員が機密性の高い製品デザインやマーケティング素材を無料プランで生成した場合、その画像とプロンプトは自動的に公開され、競合他社を含む誰でもアクセス可能になります。次に重要なのが著作権侵害のリスクで、AI生成画像が既存の著作物に類似する可能性があるため、商用利用前に人間による確認と、必要に応じて法務部門のレビューが不可欠です。

プロンプトに個人情報や営業秘密を含めることによるデータ漏洩リスクも看過できません。有料プラン契約とプライベートモード設定の義務化、機密情報の入力禁止、生成コンテンツの品質・法的チェック体制の整備により、これらのリスクを回避しましょう。