Sora利用で訴訟リスク?企業が知るべき5つの危険性と今すぐできる対策

「Soraで簡単に動画が作れるなら、すぐに導入したい」そう考えている企業担当者の方へ。確かにOpenAIの動画生成AI「Sora」は、テキストから高品質な動画を簡単に生成できる画期的なツールです。しかし、その便利さの裏には、著作権侵害、機密情報の漏洩、ディープフェイク詐欺といった深刻な危険性が潜んでいることをご存知でしょうか。

実際に、サムスン電子では生成AI利用開始からわずか20日間で3件の機密情報流出が発生し、中国の裁判所ではAI生成画像に対して約20万円の損害賠償判決が下されています。Soraのビジネス活用における危険性を理解せずに導入すれば、あなたの会社も同じリスクに直面する可能性があります。

本記事ではSoraの危険性を5つの観点で徹底分析し、企業が安全にビジネス活用するための実務対策を具体的に解説します。

- Soraのビジネス活用で企業が直面する5つの深刻なリスク

- 情報漏洩を防ぐオプトアウト設定の具体的な手順

- 業界別のビジネスインパクトと安全対策

- 2025年以降のAI法規制動向と企業が今すぐ備えるべきこと

- 導入前・運用中・トラブル発生時の実践的チェックリスト

Soraとは?ビジネスで注目される動画生成AIの基本

テキストから動画を生成する革新的な技術

Soraは、OpenAIが開発した動画生成AIモデルで、テキストプロンプトを入力するだけで最大15~25秒のリアルな動画を自動生成します。最大の特徴は、重力や慣性といった物理法則を正確にシミュレートできる高度な表現力です。

バスケットボールが床に跳ね返る動きや、激しいカメラワークといった複雑な動作も自然に表現できるため、従来の動画制作では数日かかっていた作業が数分で完了します。

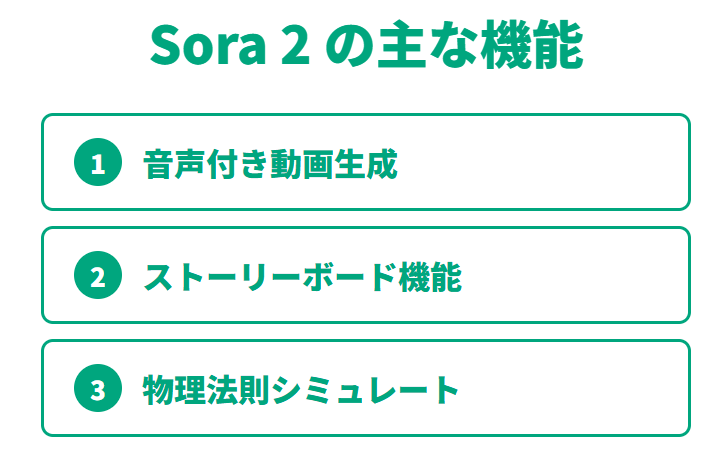

2025年9月30日リリースのSora 2の主な機能

Sora 2では、物理法則に忠実な動画表現に加えて、音声付き動画の生成が可能になりました。2025年10月16日のアップデートでは、ストーリーボード機能が追加され、複数のシーンを連続した動画として生成できるようになっています。

料金プランは無料プラン、Plus(月額20ドル)、Pro(月額200ドル)の3種類が用意され、企業の予算に応じた選択が可能です。株式会社ピアラは2025年10月、Sora 2を自社の生成AIプラットフォーム「ナレシェアAI」に実装し、撮影不要で新しい世界観を創り出すAI動画制作を実現しました。

ReAlice株式会社 AIコンサルタント

ReAlice株式会社 AIコンサルタントSoraは、テキストからダイナミックな動画を直接生成できる点で生成AIの中でも飛躍的な進化を遂げたモデルです。

特に物理挙動の再現性の高さとシーン連結機能の追加は、映像制作やシミュレーション領域での活用を現実的なものにしています。

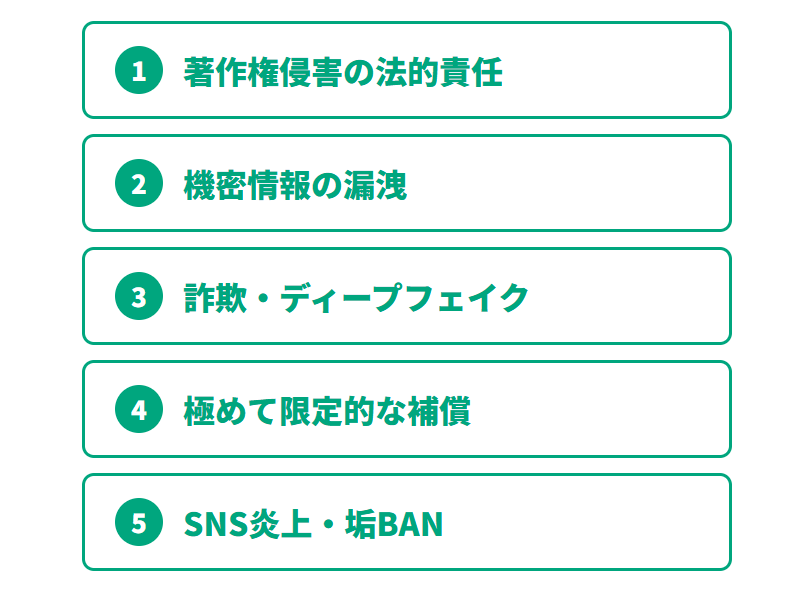

Soraの危険性|企業が直面する5つの深刻なリスク

ビジネスでSoraを活用する前に、企業が理解すべき5つの重大なリスクがあります。これらのリスクを軽視すると、法的責任や信用失墜といった深刻な事態を招く可能性があります。

著作権侵害による法的責任のリスク

学習データに含まれる日本IPの無断利用問題

OpenAIのSoraは、学習データに日本の知的財産(IP)を無断で使用している疑いが指摘されています。2024年2月、中国の広州インターネット裁判所は、AI企業が「ウルトラマン」に酷似した画像を生成したことに対して著作権侵害を認定し、約20万円の損害賠償と、類似画像の生成防止措置を命じる判決を下しました。

この判例は、AI生成物が既存の著作物の独創的表現を複製した場合、明確に著作権侵害として扱われることを示しています。企業は、生成された動画が日本の人気キャラクターや映像作品に類似していないか、慎重に確認する体制を整えるべきです。

生成物の責任は企業に帰属する現実

Soraで生成した動画が著作権侵害に該当した場合、OpenAIではなく利用者である企業が法的責任を負います。権利者からは、差止請求(動画の削除要求)、損害賠償請求(本来得られたはずのライセンス料相当額の支払い)、名誉回復措置(謝罪広告の掲載)を求められる可能性があります。

日本の民法第709条に基づく不法行為責任として、生成AIの利用・販売によって得た金銭相当額について賠償義務が生じると法務専門家は指摘しています。

機密情報の漏洩リスク

デフォルト設定でプロンプトがAI学習に利用される

Soraを含むOpenAIのサービスは、デフォルト設定では入力したプロンプトがAIの学習データとして利用される仕組みになっています。企業が新製品のアイデア、顧客情報、財務データなどを含むプロンプトを入力すると、それらの機密情報が他社の生成結果に反映される危険性があります。

オプトアウト設定を行わない限り、この情報流出のリスクは常に存在し続けるため、早急な対策が求められます。

サムスン電子の情報流出事例から学ぶ教訓

2023年4月、Samsung Electronics(サムスン電子)のDS(Device Solution)部門でChatGPTの社内利用を許可したところ、わずか約20日間で少なくとも3件の機密情報流出事案が発生しました。

- バグがある半導体データベースのソースコードをコピーして修正を依頼

- 機密コードをコピーして欠陥機器の修正プログラムを依頼

- 社内会議の録音データを文書化してChatGPTに入力し議事録を作成

従業員が業務効率化を優先するあまり、機密情報の重要性を軽視してしまった典型例と言えます。Soraにおいても同様の事態が起こり得るため、企業は社内ガイドラインの整備と従業員教育を徹底すべきです。

ディープフェイクによる詐欺・信用毀損のリスク

経営層を装った詐欺被害の可能性

Sora 2の高精度な動画生成能力により、経営層や取引先の人物を装った詐欺動画が作成されるリスクが高まっています。実際の人物の声や動きを模倣した動画を使って、虚偽の指示や契約変更を従業員に伝える手法が考えられます。

OpenAIは2025年10月、俳優組合SAG-AFTRAからの要請を受けて、Sora 2にディープフェイク対策機能を追加しましたが、完全な防止は困難な状況です。企業は、重要な指示や契約変更については、動画だけでなく電話や対面での確認を必須とするルールを設けることが重要です。

ブランドイメージを損なうフェイク動画の拡散

企業のロゴや製品を使った虚偽の動画がSNSで拡散されると、ブランドイメージの毀損や株価への悪影響が発生する可能性があります。防犯カメラ映像や証拠動画の信憑性も低下するため、訴訟や紛争解決の場面でも新たな課題が生じています。

自社のブランド名でどのような動画が生成されているかを定期的に監視する体制を構築し、フェイク動画を早期に発見・対処することが求められます。

利用規約に潜む落とし穴

損害賠償上限100ドルという衝撃の事実

Soraの利用規約では、無料ユーザーに対する損害賠償の上限がわずか100ドル(約1万5,000円)に設定されています。データ漏洩や誤動作によって企業に数百万円以上の損害が発生したとしても、OpenAIからの補償は100ドルで打ち切られる仕組みです。

米国IT企業に典型的な「防御的条項」ですが、ユーザー保護が極めて弱い点は企業として認識すべき重大なリスクと言えます。

裁判不可・強制仲裁条項のリスク

Soraの利用規約には、集団訴訟や陪審裁判の権利を放棄させる条項が含まれています。企業が重大な被害を受けた場合でも、通常の裁判手続きを利用できず、強制仲裁によって解決を図らなければなりません。

サービスは「現状有姿(as is)」で提供され、無保証であることも明記されており、実質的に「自己責任」を強制する構造です。Soraの利用によって生じ得る損害に対する保険加入を検討するなど、リスクヘッジの対策が不可欠です。

SNS投稿によるアカウント凍結と炎上リスク

Soraで生成した動画をSNSに投稿する際、AI生成物であることを明示しないと、プラットフォームの利用規約違反によってアカウントが凍結される可能性があります。YouTubeやX(旧Twitter)は既に、AI生成コンテンツの表示義務化を導入し始めています。

企業の公式アカウントが凍結されると、顧客とのコミュニケーション手段を失うだけでなく、ブランド信頼性の低下にもつながるため、慎重な対応が求められます。

Soraのビジネス利用は革新性と同時に重大なリスクを伴います。

生成物の法的責任や機密情報の漏洩リスクは、利用企業側が全面的に負うことを前提にすべきです。

Soraで情報漏洩を防ぐ|オプトアウト設定の実践手順

上記のリスクの中でも特に深刻なのが機密情報の漏洩です。ここからは、企業がまず実施すべきオプトアウト設定の具体的な手順を解説します。

オプトアウトとは?企業にとって必須の設定

オプトアウト設定とは、入力したプロンプトや生成した動画データをOpenAIのAI学習に使用させない設定です。この設定により、企業の機密情報が他のユーザーへの回答出力に使われなくなり、情報漏洩リスクが大幅に低減されます。

注意すべき点は、チャット画面からの簡易設定はChatGPTには適用されますがSoraには適用されないため、プライバシーセンターからの申請を行う必要があることです。

PC・Webブラウザ版での設定方法

Webブラウザ版でオプトアウト設定を行う手順を説明します。

画面右上の「⋯」(三点リーダー)をクリックし、「Settings」を選択してください。

「Account」画面で左上の「<」をタップして前の画面に戻り、「Data controls」をタップします。

「すべての人のためにモデルを改善する(Improve the model for everyone)」の項目を見つけ、初期設定では「ON」になっているスイッチを「OFF」に切り替えることで、入力情報がAIに学習・記録されなくなります。

スマホアプリ版での設定方法

スマホアプリ版では、アカウント画面の右上にある設定アイコン(歯車マーク)をタップします。その後の手順はWebブラウザ版と同様で、「Data controls」から学習利用のスイッチをOFFにすれば設定完了です。

複数の従業員がSoraを利用する企業では、全員のアカウントで必ずこの設定を実施するよう、社内ガイドラインで義務化することが重要です。

プライバシーセンターからの申請方法

Soraに対して確実にオプトアウトを適用するには、OpenAIのプライバシーセンターから正式な申請を行う必要があります。プライバシーセンターでは、アカウント削除やデータ削除の手続きも可能です。

法務部門やコンプライアンス担当者は、この申請プロセスを標準化し、新規ユーザーの登録時に必ず実施するフローを構築すべきです。

機密情報保護の観点から、オプトアウト設定はAIツール導入時の必須ステップです。

特にSoraはチャット設定では反映されないため、プライバシーセンター経由での明示的な申請が不可欠です。

業界別に見るSoraのビジネスインパクト

オプトアウト設定などの基本的な対策を理解した上で、次は各業界でSoraがどのような影響をもたらすかを見ていきましょう。

業界ごとに機会とリスクが大きく異なるため、自社の業界特性を踏まえた戦略が必要です。

広告・マーケティング業界|制作コスト削減と著作権リスクの両立

広告・マーケティング業界では、Soraを活用することで動画制作コストを最大70~95%削減できる可能性があります。株式会社ピアラは、Sora 2を自社プラットフォーム「ナレシェアAI」に実装し、既存商品の素材をもとに撮影不要で新しい世界観を創り出す「撮らない動画制作」を実現しました。

クリエイティブ制作のスピード・コスト・表現力が大幅に向上する一方で、広告業界では著作権侵害のリスクも最も高くなります。生成した動画が既存のCMや映像作品に類似していないか、法務チームによる厳格なレビュー体制の構築が不可欠です。

映像制作・エンタメ業界|クリエイター雇用への影響

映像制作業界では、Soraによって背景生成やアイデアの可視化が高速化される一方、従来のクリエイター雇用が減少するリスクが指摘されています。外注に依存していた制作プロセスが内製化されることで、業界全体の構造変化が進む可能性があります。

AIコンサルタントの視点では、Soraを「補助ツール」として位置づけ、人間ならではの創造性や感情表現に注力することで、クリエイターの価値を維持できると考えます。完全にAIに置き換わるのではなく、AIとの協働によって新たな表現の可能性を追求する姿勢が重要です。

金融・コンサルティング業界|機密保持が最重要課題

金融・コンサルティング業界では、プレゼン資料の視覚化や顧客説明の効率化にSoraを活用できる反面、機密情報漏洩のリスクが最も深刻です。前述のサムスン電子の事例が示すように、従業員が便利さを優先して顧客データや財務情報を含むプロンプトを入力してしまう危険性があります。

この業界では、オプトアウト設定の徹底に加えて、オフライン環境でのAI利用や、クローズドなオンプレミス型AIの検討が求められます。

製造・小売業界|商品PR動画の内製化チャンス

製造・小売業界では、商品PR動画を低コストで内製化できるチャンスが広がっています。Eコマース分野では、商品の平置き写真1枚と「20代女性がこのTシャツを着て、カフェで楽しそうに話している」というプロンプトを入力するだけで、バーチャルモデルが商品を着用した動画を自動生成できます。

顧客はサイズ感や使用シーンをリアルにイメージでき、購入率の向上が見込めます。ただし、消費者欺瞞を避けるため、AI生成動画であることを明示し、将来的な法規制強化にも対応できる品質管理基準の設定が重要です。

Soraの進化は業界ごとに異なるインパクトをもたらします。マーケや小売では低コストで高品質な表現が可能になる一方、法的リスクや誤用リスクが浮上します。

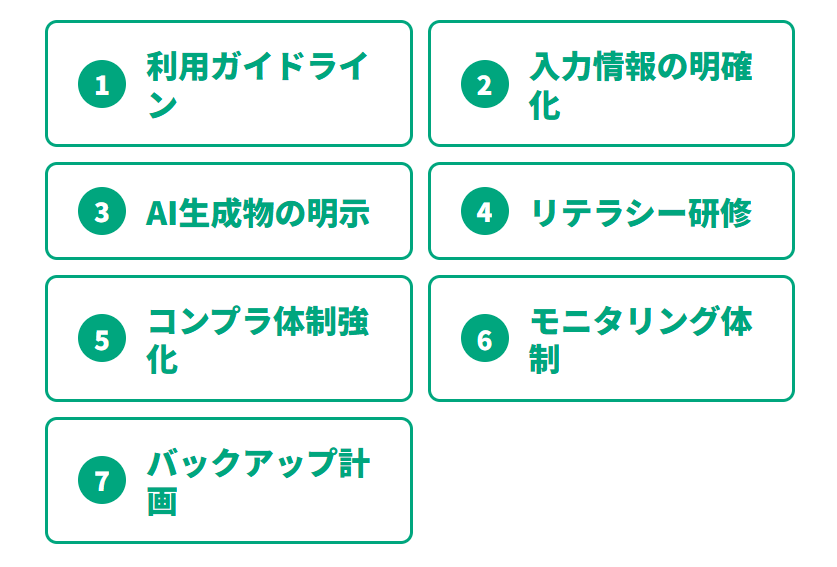

Soraを導入する企業向け7つの安全対策

業界ごとの影響を理解した上で、ここからは企業がSoraを安全に導入・運用するための7つの具体的な対策を紹介します。

社内利用ガイドラインの策定

企業がSoraを安全に活用するための第一歩は、明確な社内利用ガイドラインの策定です。

- 入力禁止情報の明確化(機密情報、個人情報、取引先情報)

- 承認フローの設定(法務・広報レビューの必須化)

- 違反時のペナルティ規定

- 具体的な利用シーンごとの「OK例」と「NG例」

従業員が迷わず判断できるよう、具体的な利用シーンごとに「OK例」と「NG例」を示すことが効果的です。

入力禁止情報の明確化と周知徹底

新製品の開発計画、顧客リスト、財務諸表、契約書の内容、社内会議の録音など、具体的にどのような情報をSoraに入力してはいけないかを明文化し、全社員に周知徹底する必要があります。定期的な研修や、入力前のチェックリストの活用が有効です。

単にルールを設定するだけでなく、なぜその情報が機密なのか、漏洩した場合にどのような被害が想定されるかを具体的に説明することで、従業員の理解と協力を得やすくなります。

AI生成物の明示ルールの設定

YouTubeなどのSNSプラットフォームは、AI生成コンテンツの表示義務化を開始しています。

Soraで生成した動画を公開する際に、ウォーターマークの付与や「AI生成コンテンツ」という表記を義務化する社内ルールを設定すべきです。透明性を確保することで、消費者の信頼を獲得し、将来的な法規制にも先行して対応できます。

従業員向けAIリテラシー研修の実施

Soraの危険性を理解し、適切に活用できる人材を育成するため、定期的なAIリテラシー研修が必要です。

- 著作権法の基礎知識

- ディープフェイク詐欺の見分け方

- オプトアウト設定の実践演習

- 実例を通じた機密情報入力リスクの理解

便利さだけに注目して機密情報を入力してしまうリスクを、実例を通じて学ばせることが重要です。

法務・コンプライアンス体制の強化

Soraで生成した動画が著作権侵害に該当しないか、法務チームによる事前レビュー体制を構築すべきです。

前述の中国裁判所によるウルトラマン類似画像の判例のように、AI生成物でも明確に著作権侵害として扱われる時代です。顧問弁護士との定期協議や、AI生成物専門のレビューチーム設置が推奨されます。

モニタリング体制の構築

自社のブランド名や製品名を使ってどのような動画がSoraで生成されているかを監視する体制を構築してください。

ディープフェイク検知ツールの導入や、SNSでの自社関連動画の定期パトロールが有効です。フェイク動画が拡散された場合に備えて、迅速な削除要請や法的対応を行うための手順書を事前に準備しておくべきです。

代替手段とバックアップ計画の確保

Soraの利用規約では、損害賠償上限が100ドルに設定されており、企業にとって十分な補償が得られない構造です。

重要な動画制作プロジェクトでは、Soraに全面依存するのではなく、従来の制作手法やオンプレミス型AIといった代替手段を確保しておくことが賢明です。クローズド環境でのAI運用設計や、データ流出に対する保険適用範囲の見直しも検討してください。

社内ルールや教育研修といった“非技術的セキュリティ”の整備は、技術対策と同等以上に重要な防御策です。また外部プラットフォームへの依存リスクを見越し、バックアップ手段の確保も長期運用における要です。

2025年以降のAI法規制動向|企業が備えるべきこと

Soraをはじめとする生成AIに対する法規制は、世界各国で急速に整備が進んでいます。企業は今後の法改正を見据えた準備が不可欠です。

日本のAI推進法と透明性確保の義務化

日本では2025年、AI推進法が成立し、AI開発・利用における「推進の司令塔」機能と「透明性確保」が法定化されました。この法律により、企業はAI生成コンテンツに対して明示的な識別子の付与を義務付けられる方向にあります。

テキスト、画像、音声、動画のすべてにおいて、ユーザーが認識できる「提示ロゴ」や「注意書き」の表示が必須となる見込みです。企業は、技術的な実装準備と社内ルールの整備を同時に進める必要があります。

EU AI Actのリスク分類と日本企業への影響

EUでは、AI Actによって「リスク4段階」分類が導入され、生成AIには透明性義務が課されています。ハイリスクAIシステムに該当する場合、システム要件への適合確保や表示義務が発生します。

日本企業がEU市場で動画コンテンツを展開する場合、AI Actの規制対象となる可能性があるため、欧州での事業展開を検討している企業は早期に法務体制を整備すべきです。

AI生成物の表示義務化の流れ

中国では既に、生成合成コンテンツに対して「明示的」および「非明示的」な識別子の付与が義務化されています。強制的なラベル表示に加えて、ユーザーには見えないメタデータや不可視の透かし(電子透かし)をファイルに埋め込むことも求められています。

日本でも同様の規制が導入される可能性が高く、技術的な対応準備を今から進めておくことが重要です。

今後2〜3年で予想される規制強化

AIコンサルタントの視点では、今後2〜3年で著作権法の改正、データガバナンス規制の国内導入、業界自主規制の策定が加速すると予測されます。

先行的に社内体制を整備し、AI生成物の透明性確保や機密情報保護のルールを確立している企業は、規制強化後も競争優位性を維持できます。逆に、現時点で何も対策を講じていない企業は、法改正時に大幅なビジネスモデルの変更を迫られるリスクがあります。

識別表示や透かし埋め込みなどの要件は、単なる表記義務ではなく実装設計やUIにも影響する仕様要素と捉えるべきです。海外展開を視野に入れる企業はEU AI Actへの先行準拠を進めることで、事後対応コストを削減できます。

Soraを安全にビジネス活用する為のチェックリスト

これまでに解説したリスクと対策を踏まえ、企業がSoraを安全に運用するための実践的なチェックリストを紹介します。

導入前に確認すべき5つのポイント

Soraを企業に導入する前に確認すべきポイントは以下の通りです。

- オプトアウト設定の実施方法を全従業員が理解しているか

- 入力禁止情報を明文化した社内ガイドラインが存在するか

- 法務チームによる著作権レビュー体制が構築されているか

- AI生成動画の明示ルール(ウォーターマークや注意書き)が設定されているか

- 利用規約の損害賠償上限100ドルというリスクを経営層が承認しているか

これらの確認を怠ると、情報流出や著作権侵害といった深刻な問題が発生する可能性があります。

運用中に定期チェックすべき項目

Soraの運用開始後は、定期的なチェックが欠かせません。

- 全従業員のオプトアウト設定が正しく維持されているか(定期監査)

- 社内で生成された動画が著作権侵害に該当しないか(法務レビュー)

- 自社ブランド名を使った不正な動画がSNSで拡散されていないか(モニタリング)

- AI生成動画の明示ルールが遵守されているか(品質管理)

- 最新の法規制動向に対応できているか(コンプライアンスチェック)

運用開始後わずか20日間で機密情報流出が発生したケースもあるため、初期段階の厳格な監視が求められます。

トラブル発生時の対応フロー

Soraに関連するトラブルが発生した場合の対応フローを事前に策定しておくことで、被害を最小限に抑えられます。

直ちにOpenAIのプライバシーセンターからデータ削除申請を行い、影響範囲を特定してください。

動画の公開を即座に停止し、法務チームと顧問弁護士に相談します。

SNSプラットフォームに削除要請を行い、必要に応じて法的措置を検討してください。

迅速な対応が被害拡大を防ぐ鍵となります。

トラブル対応フローも現実的で、リスク発生後の対応速度が結果を左右することを強調しています。Soraのような生成AIツールは、導入よりも運用の継続的な見直しが鍵となるため、このチェックリストをベースに監査や教育の仕組みと連携させるとさらに実効性が高まるでしょう。

よくある質問|Soraの危険性とビジネス活用

Soraで生成した動画を商用利用して問題ないですか?

Soraで生成した動画の商用利用は、OpenAIの利用規約上は許可されていますが、著作権侵害のリスクには十分な注意が必要です。生成された動画が既存の著作物に類似している場合、利用者である企業が法的責任を負います。

中国の裁判所は、ウルトラマンに似た画像を生成したAI企業に対して約20万円の損害賠償を命じており、日本でも同様の判例が出る可能性があります。商用利用前には、必ず法務チームによる著作権チェックを実施してください。

オプトアウト設定をしないとどうなりますか?

オプトアウト設定を行わないと、入力したプロンプトや生成した動画データがOpenAIのAI学習に利用され、他のユーザーの生成結果に企業の機密情報が反映されるリスクがあります。前述のサムスン電子の事例では、オプトアウト設定を行わずにChatGPTを利用した結果、約20日間で3件の機密情報流出事案が発生しました。

新製品の開発計画や顧客情報といった重要なデータが競合他社に漏洩する可能性があるため、オプトアウト設定は必須です。

Soraで著作権侵害が起きた場合、誰が責任を負いますか?

Soraで生成した動画が著作権侵害に該当した場合、OpenAIではなく利用者である企業が法的責任を負います。日本の民法第709条に基づく不法行為責任として、権利者から差止請求、損害賠償請求、名誉回復措置を求められる可能性があります。

損害賠償額は、生成AIの利用・販売によって得た金銭相当額が基準となります。Soraの利用規約では、OpenAIからの損害賠償は最大100ドルに制限されており、企業は自己責任で対処しなければなりません。

社内の機密情報を含むプロンプトを使ってしまいました。どうすればいいですか?

機密情報を誤ってSoraに入力してしまった場合は、直ちにOpenAIのプライバシーセンターからデータ削除申請を行ってください。削除申請後も、既に学習データに組み込まれた情報を完全に除去できる保証はないため、影響範囲の特定と、関連部署への報告が必要です。

早期発見により被害を最小限に抑えることができるため、迅速な対応が重要です。今後同様の事態を防ぐため、オプトアウト設定の徹底と従業員教育の強化に取り組んでください。

Soraで生成した動画をSNSに投稿する際の注意点は?

Soraで生成した動画をSNSに投稿する際は、必ずAI生成コンテンツであることを明示してください。YouTubeは既に、AI生成物の表示義務化を導入しており、明示を怠るとアカウント凍結のリスクがあります。

日本のAI推進法では、今後「提示ロゴ」や「注意書き」の表示が義務化される見込みです。また、企業の公式アカウントで投稿する場合は、動画内容が著作権侵害やブランド毀損に該当しないか、事前に法務チームのレビューを受けることを推奨します。