Zoom AI Companion導入前に必ず確認|情報漏洩を防ぐセキュリティ設定とリスク対策

Zoom AI Companionの導入を検討しているものの、「会議内容が外部に漏れるのでは?」「情報漏洩リスクは大丈夫?」と不安を感じていませんか。AI機能が便利な一方で、Zoom AI Companionのセキュリティや安全性について疑問を持つビジネスパーソンは少なくありません。特に、「ホスト以外にバレるのか」「データが学習に使われるのか」といったデメリットやリスクへの懸念は、企業の導入判断を左右する重要なポイントです。

本記事では、Zoom AI Companionのセキュリティ機能を徹底解説し、情報漏洩リスクへの具体的な対策から、医療業界でのBAA対応と現在の機能制限事項、他社AIツールとの比較まで、企業導入時に押さえるべきすべてのポイントをカバーしています。OpenAI等サードパーティとのデータ取扱い、DRオプションの活用と機能制限の理解、東京大学の利用事例など、実践的な情報を交えながら、安全にZoom AI Companionを使いこなす方法をお伝えします。

Zoom AIコンパニオンの使い方やホスト以外の権限設定についても詳しく解説しているので、導入前の不安を解消し、自社に最適な運用方法を見つけてください。

- Zoom AI Companionの情報漏洩リスクと企業が実施すべき具体的なセキュリティ対策

- 会議データがAI学習に使われないZoomの方針とデータ保護の仕組み

- ホスト以外の参加者への通知機能と「バレる」ケースの詳細

- 医療業界でのBAA対応と現在の機能制限事項

- 安全にZoom AI Companionを導入するための5つのステップと運用ルール

Zoom AI Companionとは?ビジネスでの役割

Zoom AI Companionは、会議の議事録作成・要約・質疑応答を自動化するAIアシスタント機能です。2023年9月の提供開始以降、2025年11月には「AI Companion 3.0」へと進化を遂げました。

有料プラン(Pro・Business・Enterprise)の契約者なら追加料金なしで利用でき、会議の生産性向上を実現しています。文字起こしだけでなく、会議中の質問への即答や過去の会議内容検索など、ビジネスコミュニケーション全体を支援する機能として注目されています。

会議の生産性を高めるAI機能の全体像

AI Companionの主要機能は、会議中のリアルタイム文字起こし、終了後の自動要約、会議内容に関する質問への即答の3つです。

Zoomが採用するフェデレーテッドアプローチでは、自社AIモデルとOpenAI・Anthropicなどの外部モデルを動的に組み合わせ、状況に応じて最適な処理を実現しています。「この会議で決まった予算は?」といった質問をAIに投げかければ、会議中でも即座に回答が得られます。

デスクトップアプリ右上のダイヤモンド形アイコンをクリックするだけで、サイドパネルからAI機能にアクセス可能です。

2025年最新版|AI Companion 3.0で追加された新機能

2025年9月発表のAI Companion 3.0では、エージェント型AIが搭載され、定型業務の自動実行が可能になりました。

ミーティングと通話の文字起こし、チャット履歴、共有ドキュメントといった社内ナレッジと、公開されている市場調査や業界データなどの社外インサイトを統合し、コンテキストアウェア検索を通じて必要な情報を適切なタイミングで提供します。

新しいAIノートテイカー機能により、Zoom Workplaceアカウントユーザーは全Zoomミーティングで手書きノートを最適化でき、対面ミーティングやMicrosoft Teams・Google Meet・WebExといったZoom以外のプラットフォームでも利用可能です。2025年10月にはNVIDIAとの協業も発表され、企業向けカスタムAI開発がさらに加速しています。

ReAlice株式会社 AIコンサルタント

ReAlice株式会社 AIコンサルタント会議データを中核に業務全体の知識活用を最適化するAIプラットフォームへ進化しています。外部モデルとの連携やエージェント機能の追加により、単なる要約ツールから「情報理解と実行支援」を担う存在に拡張されました。

Zoom AI Companionの安全性|データは学習に使われない?

AI Companion導入時、企業が最も懸念するのは「会議データがAI学習に使われるのでは?」という点でしょう。Zoomはこの懸念に対し、顧客の音声・動画・チャット・画面共有・添付ファイルなどを、Zoom自社またはOpenAI・Anthropicなどの第三者AIモデルの学習に一切使用しないと公式に明言しています。

この方針は利用規約に明記され、法的拘束力を持ちます。2023年8月には利用規約の文言が誤解を招き、「Zoomがユーザーの同意なしにAIトレーニングにデータを使用する」との批判が起きましたが、Zoomは即座に規約を修正し、顧客データの不使用を明確化しました。

顧客データをAI学習に使用しないZoomの方針

Zoomは「顧客データは顧客のもの」という原則を貫いています。AI Companion機能使用時、データは処理のため一時的にZoomホストモデルまたは第三者モデルに送信されますが、その目的は「ユーザーへのサービス提供」のみに限定されています。

たとえば、チャット作成支援機能では、選択したチャットスレッド・参加者名・ユーザーのプロンプトが関連モデルに送信されますが、これらはモデル学習に使用されません。Zoomは「顧客データは顧客のもの」という原則を貫き、厳格なアクセス管理体制を構築しています。

データ暗号化と保管期間の仕組み

AI Companionが生成した要約や文字起こしデータは、転送中と保管中の両方で暗号化処理が施されます。デフォルトのデータ保持期間は最大30日間です。

厳格なコンプライアンス要件を持つ組織向けには「Zero Data Retention(ZDR)」オプションが用意されており、これを有効化するとAI応答生成直後にZoomサーバーからデータが削除されます。Zoomクラウドに保存されるコンテンツの暗号鍵を顧客自身が管理できる「Customer Managed Key(CMK)」機能も利用可能で、AI Companion 1.0では対応済みです。

フェデレーテッドAIアプローチによる安全性の確保

Zoomが採用する「フェデレーテッドAI(連合型AI)」アプローチは、自社AIモデルと第三者AIモデルを動的に組み合わせることで、高品質な結果と可用性を両立させています。使用する機能やシステム状況に応じて、パフォーマンスと可用性に基づいてモデルが自動選択される仕組みです。

セキュリティ面では、Zoomホストモデルが、OWASP(Open Worldwide Application Security Project)のLLM Top 10やその他の安全なAIフレームワークに準拠した脆弱性評価を受けています。第三者サブプロセッサーは、Zoomの第三者リスク管理プログラムの一環として、少なくとも年1回のセキュリティ評価を受け、独立監査法人による検証も実施されます。

Zoom Trust Centerでは、各種セキュリティ認証(ISO 27001・SOC 2など)を確認できます。

顧客データをAI学習に利用しないという透明性と技術的安全性の両立を徹底している点が特筆されます。フェデレーテッドAI構成やZDR・CMKといった高度なデータ保護機能により、企業のセキュリティ要件に柔軟に対応可能です。

情報漏洩リスクへの具体的な対策

AI Companion導入で企業が最も警戒すべきは情報漏洩リスクです。会議データが第三者AIモデルに送信される仕組み上、適切な設定なしでは機密情報が外部に流出する可能性があります。医療・法律・金融サービス企業では、クラウド処理がコンプライアンス上の問題を引き起こす可能性があるため、組織のポリシーに応じた適切な対策が必要です。

情報漏洩リスクを最小化するには、データ送信先の把握、保持期間の設定、暗号鍵管理という3つの対策を確実に実施しましょう。外部の生成AIを活用する以上、セキュリティ面での特別な注意が不可欠です。

サードパーティモデルへのデータ送信の実態

AI Companionは機能によって、Zoomホスト型モデルまたは第三者モデル(OpenAI・Anthropic・Perplexity)にデータを送信します。会議要約機能では音声の文字起こしデータが、チャット作成支援では選択したチャットスレッドとプロンプトが、それぞれ関連モデルに送られる仕組みです。

Zoomはデータフローの透明性確保のため、AI Companion セキュリティとプライバシーに関するホワイトペーパーでモデル使用状況・データ処理・保存方法を詳細に公開しています。管理者はホワイトペーパーで各機能が使用するモデルを確認し、組織のセキュリティポリシーに基づいて機能の有効・無効を判断できます。

OpenAI・Anthropicとのデータ共有範囲

Zoomの第三者モデルプロバイダーであるOpenAI・Anthropicは、Zoomとの契約により顧客データを自社モデル学習に使用しないことが義務付けられています。これらのプロバイダーに送信されるデータは「リクエスト処理のみ」に限定され、処理完了後は速やかに削除される仕組みです。

Zoomのサブプロセッサーページには、各プロバイダーが提供するサービスとデータ取り扱い条件が明記され、契約条件の透明性が確保されています。管理者設定で「Zoom-hosted Models Only(ZMO)」モードを選択すれば、第三者モデルへのデータ送信を完全に遮断し、Zoomホストモデルのみを使用することも可能です。

Zero Data Retention(ZDR)オプションの活用

Zero Data Retention(ZDR)は、AI応答生成直後にZoomサーバーからデータを削除するオプションです。

この機能を有効化すると、文字起こしデータ・要約・ユーザープロンプトなどがZoomクラウドに保存されず、データ保持期間がゼロになります。医療機関や金融機関など、データ保持に関する厳格なコンプライアンス要件を持つ組織に特に推奨される機能です。

設定は、Zoom管理者ダッシュボードのAI Companion設定からZero Data Retentionを有効化するだけで完了します。ただし、ZDRを有効化すると会議終了後にAI生成コンテンツを再確認できなくなるため、運用フローの見直しが必要になる点に注意しましょう。

データの保存先と削除方法

AI Companionが生成した要約や文字起こしは、デフォルトでZoomクラウドストレージに保存されます。組織のデータガバナンス要件に応じた設定が可能です。データ削除は、管理者設定や保持期間の設定により管理できます。

不要なデータが蓄積しないよう、削除プロセスを定期的に監査することが情報漏洩リスク最小化の鍵です。組織固有のコンプライアンスニーズに応じて、データ保存・保持について細かく管理できる複数の方法を活用してください。

Customer Managed Key(CMK)で暗号鍵を自社管理

Customer Managed Key(CMK)は、Zoomクラウドに保存されるコンテンツの暗号鍵を顧客が自社で管理できる機能です。CMKを有効化すると、Zoomはデータ暗号化時に顧客が提供した鍵を使用し、顧客が鍵を無効化すればZoomはデータにアクセスできなくなります。データ主権やコンプライアンス要件が厳しい組織(金融機関・政府機関など)に特に有効な機能といえるでしょう。

AI Companion 1.0ではCMKがすでに対応済みです。CMK設定の詳細については、Zoom営業担当者に確認してください。

データの流れと保持方針を明確に管理することが安全運用の要となります。特にZDRやCMKといった機能を適切に活用することで、情報漏洩リスクを大幅に低減できます。さらに、第三者モデルへの送信制御や定期的なデータ削除監査を組み合わせれば、実運用レベルでも高いセキュリティを維持可能です。

会議参加者への通知機能|AI使用は「バレる」のか?

AI Companion使用時、参加者に通知されるかどうかは、企業の透明性とプライバシー保護の観点から極めて重要です。Zoomは、AI機能使用を参加者に明示するため、通知バナー表示・音声アナウンス・AIダイヤモンドアイコンという3つの通知メカニズムを実装しています。

AI使用タイミングについての透明性をユーザーに保証することは、「責任あるAI」の重要ポイントとされています。参加者の同意なくAI機能を使用すれば、信頼関係の損失やプライバシー侵害のリスクを招くため、透明性ある運用が不可欠です。

AI Companion起動時の通知バナー表示

AI Companionが会議中に起動されると、参加者の画面に「AI Companionが有効になっています」という通知バナーが自動表示されます。この通知により、参加者はAI機能使用中であることを認識できる仕組みです。電話参加者には音声アナウンスが流れ、「Zoom AI Companionがミーティングで有効になった」ことを知らせます。

さらに、Zoom Workplaceデスクトップアプリのクライアント右上にはAI Companionマーク(ダイヤモンド形)が表示され、視覚的にもAI機能使用が明示されます。エンタープライズ顧客は通知設定をカスタマイズし、独自のテキストやハイパーリンクなどを追加できます。

ホストと参加者の権限の違い

AI Companionの起動権限は、デフォルトでは会議ホストのみが保有します。ホストは会議開始時または会議中にAI機能を有効化でき、要約生成・文字起こし開始・会議内容への質問といった操作を実行できます。参加者は、管理者が「参加者にもAI Companion使用を許可」設定を有効化している場合のみ、個別にAI機能を使用可能です。

ただし、参加者が個人的に使用するAI Companionは自分の視点から会議内容を要約するため、ホスト生成の要約とは内容が異なる場合があります。ミーティングの場合、ホストは自身の方針やミーティング参加者のリクエストに応じてAI Companionをオンにできる仕組みです。

参加者が機能の停止をリクエストする方法

参加者がAI機能使用に異議がある場合、会議中にチャットや音声でホストに停止を依頼できます。ホストは会議コントロールパネルからAI Companionボタンをクリックし、機能を無効化できます。

参加者が事前にAI機能使用を認識できるよう、会議案内で明示することが推奨されます。ZoomはAI使用タイミングについての明確な方法を示し、ミーティングでユーザーにAI稼働タイミングをわかりやすく通知するよう機能を設計しています。

ZoomのAI Companion通知設計は、透明性とユーザー信頼の両立を意識した設計となっています。AI機能の稼働を明示するバナーや音声アナウンス、アイコン表示などにより、参加者が状況を即座に把握できます。特に、通知設定をカスタマイズ可能にした点は企業の説明責任を支援する実装といえます。

企業の管理者が押さえるべきセキュリティ設定

AI Companionを企業全体で安全に運用するには、管理者による適切な権限設定とポリシー適用が欠かせません。

Zoomは、アカウントレベル・グループレベル・ユーザーレベルの3階層で細かく権限を制御でき、部門ごとに異なるセキュリティ要件に対応可能です。管理者は組織のコンプライアンス要件変化に応じて、定期的に設定を見直すことが重要です。

アカウント・グループ・ユーザーレベルでの権限管理

Zoom管理者ダッシュボードでは、「アカウント全体」「特定グループ」「個別ユーザー」の3レベルでAI Companion機能のオン・オフを制御できます。営業部門にはAI要約機能を許可し、法務部門には禁止するといった柔軟な設定が可能です。

各レベルで「Meeting Summary(会議要約)」「Smart Recording(スマート録画)」「In-Meeting Questions(会議中の質問)」などの個別機能を有効・無効化できます。Zoom Phoneを利用している場合は、AI Companion機能を通話にも適用でき、通話中にAIに質問することも可能です。

不要な機能が有効化されていないか、定期的に権限設定を監査しておきましょう。

部門ごとに異なるセキュリティポリシーの適用方法

多国籍企業や大規模組織では、部門ごとに異なるコンプライアンス要件が存在するため、一律のセキュリティポリシーでは対応できません。Zoomはグループ機能を活用し、部門ごとにカスタマイズされたポリシーを適用できます。

人事部門には「Zero Data Retention」を有効化し、マーケティング部門にはデフォルトの30日保持を許可するといった設定が可能です。Zoomウェブポータルのユーザー管理からグループを作成し、各グループにAI Companion設定を個別に割り当てます。

組織固有のデータガバナンスプライオリティに沿ってデータアクセスを調整する柔軟な設定の活用が、今日のデジタル環境における鍵となります。

機密情報を扱う会議での設定チェックリスト

機密情報を含む会議でAI Companionを使用する際は、事前にチェックリストを確認しましょう。

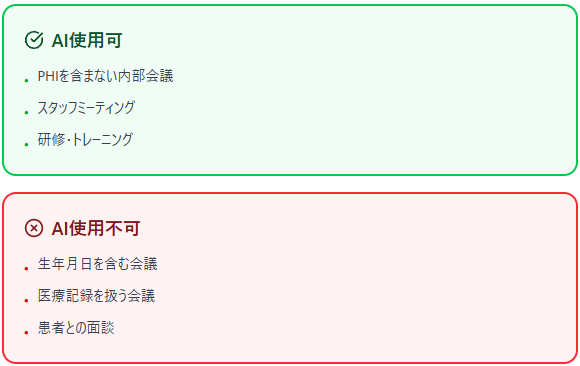

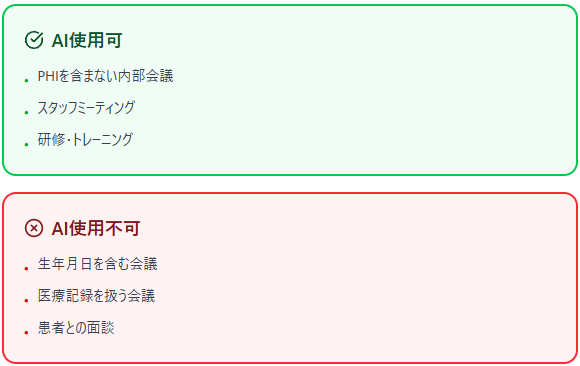

「営業戦略会議・マーケティング分析会議ではAI使用可、取締役会・人事評価会議では使用不可」といった具体的なルールを設けることで、情報漏洩リスクを最小化できます。

組織内に明確な「AI利用ポリシー」を策定し、「どの会議でAI機能を使用可能か」を明文化しておくことをお勧めします。

アカウント・グループ・ユーザー単位で制御できる仕組みは、組織規模や部門特性に応じた柔軟な対応を可能にします。特に、ZDR設定や会議ごとのAI使用ルールを明確化することで、情報漏洩リスクを最小限に抑えられます。

医療・金融業界での利用|コンプライアンス対応

医療・金融業界では、HIPAA(医療保険の相互運用性と説明責任に関する法律)・GDPR(EU一般データ保護規則)・個人情報保護法といった厳格な規制が適用されるため、AI Companion導入には慎重な検討が必要です。ZoomはISO 27001・SOC 2・GDPR準拠などのセキュリティ認証を取得していますが、業界特有の規制に対応するには追加設定が求められます。

テクノロジースタック内でアクセスや利用の対象となるデータの可視性を維持し、組織固有のデータガバナンスプライオリティに沿ってデータアクセスを調整する柔軟な設定の活用が重要とされています。

GDPR・個人情報保護法への準拠状況

ZoomはGDPR(EU一般データ保護規則)およびカリフォルニア州消費者プライバシー法(CCPA)に準拠したデータ処理を実施しています。データ処理契約(DPA)で「顧客がデータ管理者、Zoomがデータ処理者」という役割を明確化し、顧客の指示に基づいてのみデータを処理することを保証しています。

日本の個人情報保護法に関しては、Zoomは有料アカウントでミーティングやウェビナーのデータ処理リージョンを選択できる機能を提供しています。

AI Companionが処理するデータは米国を拠点とするデータセンター内で処理される場合があります。完全な国内処理を求める組織は「Zoom-hosted Models Only(ZMO)」モードの利用を検討してください。

医療機関向けBAA契約とAI Companionの制限

HIPAA準拠が必要な医療機関は、ZoomとBAA(Business Associate Agreement)を締結していますが、AI Companion機能はBAA契約の対象外となるケースが多いため注意が必要です。医療機関がAI Companionを使用する場合、PHI(保護された健康情報)を含まない内部会議(スタッフミーティング・研修など)に限定し、患者データを扱う会議では完全に無効化することが推奨されます。

生年月日・医療記録・研究参加者のPII/PHIを含む会議では、AI機能を使用しないことが重要です。AI Companion導入前にZoomの法務チームと協議し、BAA契約の適用範囲を明確化しておきましょう。臨床・遠隔医療・ヘルスケア設定(患者との面談時)で使用しないことを厳格に禁止する方針を確立してください。

東京大学の導入事例から学ぶ教育機関での運用

東京大学はZoom AI Companionの利用ガイドを公開し、学生・教職員が安全に機能を活用できる情報を提供しています。

利用にあたっては、個人情報や機密情報を含む会議での使用に注意が必要であることが説明されています。教育機関がAI Companionを導入する際は、組織全体のガイドライン策定、利用者への研修実施、学生のプライバシー保護を最優先にした運用ルールが重要です。

米国の教育機関ではFERPA(家族教育権およびプライバシー法)、日本の教育機関では個人情報保護法などの学生データ保護規制を考慮し、授業録画の取り扱いや学生同意の取得方法を明確化する必要があります。

医療・金融など高規制業界でのAI Companion活用は、汎用的なセキュリティ認証に加え、業界特有の法的要件を満たす運用設計が不可欠です。特にHIPAAや個人情報保護法に準じた利用制限、データ処理リージョンの明確化、ZMOモードの活用が有効です。

Zoom AI Companionのリスクと注意点

AI Companionは会議の生産性向上に貢献しますが、技術的限界と運用上のリスクも存在します。要約精度の限界、有料プラン必須という費用負担、機密情報の誤入力リスクは、導入前に十分理解すべき課題です。

Zoomは「追加費用なし」とマーケティングしていますが、実際にはPro・Business・Enterpriseプランが必須で、月額費用がかかります。外部の生成AIを活用するため、セキュリティ面での注意も必要です。

要約精度の限界とハルシネーション対策

AI Companionの要約精度は、会議内容や話者の発音によって大きく変動します。専門用語・固有名詞・方言・アクセントが混在する会議では、文字起こし精度が低下し、誤った要約が生成される可能性があります。さらに、AI特有の「ハルシネーション(幻覚)」現象により、実際には発言されていない内容が要約に含まれるリスクもあります。

AI生成コンテンツを他者と共有する前に、ホストが内容を確認する責任があることを理解しておきましょう。

- 重要な会議では人間による議事録との併用

- 要約内容の事実確認プロセスの確立

- 誤った要約の報告体制の整備

AIの出力を鵜呑みにせず、必ず人間の目でチェックする習慣をつけてください。

有料プランが必須|無料プランでは利用不可

Zoom AI Companionは、無料のZoom Basicプランでは一切利用できません。利用するには、最低でもProプラン(有料プラン)が必要で、より高度な機能(カスタムAIエージェント・第三者統合)を使用する場合は、Custom AI Companionアドオンの追加契約が必要です。

100人規模の企業が全社展開する場合、相応のコストが発生します。一部の高度な機能は地域や業種によって制限されており、すべての企業が同じ機能を利用できるわけではありません。

AI Companionの費用対効果を正確に評価するため、①会議時間の削減効果、②議事録作成工数の削減、③意思決定速度の向上、を定量的に測定し、投資判断を行うことをお勧めします。

機密情報入力時の安全な運用ルール

AI Companionに機密情報を誤って入力すると、データが第三者AIモデルに送信され、情報漏洩のリスクが生じます。機密情報(個人情報・社会保障番号・学生記録・個人連絡先情報など)を、AI Companionにクエリ・質問・プロンプトとして入力することは避けるべきです。

機密情報を扱う会議では、①会議開始前にAI機能を無効化、②参加者への事前通知(「この会議はAI機能なしで実施します」)、③録画データのアクセス権限を管理者のみに制限、といった対策が必須です。組織内に「AI利用ポリシー」を策定し、「どの会議でAI機能を使用可能か」を明確化することをお勧めします。

「営業戦略会議・マーケティング分析会議ではAI使用可、取締役会・人事評価会議では使用不可」といった具体的なルールを設けることで、情報漏洩リスクを最小化できます。

業務効率化に寄与する一方、要約精度のばらつきやハルシネーション、費用負担、機密情報の誤入力といったリスク管理が不可欠です。特に重要会議ではAI任せにせず、人間の確認プロセスを組み込むことが重要です。

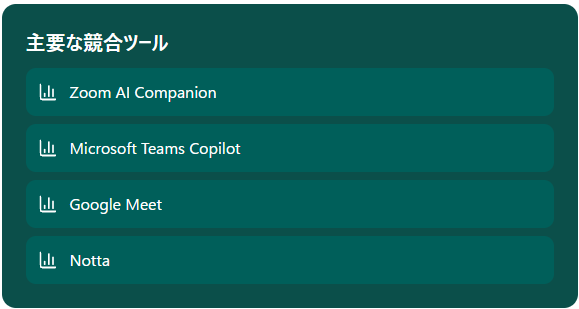

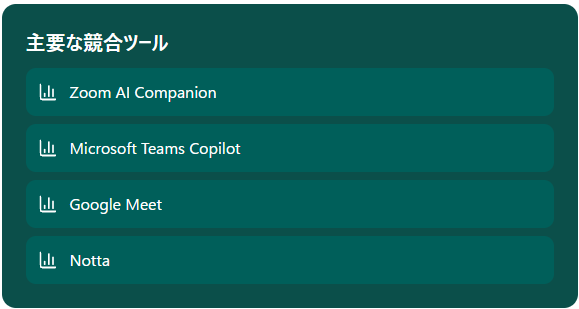

他社AIツールとの比較|Teams・Google Meetとの違い

AI議事録ツール市場では、Zoom AI Companion・Microsoft Teams Copilot・Google Meet・Nottaなどが競合しています。各ツールはセキュリティ機能・精度・価格・統合性で異なる特徴を持つため、組織のニーズに応じた選定が重要です。

Zoomのフェデレーテッドアプローチは、複数のAIモデルを組み合わせることで高精度を実現していますが、その分データが複数の外部システムに触れるリスクもあります。Microsoft Teams Copilotは、Microsoft 365エコシステムとの統合が強みで、既存のセキュリティポリシーを活用できますが、価格はZoomより高額です。

Microsoft Teams Copilotとのセキュリティ機能比較

セキュリティ面では、Microsoftが2025年2月に完成させた「EU Data Boundary」により、欧州顧客のデータはEU・EFTA地域内で保管・処理され、GDPR準拠が強化されています。

Teams CopilotはMicrosoft 365エコシステム内のデータガバナンス機能と統合されており、情報バリア・データ損失防止(DLP)などの高度な制御との連携が期待されます。一方、Zoomは「Zero Data Retention」「Customer Managed Key」といった柔軟なデータ保持オプションを提供し、コンプライアンス要件が厳しい組織に適しています。

既にMicrosoft 365を全社展開している企業はTeams Copilotを、Zoomを主要なコミュニケーションツールとして使用している企業はAI Companionを選択することで、既存のセキュリティポリシーとの整合性を保ちやすくなります。

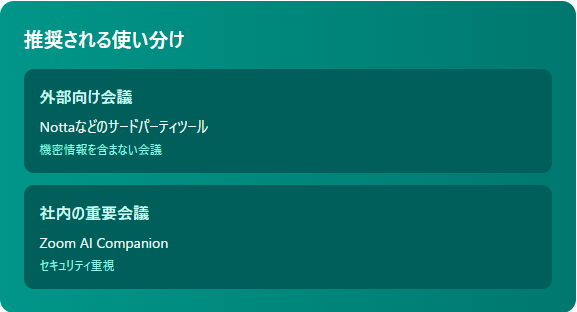

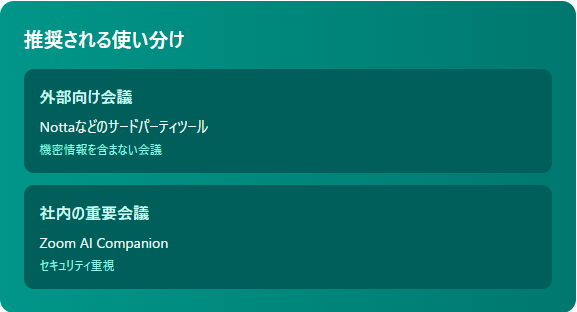

Notta等のサードパーティツールとの使い分け

Nottaは、Zoom・Teams・Google Meetなど複数のプラットフォームに対応する独立型AI議事録ツールで、比較的低価格で利用できる点が特徴です。Zoom AI Companionと比較すると、Nottaは日本語の文字起こし精度が高いとされています。ただし、サードパーティツールは会議データを独自のサーバーに送信するため、組織のセキュリティポリシーと矛盾する可能性があります。

競合のFathom AIやTldv、Nottaは外部アプリとして柔軟ですが、ZoomのZoom AI Companionセキュリティの統合性と管理容易さは魅力とされています。機密情報を含まない外部向け会議ではNottaなどのサードパーティツールを活用し、社内の重要会議ではZoom AI Companionを使用する、という使い分けがお勧めです。これにより、コスト効率とセキュリティのバランスを最適化できます。

自社に最適なAI議事録ツールの選び方

AI議事録ツールの選定基準は、①セキュリティ要件(データ保持・暗号化・コンプライアンス)、②既存ツールとの統合性(Zoom・Teams・Google Workspaceなど)、③コスト(ユーザー数×月額費用)、④日本語対応と精度、⑤サポート体制、の5点です。金融機関や医療機関など厳格なコンプライアンスが求められる業界では、「Zero Data Retention」「Customer Managed Key」「BAA契約」に対応したツールが必須です。中小企業やスタートアップでは、コストパフォーマンスを重視し、Nottaなどの低価格ツールから試験導入することも有効です。

まず「パイロット導入」を実施し、複数ツールを一定期間試用することをお勧めします。営業チームにZoom AI Companion、マーケティングチームにNotta、管理部門にTeams Copilotを試用させ、①要約精度、②ユーザー満足度、③セキュリティインシデントの有無、を評価しましょう。この比較結果に基づいて全社展開するツールを決定することで、導入失敗のリスクを最小化できます。

Zoomは運用の柔軟性、Microsoft Teamsはエコシステム統合、Nottaはコストと多言語精度に強みがあります。特に機密情報を扱う組織では、Zero Data RetentionやCMK対応などの機能を重視すべきです。複数ツールの試用比較を通じ、業務特性に最適な構成を見極めることが効果的です。

安全にZoom AI Companionを導入する5つのステップ

Zoom AI Companionの導入は、単なる機能有効化ではなく、組織全体のセキュリティ体制と運用ルールの整備を伴うプロジェクトです。導入前のセキュリティチェック、社内ガイドラインの策定、従業員への研修、運用開始後の監査という段階的アプローチが成功の鍵となります。

明確なガイドラインと従業員への周知が、安全で効果的なAI活用を支えます。

導入前に確認すべきセキュリティチェック項目

AI Companion導入前に、以下の10項目をチェックしてください。

ITセキュリティチーム・法務チーム・現場部門の代表者からなる「AI導入タスクフォース」を結成し、各部門の要件を集約することをお勧めします。これにより、導入後のトラブルを未然に防げます。

社内ガイドラインの整備と従業員への周知方法

AI Companionの安全な運用には、明確な社内ガイドラインが不可欠です。ガイドラインに含めるべき項目は、①AI機能を使用可能な会議の種類(例:営業会議はOK、取締役会はNG)、②参加者への事前通知と同意取得の方法、③要約コンテンツの共有範囲と承認プロセス、④機密情報を含む会議での禁止事項、⑤ハルシネーション対策(要約内容の事実確認義務)、⑥インシデント報告手順、です。組織によっては、教職員・学生向けに個人情報や機密情報を含む会議での使用に注意を促すガイドラインを策定しています。

従業員への周知方法としては、①eラーニングによる研修(30分程度の動画講座)、②部門別ワークショップ(実際の会議でのデモンストレーション)、③ガイドラインのイントラネット掲載とメール通知、④定期的なリマインダー送信(四半期ごと)、が効果的です。「AI利用ポリシー違反時のペナルティ」を明確化し、組織全体でルール遵守の文化を醸成することをお勧めします。

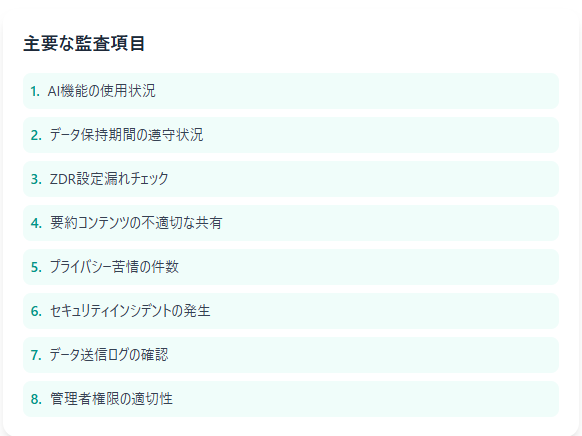

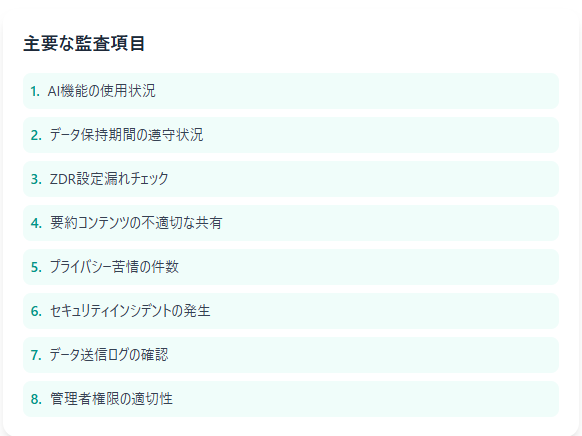

運用開始後の定期的なセキュリティ監査

AI Companion導入後は、定期的なセキュリティ監査により、設定の適切性と運用状況を継続的に評価しましょう。

Zoom管理者ダッシュボードでは、AI Companionの設定や使用状況を管理できます。定期的に『AI利用状況レビュー会議』を開催し、①セキュリティインシデントの有無、②ユーザーフィードバック、③設定変更の必要性、を評価することをお勧めします。導入後は定期的にセキュリティ監査を実施し、運用状況を継続的に評価することが重要です。

セキュリティ・運用・教育の三位一体での整備が欠かせません。特に導入初期は、タスクフォースを中心に部門横断的なリスク評価とガイドライン策定を行うことが重要です。運用開始後も定期的な設定監査とユーザーフィードバックの収集を通じて、ポリシーを継続的に最適化すべきです。

よくある質問|Zoom AI Companionのセキュリティ

AI Companion導入を検討する企業から最も多く寄せられる質問は、情報漏洩リスク・データの学習使用・参加者の権限・保存先・コンプライアンス対応の5点です。

これらの疑問に対する正確な理解が、安全な導入の前提となります。

会議内容が外部に漏れる可能性はありますか?

AI Companionは、会議データを処理するために一時的に第三者AIモデル(OpenAI・Anthropic)に送信しますが、Zoomとモデルプロバイダーとの契約により、データはモデル学習に使用されず、処理完了後に削除されます。ただし、複数の外部システムにデータが触れることで、それぞれに固有のセキュリティ脆弱性のリスクが存在するとの指摘もあります。

情報漏洩リスクを最小化するには、①「Zoom-hosted Models Only(ZMO)」モードで第三者モデルへの送信を遮断、②「Zero Data Retention」で処理後のデータ保存を防止、③機密会議ではAI機能を完全に無効化、の3つの対策が有効です。

AIモデルの学習に会議データが使われることはありますか?

Zoomは公式に「顧客の音声・動画・チャット・画面共有・添付ファイルなどを、Zoom自社または第三者AIモデルの学習に一切使用しない」と明言しています。この方針は利用規約に明記され、法的拘束力を持ちます。

2023年8月には利用規約の文言が誤解を招き批判を受けましたが、Zoomは即座に規約を修正し、顧客データの不使用を明確化しました。Zoomは顧客コンテンツをAI学習に使用しないと表明しており、この点は複数の教育機関でも確認されています。

ホスト以外の参加者もAI Companionを使えますか?

デフォルトでは、AI Companionの起動権限は会議ホストのみが持ちますが、管理者が「参加者にもAI Companion使用を許可」設定を有効化すると、参加者も個別に機能を使用できます。参加者が使用するAI Companionは、自分の視点から会議内容を要約するため、ホストの要約とは異なる内容になる場合があります。

参加者の権限は管理者がアカウントレベル・グループレベル・ユーザーレベルで細かく制御できます。参加者に権限を付与する前に、「個別要約の内容が組織外に共有されるリスク」を評価しておきましょう。

データの保存先はどこですか?削除は可能ですか?

AI Companionが生成した要約や文字起こしは、デフォルトでZoomクラウドストレージに保存されます。AI Companionが生成したコンテンツはZoomクラウドストレージに保存され、データの保持期間(最大30日間)は管理者が管理できます。

データ削除は、管理者設定により管理できます。「Zero Data Retention(ZDR)」を有効化すると、AI応答生成直後にデータが削除され、Zoomクラウドに一切保存されなくなります。医療機関や金融機関など、データ保持に厳格な要件がある組織にはZDRの活用が推奨されます。

日本の個人情報保護法に準拠していますか?

Zoomは、日本の個人情報保護法に準拠したデータ処理を実施しています。有料アカウントではミーティングやウェビナーのデータ処理リージョンを選択できる機能が提供されています。

AI Companionが処理するデータは米国を拠点とするデータセンター内で処理される場合があります。完全な国内処理を求める組織は『Zoom-hosted Models Only(ZMO)』モードの利用を検討してください。

ZoomはGDPR・CCPA・日本の個人情報保護法に準拠したデータ処理を実施しています。